ทีม Amazon EU Design and Construction (Amazon D&C) เป็นทีมวิศวกรที่ออกแบบและสร้างคลังสินค้าของ Amazon ทีมงานใช้เอกสารจำนวนมากและค้นหาข้อมูลที่ถูกต้องเพื่อให้แน่ใจว่าการออกแบบคลังสินค้าตรงตามมาตรฐานสูงสุด ในการโพสต์ โซลูชันที่ขับเคลื่อนด้วย AI แบบเจนเนอเรชั่นบน Amazon SageMaker เพื่อช่วยการออกแบบและการก่อสร้างของ Amazon EUเราได้นำเสนอคำถามที่ตอบวิธีแก้ปัญหาบอทโดยใช้ การดึงข้อมูล Augmented Generation (RAG) ไปป์ไลน์ที่มีการปรับแต่งอย่างละเอียด แบบจำลองภาษาขนาดใหญ่ (LLM) สำหรับ Amazon D&C เพื่อดึงข้อมูลที่ถูกต้องอย่างมีประสิทธิภาพจากเอกสารจำนวนมากที่ไม่ได้จัดระเบียบ และให้บริการที่ทันท่วงทีและมีคุณภาพสูงในโครงการก่อสร้างของพวกเขา ทีม Amazon D&C นำโซลูชันไปใช้ในโครงการนำร่องสำหรับวิศวกรของ Amazon และรวบรวมความคิดเห็นของผู้ใช้

ในโพสต์นี้ เราแบ่งปันวิธีที่เราวิเคราะห์ข้อมูลคำติชมและระบุข้อจำกัดของความถูกต้องและภาพหลอนที่ RAG มอบให้ และใช้คะแนนการประเมินโดยมนุษย์เพื่อฝึกแบบจำลองผ่าน การเรียนรู้การเสริมแรง- เพื่อเพิ่มตัวอย่างการฝึกอบรมเพื่อการเรียนรู้ที่ดีขึ้น เรายังใช้ LLM อื่นเพื่อสร้างคะแนนคำติชม วิธีการนี้แก้ไขข้อจำกัด RAG และปรับปรุงคุณภาพการตอบสนองของบอทให้ดียิ่งขึ้น เรานำเสนอกระบวนการเรียนรู้แบบเสริมกำลังและผลการเปรียบเทียบเพื่อแสดงให้เห็นถึงการปรับปรุงประสิทธิภาพของ LLM วิธีแก้ปัญหาใช้ Amazon SageMaker JumpStart เป็นบริการหลักสำหรับการปรับใช้โมเดล การปรับแต่ง และการเรียนรู้แบบเสริมกำลัง

รวบรวมคำติชมจากวิศวกรของ Amazon ในโครงการนำร่อง

หลังจากพัฒนาวิธีแก้ปัญหาตามที่อธิบายไว้ใน โซลูชันที่ขับเคลื่อนด้วย AI แบบเจนเนอเรชั่นบน Amazon SageMaker เพื่อช่วยการออกแบบและการก่อสร้างของ Amazon EUทีม Amazon D&C ได้ปรับใช้โซลูชันและดำเนินโครงการนำร่องร่วมกับวิศวกรของ Amazon วิศวกรเข้าถึงระบบนำร่องผ่านเว็บแอปพลิเคชันที่พัฒนาโดย สตรีมไลท์เชื่อมต่อกับไปป์ไลน์ RAG ในไปป์ไลน์เราใช้ บริการ Amazon OpenSearch สำหรับฐานข้อมูลเวกเตอร์ และปรับใช้โมเดล Mistral-7B-Instruct ที่ได้รับการปรับแต่งอย่างละเอียดบน Amazon SageMaker

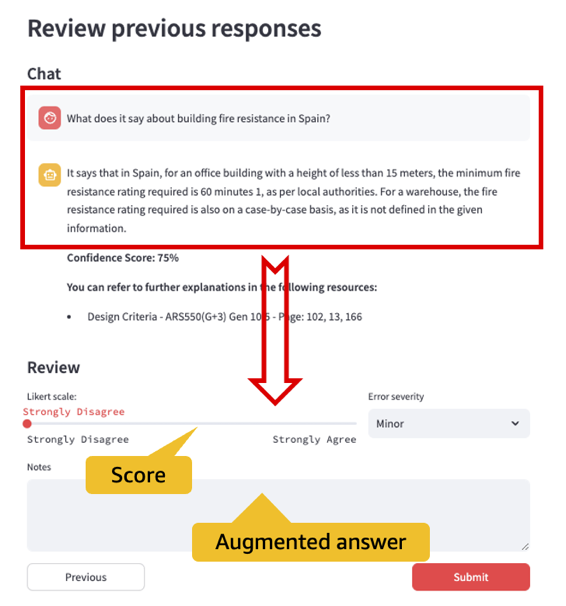

วัตถุประสงค์หลักประการหนึ่งของโครงการนำร่องคือการรวบรวมความคิดเห็นจากวิศวกรของ Amazon และใช้ความคิดเห็นดังกล่าวเพื่อลดภาพหลอน LLM ต่อไป เพื่อให้บรรลุเป้าหมายนี้ เราได้พัฒนาโมดูลการรวบรวมคำติชมใน UI ดังแสดงในรูปต่อไปนี้ และจัดเก็บข้อมูลเซสชันเว็บและคำติชมของผู้ใช้ไว้ใน อเมซอน ไดนาโมดีบี- วิศวกรของ Amazon สามารถเลือกระดับความพึงพอใจได้ห้าระดับผ่าน UI การรวบรวมคำติชม: ไม่เห็นด้วยอย่างยิ่ง ไม่เห็นด้วย เป็นกลาง เห็นด้วย และเห็นด้วยอย่างยิ่ง ซึ่งสอดคล้องกับคะแนนคำติชมตั้งแต่ 1–5 พวกเขายังสามารถให้คำตอบที่ดีกว่าสำหรับคำถามหรือความคิดเห็นว่าเหตุใดการตอบกลับของ LLM จึงไม่เป็นที่พอใจ

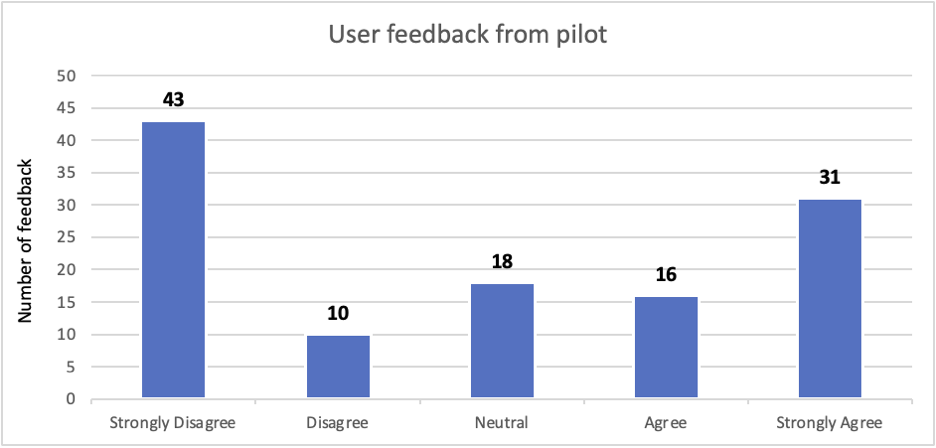

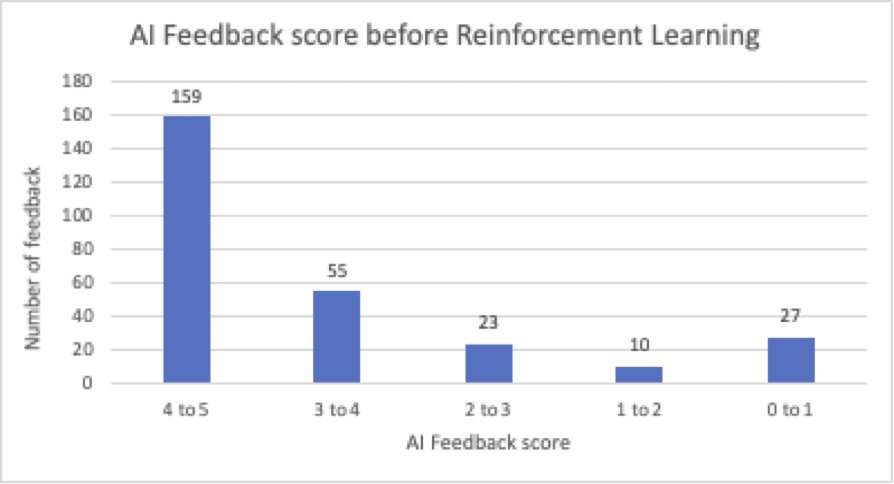

ในระหว่างโครงการนำร่อง ผู้ใช้ให้การตอบกลับ 118 รายการ แผนภูมิต่อไปนี้แสดงการกระจายตัวจากลบไปบวก เราสังเกตเห็นคำตอบที่ไม่ถูกต้องซึ่งทำเครื่องหมายโดยการตอบรับเชิงลบ (ไม่เห็นด้วยและไม่เห็นด้วยอย่างยิ่ง) อยู่ที่ 45% จากความคิดเห็นทั้งหมด (53 จาก 118) ข้อผิดพลาดบางส่วน (ประมาณ 10% ของผลตอบรับเชิงลบ และ 7.5% ของผลตอบรับโดยรวม) สามารถแก้ไขได้โดยการให้ความรู้แก่ผู้ใช้และวิศวกรรมที่ทันท่วงที นอกจากนี้ เราสามารถแก้ไขปัญหาด้วยโซลูชันการปรับแต่ง LLM และการเรียนรู้การเสริมกำลังตามที่อธิบายไว้ในส่วนถัดไป

ผู้ใช้บางคนทิ้งข้อความไว้ เช่น “เยี่ยมมาก!” สำหรับคำตอบที่เห็นด้วยอย่างยิ่ง หรือ “ไม่ตอบคำถาม” สำหรับคำตอบที่ไม่เห็นด้วยอย่างยิ่ง ผู้ใช้รายอื่นให้คะแนนและอธิบายว่าพวกเขาปรับคำตอบ LLM อย่างไรในบันทึกย่อของพวกเขา ในตัวอย่างต่อไปนี้ ผู้ใช้จัดเตรียมเอกสารและเนื้อหาที่เพียงพอเพื่อแก้ไขภาพหลอน LLM โดยเฉพาะ

| คำถาม | เรามีที่จอดรถได้กี่คัน? |

| คำตอบของบอท |

จากบริบทที่กำหนด เราไม่มีข้อมูลเพียงพอที่จะกำหนดจำนวนที่จอดรถ บริบทกล่าวถึงขนาดพื้นที่จอดรถขั้นต่ำและข้อกำหนดสำหรับระดับแสงสว่างภายนอก แต่ไม่ได้ระบุจำนวนช่องจอดรถที่เฉพาะเจาะจง **คุณสามารถดูคำอธิบายเพิ่มเติมได้ในแหล่งข้อมูลต่อไปนี้:** * ARS GEN 10.0/05.01.02 เกณฑ์การออกแบบและภาคผนวก/แพ็คเกจประสิทธิภาพ AR เกณฑ์การออกแบบที่เรียงลำดับได้ v20.1.1.pdf – หน้า: 10 * ARS GEN 10.0/05.01.02 เกณฑ์การออกแบบและภาคผนวก/แพ็คเกจประสิทธิภาพ AR เกณฑ์การออกแบบที่เรียงลำดับได้ v20.1.1.pdf – หน้า: 79 |

| คะแนนผู้ใช้ | ไม่เห็นด้วยอย่างยิ่ง |

| บันทึกผู้ใช้ | สิ่งนี้ระบุไว้ในหน้า 21 ของเกณฑ์การออกแบบมาตรา 01 13 10 |

ปรับปรุงการตอบสนองของบอทด้วยการปรับแต่งแบบละเอียดและการเรียนรู้แบบเสริมภายใต้การดูแล

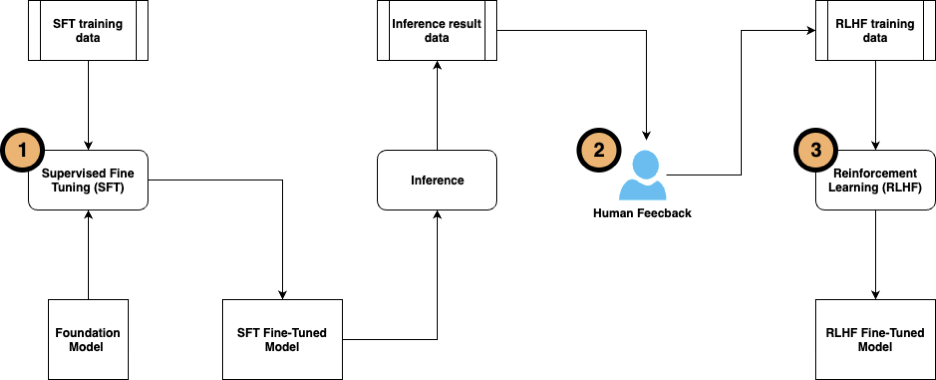

โซลูชันประกอบด้วยการปรับแต่งอย่างละเอียดสามขั้นตอน:

- ดำเนินการปรับแต่งแบบละเอียดภายใต้การดูแลโดยใช้ข้อมูลที่ติดป้ายกำกับ วิธีการนี้ได้อธิบายไว้ใน โซลูชันที่ขับเคลื่อนด้วย AI แบบเจนเนอเรชั่นบน Amazon SageMaker เพื่อช่วยการออกแบบและการก่อสร้างของ Amazon EU.

- รวบรวมคำติชมของผู้ใช้เพื่อติดป้ายกำกับคู่คำถาม-คำตอบเพื่อการปรับแต่ง LLM เพิ่มเติม

- เมื่อข้อมูลการฝึกพร้อมแล้ว ให้ปรับแต่งโมเดลเพิ่มเติมโดยใช้ การเรียนรู้การเสริมแรงจากคำติชมของมนุษย์ (RLHF)

RLHF ถูกนำมาใช้กันอย่างแพร่หลายตลอดทั้งแอปพลิเคชัน generative Artificial Intelligence (AI) และ LLM โดยจะรวมความคิดเห็นของมนุษย์ไว้ในฟังก์ชันการให้รางวัล และฝึกฝนโมเดลด้วยอัลกอริธึมการเรียนรู้แบบเสริมกำลังเพื่อเพิ่มรางวัลสูงสุด ซึ่งทำให้โมเดลทำงานได้สอดคล้องกับเป้าหมายของมนุษย์มากขึ้น แผนภาพต่อไปนี้แสดงไปป์ไลน์ของขั้นตอนต่างๆ

เราทดสอบวิธีการโดยใช้เอกสาร Amazon D&C กับโมเดล Mistral-7B บน SageMaker JumpStart

มีการดูแลปรับแต่งอย่างละเอียด

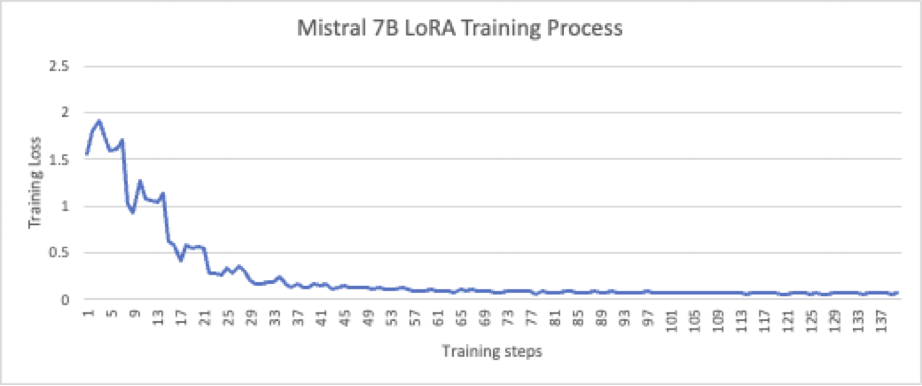

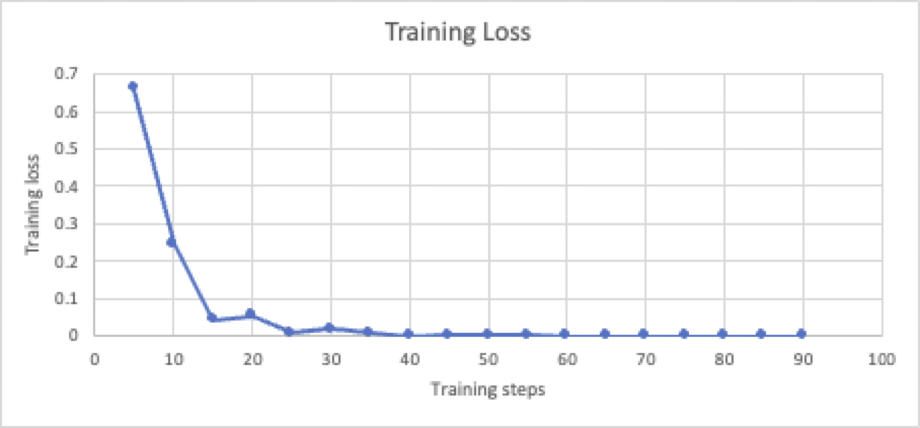

ในโพสต์ก่อนหน้านี้ เราได้แสดงให้เห็นว่าโมเดล Falcon-7B ที่ปรับแต่งอย่างละเอียดมีประสิทธิภาพเหนือกว่าไปป์ไลน์ RAG และปรับปรุงคุณภาพและความแม่นยำของการตอบสนองของบอท QA อย่างไร สำหรับโพสต์นี้ เราได้ดำเนินการปรับแต่งอย่างละเอียดภายใต้การดูแลของรุ่น Mistral-7B การปรับแต่งอย่างละเอียดภายใต้การดูแลใช้เทคนิค PEFT/LoRA (LoRA_r = 512, LoRA_alpha = 1024) บนพารามิเตอร์ 436,207,616 ตัว (5.68% ของพารามิเตอร์ทั้งหมด 7,677,964,288 ตัว) การฝึกอบรมดำเนินการบนโหนด p3.8x โดยมีตัวอย่าง 137 ตัวอย่างที่สร้างขึ้นโดย LLM สังเคราะห์และตรวจสอบโดยมนุษย์ กระบวนการนี้มาบรรจบกันอย่างดีหลังจาก 20 ยุค ดังแสดงในรูปต่อไปนี้

โมเดลที่ได้รับการปรับแต่งอย่างละเอียดได้รับการตรวจสอบโดยตัวอย่าง 274 ตัวอย่าง และผลการอนุมานถูกนำมาเปรียบเทียบกับคำตอบอ้างอิงด้วยคะแนนความคล้ายคลึงทางความหมาย คะแนนอยู่ที่ 0.8100 ซึ่งสูงกว่าคะแนน RAG แบบเดิมที่ได้ 0.6419

รวบรวมคำติชมของมนุษย์และ AI เพื่อการเรียนรู้แบบเสริมกำลัง

สำหรับ RLHF ตัวอย่างการฝึกอบรมคุณภาพสูงที่มีป้ายกำกับโดยผู้เชี่ยวชาญเฉพาะด้าน (SMEs) ในจำนวนที่เพียงพอถือเป็นสิ่งสำคัญ อย่างไรก็ตาม ป้ายกำกับของมนุษย์ที่มีคุณภาพต่ำอาจทำให้ประสิทธิภาพของโมเดลแย่ลงกว่าโมเดลดั้งเดิมหลังจากการฝึกอบรม RLHF ถึงเวลาของ SMEs แล้ว ทรัพยากรที่ขาดแคลนในองค์กรใดๆ- การตรวจสอบคำตอบของ LLM นับร้อยหรือหลายพันรายการและการให้ข้อเสนอแนะต้องใช้เวลาอย่างมากจาก SMEs ซึ่งอาจไม่ได้รับผลตอบแทนจากการลงทุนที่ชัดเจน

เพื่อจัดการกับความท้าทายนี้ เราได้นำ การเรียนรู้การเสริมกำลังจากข้อเสนอแนะของ AI (RLAIF) วิธีการ RLAIF จ้างผู้ช่วย AI (LLM อื่น) เพื่อให้คะแนนการประเมิน แทนที่จะจ้างจากมนุษย์ ในแนวทางการเรียนรู้แบบผสมผสานนี้ ตัวแทนการเรียนรู้จะปรับแต่งการกระทำไม่เพียงแต่ขึ้นอยู่กับการโต้ตอบกับมนุษย์เท่านั้น แต่ยังมาจากผลตอบรับที่ได้รับจากโมเดล AI อื่นด้วย สามารถปรับขนาดได้มากกว่ามากในการให้ข้อมูลการฝึกอบรมที่เพียงพอสำหรับการเรียนรู้แบบเสริมกำลัง และเป็นแบบอัตนัยน้อยกว่ามาก เนื่องจากการฝึกอบรมไม่ได้ขึ้นอยู่กับความชอบเฉพาะจาก SME กลุ่มเล็กๆ SMEs อาจยังคงมีส่วนร่วม แต่เพียงเพื่อดูแลกระบวนการและตรวจสอบคุณภาพผลตอบรับของ AI เท่านั้น สิ่งนี้ช่วยลดภาระงานของ SMEs ได้อย่างมาก เนื่องจากคะแนนและป้ายกำกับที่สร้างโดย AI นั้นมีความซับซ้อนน้อยกว่ามากสำหรับ SMEs ในการวิเคราะห์ กรอง และจัดเรียง

ในกรณีการใช้งานนี้ เราจัดเตรียมคำแนะนำต่อไปนี้ให้กับแบบจำลอง Anthropic Claude 2 เพื่อสร้างคะแนนการประเมินเป็นตัวอย่างการฝึกอบรมสำหรับขั้นตอนการเรียนรู้แบบเสริมกำลัง:

แบบจำลอง Claude 2 จะสร้างคะแนนการประเมินและความคิดเห็นว่าเหตุใดจึงให้คะแนน ดังที่แสดงในตัวอย่างต่อไปนี้

| คำถาม | 'Fit Out Works' มีความหมายว่าอะไรในบริบทนี้ |

| คำตอบอ้างอิง | Fit Out Works หมายถึงงานที่ดำเนินการภายใต้สัญญาก่อสร้างโดยหรือในนามของ Amazon ผ่านทางนักพัฒนาจนถึงวันที่ได้รับครั้งแรกจากตำแหน่ง Developer Shell & Core Base-build โดยประมาณ งานเหล่านี้ประกอบด้วย Fit-Outs ที่จำเป็นของ Amazon การติดตั้งแบบ Big-Box และแบบกำหนดเอง |

| การตอบสนองของบอท QA | Fit Out Works หมายถึงงานที่ดำเนินการภายใต้สัญญาก่อสร้างโดยหรือในนามของ Amazon ผ่านทางนักพัฒนาจนถึงวันที่ได้รับครั้งแรกจากตำแหน่ง Developer Shell และ Core Base-build โดยประมาณ |

| คะแนนเอไอ | 4.5 |

| ความคิดเห็นของเอไอ | คำตอบของเครื่องให้ข้อมูลสำคัญจากคำตอบมาตรฐาน โดยที่ Fit Out Works หมายถึงงานที่ดำเนินการภายใต้สัญญาก่อสร้างโดยหรือในนามของ Amazon ผ่านทางนักพัฒนาจนถึงวันที่ได้รับครั้งแรกจากตำแหน่ง Developer Shell และ Core Base โดยประมาณ . รายละเอียดเพิ่มเติมเกี่ยวกับการรวม Fit-Outs ที่จำเป็นของ Amazon การติดตั้ง Big-Box และการปรับแต่งต่างๆ มีความเกี่ยวข้องและช่วยให้บริบทเพิ่มเติม ดังนั้นฉันจึงได้คะแนนคำตอบของเครื่อง 4.5 จาก 5 คะแนน ซึ่งรวบรวมสาระสำคัญของคำตอบมาตรฐานและให้บางส่วน รายละเอียดเพิ่มเติมที่เป็นประโยชน์ |

จากคำถามตรวจสอบความถูกต้อง 274 ข้อ โมเดลที่ได้รับการปรับแต่งอย่างละเอียดนั้นสร้างคำตอบได้ 159 คำตอบที่มีคะแนน AI มากกว่า 4 เราสังเกตคำตอบ 60 คำตอบที่มีคะแนนต่ำกว่า 3; มีพื้นที่ในการปรับปรุงคุณภาพการตอบสนองโดยรวม

Amazon Engineering SMEs ตรวจสอบผลตอบรับ AI นี้และรับทราบถึงประโยชน์ของการใช้คะแนน AI หากไม่มีข้อเสนอแนะจาก AI SMEs จะต้องใช้เวลาในการตรวจสอบและวิเคราะห์การตอบสนองของ LLM แต่ละรายการเพื่อระบุคำตอบที่ถูกตัดออกและภาพหลอน และเพื่อตัดสินว่า LLM ส่งเนื้อหาและแนวคิดหลักที่ถูกต้องกลับมาหรือไม่ ข้อเสนอแนะของ AI จะให้คะแนน AI โดยอัตโนมัติ และช่วยให้ SMEs สามารถใช้การกรอง การเรียงลำดับ และการจัดกลุ่มเพื่อตรวจสอบคะแนนและระบุแนวโน้มในการตอบกลับ ซึ่งจะช่วยลดเวลาในการตรวจสอบโดยเฉลี่ยของ SME ได้ถึง 80%

การเรียนรู้แบบเสริมกำลังจากการตอบสนองของมนุษย์และ AI

เมื่อตัวอย่างการฝึกอบรมพร้อม เราจะใช้ อัลกอริธึมการเพิ่มประสิทธิภาพนโยบายใกล้เคียง (PPO) เพื่อทำการเรียนรู้แบบเสริมกำลัง PPO ใช้วิธีการไล่ระดับนโยบาย ซึ่งใช้ขั้นตอนเล็กๆ ในการอัปเดตนโยบายในกระบวนการเรียนรู้ เพื่อให้ตัวแทนการเรียนรู้สามารถเข้าถึงเครือข่ายนโยบายที่เหมาะสมที่สุดได้อย่างน่าเชื่อถือ ทำให้กระบวนการฝึกอบรมมีเสถียรภาพมากขึ้น และลดโอกาสที่จะเกิดความแตกต่าง

ในระหว่างการฝึกอบรม ขั้นแรกเราใช้ข้อมูลที่ติดป้ายกำกับโดยมนุษย์และ AI เพื่อสร้างโมเดลรางวัล ซึ่งจะใช้เป็นแนวทางในการอัปเดตน้ำหนักในกระบวนการเรียนรู้ สำหรับกรณีการใช้งานนี้ เราเลือกแบบจำลองการให้รางวัลแบบฐานดิสทิลโรแบร์ตา และฝึกอบรมตามตัวอย่างในรูปแบบต่อไปนี้:

[Instruction, Chosen_response, Rejected_response]

ต่อไปนี้เป็นตัวอย่างของบันทึกการฝึกอบรม

| การแนะนำ | ตามบริบท อะไรคือสิ่งที่ระบุไว้สำหรับการออกแบบที่ครอบคลุมและเข้าถึงได้? |

| เลือกแล้ว_ตอบกลับ | BREEAM Credit HEA06 - การออกแบบที่ครอบคลุมและเข้าถึงได้ - อาคารได้รับการออกแบบให้เหมาะสมกับวัตถุประสงค์ เหมาะสม และเข้าถึงได้โดยผู้ใช้ที่มีศักยภาพทุกคน กลยุทธ์การเข้าถึงได้รับการพัฒนาให้สอดคล้องกับรายการตรวจสอบ BREEAM A3 |

| ถูกปฏิเสธ_ตอบกลับ | บริบทระบุไว้ว่า |

โมเดลรางวัลได้รับการฝึกฝนด้วยอัตราการเรียนรู้ 1e-5 ดังที่แสดงในแผนภูมิต่อไปนี้ บ่อน้ำการฝึกอบรมจะมาบรรจบกันหลังจากผ่านไป 10 ยุค

จากนั้นโมเดลรางวัลจะถูกนำมาใช้เพื่อการเรียนรู้แบบเสริมกำลัง สำหรับกรณีการใช้งานนี้ เราใช้ PEFT/LoRA เพื่อเร่งการเรียนรู้ LoRA_r คือ 32 และ LoRA_alpha คือ 64 การเรียนรู้แบบ PPO อยู่ที่อัตรา 1.41e-5 ในสามยุค การฝึกอบรมการเสริมกำลังมีความผันผวนสูงและมีความอ่อนไหวมากต่อข้อมูลฉลากและข้อมูลป้อนกลับ เราใช้ตัวชี้วัดรางวัลเฉลี่ย ซึ่งเป็นรางวัลโดยเฉลี่ยที่ได้รับจากสภาพแวดล้อมโดยการตรวจสอบโมเดลรางวัลโดยเฉพาะ เพื่อสังเกตกระบวนการเรียนรู้

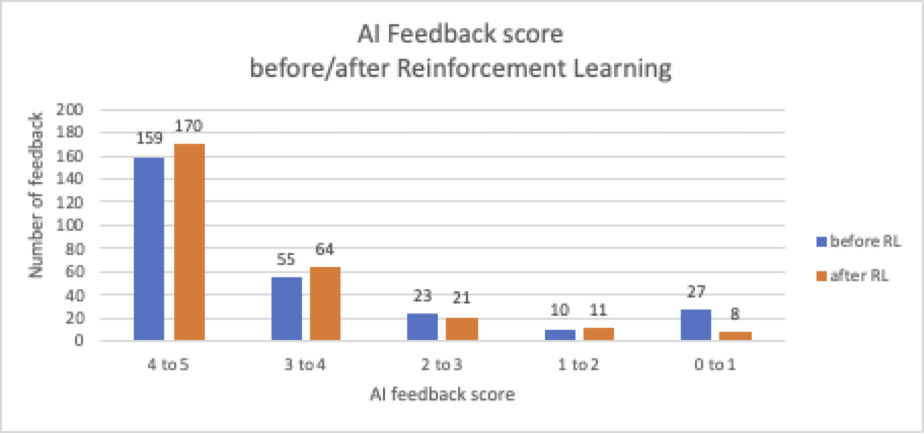

หลังจาก RLAIF เราจะเห็นจำนวนการตอบสนองของบอทที่มีคะแนนเป็นบวก (สูงกว่า 3) เพิ่มขึ้นจาก 78.1% เป็น 85.5% และผู้ที่มีคะแนนติดลบ (ต่ำกว่า 3) ลดลงจาก 21.9% เป็น 14.5% โดยรวมแล้วคะแนนตอบรับ AI โดยเฉลี่ยเพิ่มขึ้นถึง 8% จาก 3.9 เป็น 4.2

คุณสามารถดูการปรับปรุงได้ในตัวอย่างต่อไปนี้

| คำถาม | พื้นที่พื้นปูกระเบื้อง จำเป็นต้องปูกระเบื้องอะไร? |

| อ้างอิง | พื้นคอนกรีตปาดใช้ได้เฉพาะในพื้นที่ปูกระเบื้องเท่านั้น อ้างถึงภาพวาดซีรีส์ A-32 เพื่อดูว่าสามารถใช้กระเบื้องปูพื้นได้ที่ไหน |

| การตอบสนองของบอทก่อน RLAIF | พื้นคอนกรีตปาดใช้ได้เฉพาะใน |

| คะแนน AI ก่อน RLAIF | 3 |

| การตอบสนองของบอทหลังจาก RLAIF | พื้นคอนกรีตปาดใช้ได้เฉพาะในพื้นที่ปูกระเบื้องเท่านั้น อ้างถึงภาพวาดซีรีส์ A-32 เพื่อดูว่าพื้นกระเบื้องสามารถใช้ได้ในส่วนใดบ้าง |

| คะแนน AI หลังจาก RLAIF | 4.5 |

สรุป

โพสต์นี้เป็นความต่อเนื่องของการทำงานของเรากับทีมออกแบบและก่อสร้างของ Amazon EU ตามที่กล่าวไว้ใน โซลูชันที่ขับเคลื่อนด้วย AI แบบเจนเนอเรชั่นบน Amazon SageMaker เพื่อช่วยการออกแบบและการก่อสร้างของ Amazon EU- ในโพสต์นี้ เราได้แสดงให้เห็นว่าเราสร้างข้อมูลตอบรับของมนุษย์และ AI เพื่อปรับแต่งโมเดล Mistral-7B ด้วยการเรียนรู้แบบเสริมกำลังได้อย่างไร โมเดลหลังจาก RLAIF มอบประสิทธิภาพที่ดีขึ้นสำหรับบอตตอบคำถามของ Amazon Engineering ทำให้คะแนนคำติชมของ AI ดีขึ้น 8% ในโครงการนำร่องของทีม Amazon D&C การใช้ RLAIF ช่วยลดปริมาณงานการตรวจสอบสำหรับ SME ลงได้ประมาณ 80% ในขั้นตอนถัดไป เราจะขยายขนาดโซลูชันนี้โดยการเชื่อมต่อกับโครงสร้างพื้นฐานข้อมูลของ Amazon Engineering และออกแบบเฟรมเวิร์กเพื่อทำให้กระบวนการเรียนรู้อย่างต่อเนื่องเป็นอัตโนมัติโดยมีมนุษย์อยู่ในลูป นอกจากนี้เรายังจะปรับปรุงคุณภาพผลตอบรับของ AI เพิ่มเติมด้วยการปรับแต่งเทมเพลตพร้อมท์

ผ่านกระบวนการนี้ เราได้เรียนรู้วิธีปรับปรุงคุณภาพและประสิทธิภาพของงานตอบคำถามผ่าน RLHF และ RLAIF เพิ่มเติม

- การตรวจสอบและเสริมโดยมนุษย์ถือเป็นสิ่งสำคัญเพื่อให้ผลลัพธ์ที่ถูกต้องและมีความรับผิดชอบจาก LLM ผลตอบรับจากมนุษย์สามารถนำมาใช้ใน RLHF เพื่อปรับปรุงการตอบสนองของโมเดลให้ดียิ่งขึ้น

- RLAIF ทำให้วงจรการประเมินและการเรียนรู้เป็นแบบอัตโนมัติ ความคิดเห็นที่สร้างโดย AI นั้นมีความเป็นส่วนตัวน้อยกว่า เนื่องจากไม่ได้ขึ้นอยู่กับความชอบเฉพาะจากกลุ่ม SME กลุ่มเล็กๆ

- RLAIF สามารถปรับขนาดได้มากขึ้นเพื่อปรับปรุงคุณภาพบอทผ่านการเรียนรู้แบบเสริมกำลังอย่างต่อเนื่อง ในขณะเดียวกันก็ลดความพยายามที่จำเป็นจาก SMEs ให้เหลือน้อยที่สุด มีประโยชน์อย่างยิ่งสำหรับการพัฒนาโซลูชัน AI ที่สร้างเฉพาะโดเมนภายในองค์กรขนาดใหญ่

- กระบวนการนี้ควรทำเป็นประจำ โดยเฉพาะอย่างยิ่งเมื่อมีข้อมูลโดเมนใหม่เพื่อให้โซลูชันครอบคลุม

ในกรณีการใช้งานนี้ เราใช้ SageMaker JumpStart เพื่อทดสอบ LLM หลายรายการ และทดสอบด้วยวิธีการฝึกอบรม LLM หลายวิธี ช่วยเร่งการตอบสนองของ AI และวงจรการเรียนรู้อย่างมีนัยสำคัญด้วยประสิทธิภาพและคุณภาพสูงสุด สำหรับโปรเจ็กต์ของคุณเอง คุณสามารถแนะนำแนวทางแบบมนุษย์ในวงเพื่อรวบรวมคำติชมของผู้ใช้ของคุณ หรือสร้างคำติชม AI โดยใช้ LLM อื่น จากนั้น คุณสามารถปฏิบัติตามกระบวนการสามขั้นตอนที่กำหนดไว้ในโพสต์นี้เพื่อปรับแต่งโมเดลของคุณโดยใช้ RLHF และ RLAIF เราขอแนะนำให้ทดลองใช้วิธีการต่างๆ โดยใช้ SageMaker JumpStart เพื่อเร่งกระบวนการ

เกี่ยวกับผู้เขียน

หยุนเฟยไป๋ เป็นสถาปนิกโซลูชันอาวุโสที่ AWS ด้วยพื้นฐานด้าน AI/ML วิทยาศาสตร์ข้อมูล และการวิเคราะห์ Yunfei ช่วยให้ลูกค้าเลือกใช้บริการของ AWS เพื่อส่งมอบผลลัพธ์ทางธุรกิจ เขาออกแบบโซลูชัน AI/ML และการวิเคราะห์ข้อมูลที่เอาชนะความท้าทายด้านเทคนิคที่ซับซ้อนและขับเคลื่อนวัตถุประสงค์เชิงกลยุทธ์ หยุนเฟยสำเร็จการศึกษาระดับปริญญาเอกสาขาวิศวกรรมอิเล็กทรอนิกส์และไฟฟ้า นอกเวลางาน หยุนเฟยชอบอ่านหนังสือและฟังเพลง

หยุนเฟยไป๋ เป็นสถาปนิกโซลูชันอาวุโสที่ AWS ด้วยพื้นฐานด้าน AI/ML วิทยาศาสตร์ข้อมูล และการวิเคราะห์ Yunfei ช่วยให้ลูกค้าเลือกใช้บริการของ AWS เพื่อส่งมอบผลลัพธ์ทางธุรกิจ เขาออกแบบโซลูชัน AI/ML และการวิเคราะห์ข้อมูลที่เอาชนะความท้าทายด้านเทคนิคที่ซับซ้อนและขับเคลื่อนวัตถุประสงค์เชิงกลยุทธ์ หยุนเฟยสำเร็จการศึกษาระดับปริญญาเอกสาขาวิศวกรรมอิเล็กทรอนิกส์และไฟฟ้า นอกเวลางาน หยุนเฟยชอบอ่านหนังสือและฟังเพลง

เอลาด ดเว็ก เป็นผู้จัดการเทคโนโลยีการก่อสร้างที่ Amazon ด้วยพื้นฐานด้านการก่อสร้างและการบริหารโครงการ Elad ช่วยให้ทีมนำเทคโนโลยีใหม่และกระบวนการที่อิงข้อมูลมาใช้ในการส่งมอบโครงการก่อสร้าง เขาระบุความต้องการและแนวทางแก้ไข และอำนวยความสะดวกในการพัฒนาคุณลักษณะที่ตรงตามความต้องการ เอลาดสำเร็จการศึกษาระดับปริญญาโทสาขาบริหารธุรกิจและปริญญาตรีสาขาวิศวกรรมโครงสร้าง นอกเหนือจากการทำงาน เอลาดชอบเล่นโยคะ ทำงานไม้ และท่องเที่ยวกับครอบครัว

เอลาด ดเว็ก เป็นผู้จัดการเทคโนโลยีการก่อสร้างที่ Amazon ด้วยพื้นฐานด้านการก่อสร้างและการบริหารโครงการ Elad ช่วยให้ทีมนำเทคโนโลยีใหม่และกระบวนการที่อิงข้อมูลมาใช้ในการส่งมอบโครงการก่อสร้าง เขาระบุความต้องการและแนวทางแก้ไข และอำนวยความสะดวกในการพัฒนาคุณลักษณะที่ตรงตามความต้องการ เอลาดสำเร็จการศึกษาระดับปริญญาโทสาขาบริหารธุรกิจและปริญญาตรีสาขาวิศวกรรมโครงสร้าง นอกเหนือจากการทำงาน เอลาดชอบเล่นโยคะ ทำงานไม้ และท่องเที่ยวกับครอบครัว

ลูก้า เซราโบน เป็นวิศวกรระบบธุรกิจอัจฉริยะที่ Amazon จากภูมิหลังของเขาในด้านวิทยาศาสตร์ข้อมูลและการวิเคราะห์ Luca สร้างสรรค์โซลูชันทางเทคนิคที่ปรับแต่งให้ตรงกับความต้องการเฉพาะของลูกค้า ขับเคลื่อนพวกเขาไปสู่กระบวนการที่ยั่งยืนและปรับขนาดได้มากขึ้น ด้วยปริญญาโทสาขาวิทยาศาสตร์ข้อมูล Luca สนุกกับการทำโปรเจ็กต์ DIY ทำสวน และทดลองทำอาหารในช่วงเวลาว่าง

ลูก้า เซราโบน เป็นวิศวกรระบบธุรกิจอัจฉริยะที่ Amazon จากภูมิหลังของเขาในด้านวิทยาศาสตร์ข้อมูลและการวิเคราะห์ Luca สร้างสรรค์โซลูชันทางเทคนิคที่ปรับแต่งให้ตรงกับความต้องการเฉพาะของลูกค้า ขับเคลื่อนพวกเขาไปสู่กระบวนการที่ยั่งยืนและปรับขนาดได้มากขึ้น ด้วยปริญญาโทสาขาวิทยาศาสตร์ข้อมูล Luca สนุกกับการทำโปรเจ็กต์ DIY ทำสวน และทดลองทำอาหารในช่วงเวลาว่าง

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/improve-llm-performance-with-human-and-ai-feedback-on-amazon-sagemaker-for-amazon-engineering/