亞馬遜歐盟設計和建造(Amazon D&C)團隊是設計和建造亞馬遜倉庫的工程團隊。團隊瀏覽大量文件並找到正確的訊息,以確保倉庫設計符合最高標準。在文中 Amazon SageMaker 上基於 AI 的生成解決方案可協助 Amazon EU 設計和施工,我們提出了一個問答機器人解決方案,使用 檢索增強生成 (RAG) 管道經過微調 大型語言模型 (LLM) 幫助 Amazon D&C 從大量無組織的文檔中高效檢索準確信息,並為其建設項目提供及時、高品質的服務。 Amazon D&C 團隊在 Amazon 工程師的試點中實施了此解決方案並收集了使用者回饋。

在這篇文章中,我們分享瞭如何分析回饋資料並識別 RAG 提供的準確性和幻覺的局限性,並使用人類評估分數來訓練模型: 強化學習。為了增加訓練樣本以更好地學習,我們還使用了另一個法學碩士來產生回饋分數。該方法解決了 RAG 限制並進一步提高了機器人響應品質。我們展示強化學習過程和基準測試結果來展示法學碩士的表現改進。該解決方案使用 亞馬遜SageMaker JumpStart 作為模型部署、微調和強化學習的核心服務。

在試點計畫中收集亞馬遜工程師的回饋

開發出中所描述的解決方案後 Amazon SageMaker 上基於 AI 的生成解決方案可協助 Amazon EU 設計和施工,Amazon D&C 團隊部署了該解決方案,並與 Amazon 工程師一起運行了一個試點專案。工程師們透過開發的網路應用程式存取了試點系統 流光,與RAG管道連接。在管道中,我們使用了 亞馬遜開放搜索服務 用於向量資料庫,並在 Amazon SageMaker 上部署了經過微調的 Mistral-7B-Instruct 模型。

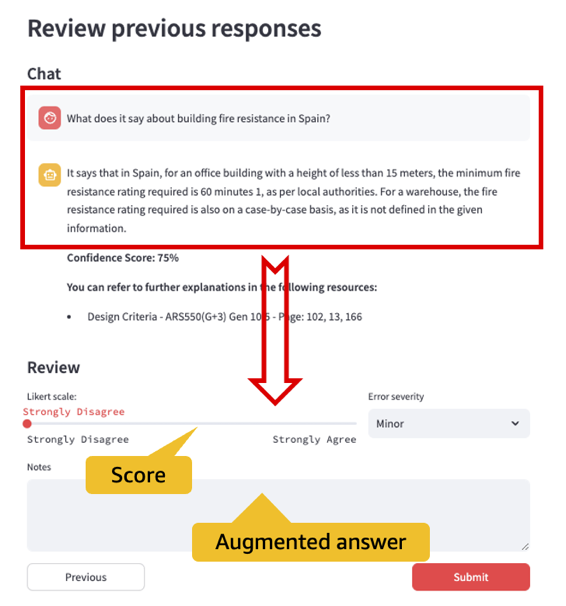

該試點計畫的主要目標之一是收集亞馬遜工程師的回饋,並利用這些回饋進一步減少 LLM 幻覺。為了實現這一點,我們在UI中開發了回饋收集模組,如下圖所示,並將Web會話資訊和使用者回饋儲存在 亞馬遜DynamoDB。透過回饋收集UI,亞馬遜工程師可以從五個滿意度等級中進行選擇:強烈不同意、不同意、中立、同意和強烈同意,對應於1-5的回饋分數。他們還可以對問題提供更好的答案或評論為什麼法學碩士的回答不令人滿意。

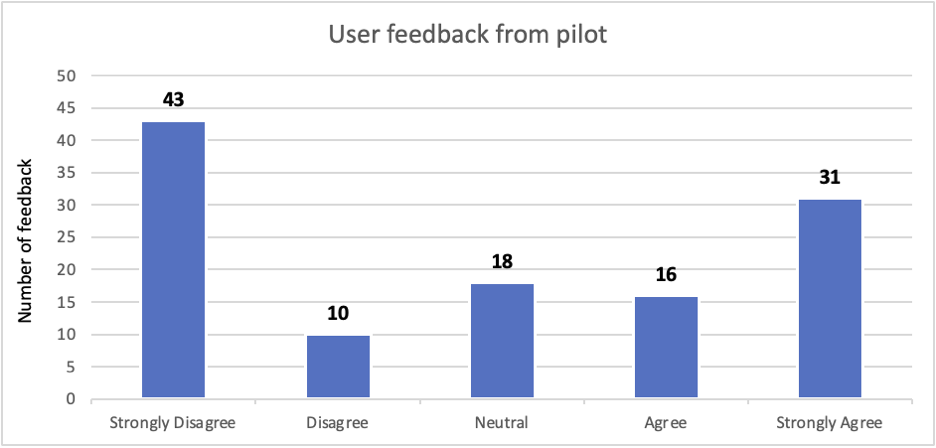

試點期間,用戶提供了 118 個回饋。下圖顯示了從負到正的分佈。我們觀察到,以負面回饋(不同意和強烈不同意)標記的錯誤答案佔總回饋的 45%(53 條中的 118 條)。一些錯誤(大約 10% 的負面回饋和 7.5% 的整體回應)可以透過使用者教育和提示工程來解決。此外,我們可以透過LLM微調和強化學習的解決方案來解決這個問題,如下一節所述。

有些用戶只是留言,例如“太棒了!”對於非常同意的答案,或“不回答問題”對於強烈不同意的答案。其他用戶提供了分數,並解釋了他們如何在筆記中證明法學碩士答案的合理性。在下面的例子中,使用者特別提供了足夠的文件和內容來糾正LLM的幻覺。

| 問題 | 我們有多少個停車位? |

| 機器人回答 |

根據給定的上下文,我們沒有足夠的資訊來確定停車位的數量。上下文討論了停車位的最小尺寸以及外部照明水平的要求,但沒有提供特定的停車位數量。 **您可以參考以下資源中的進一步說明:** * ARS GEN 10.0/05.01.02。設計標準與附錄/效能套件 AR 可排序設計標準 v20.1.1.pdf – 頁:10 * ARS GEN 10.0/05.01.02。設計標準與附錄/效能套件 AR 可排序設計標準 v20.1.1.pdf – 頁:79 |

| 用戶評分 | 強烈反對 |

| 用戶註釋 | 設計標準第 21 頁第 01 13 10 節對此進行了規定 |

透過監督微調和強化學習來提高機器人反應

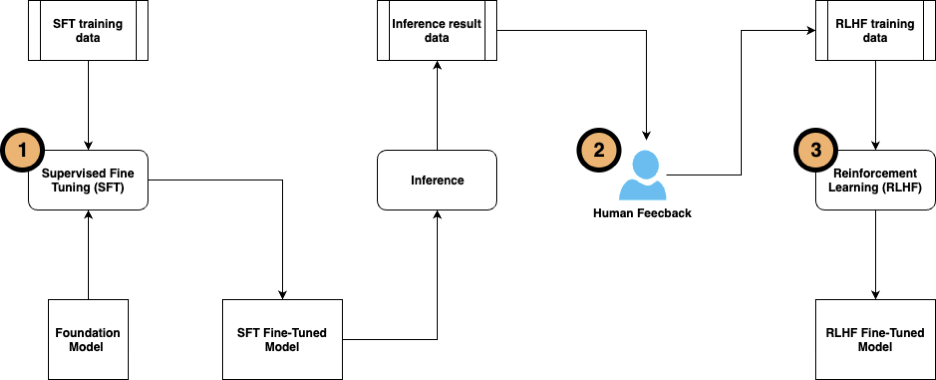

該解決方案包括三個微調步驟:

- 使用標記資料進行監督微調。該方法描述於 Amazon SageMaker 上基於 AI 的生成解決方案可協助 Amazon EU 設計和施工.

- 收集使用者回饋來標記問答對,以進行進一步的 LLM 調整。

- 當訓練資料準備好後,使用進一步調整模型 從人類反饋中強化學習 (RLHF)。

RLHF 廣泛應用於生成人工智慧 (AI) 和法學碩士應用程式。它將人類回饋納入獎勵函數,並使用強化學習演算法訓練模型以最大化獎勵,這使得模型執行的任務更符合人類目標。下圖顯示了步驟的流程。

我們使用 Amazon D&C 文件以及 SageMaker JumpStart 上的 Mistral-7B 模型測試了該方法。

監督微調

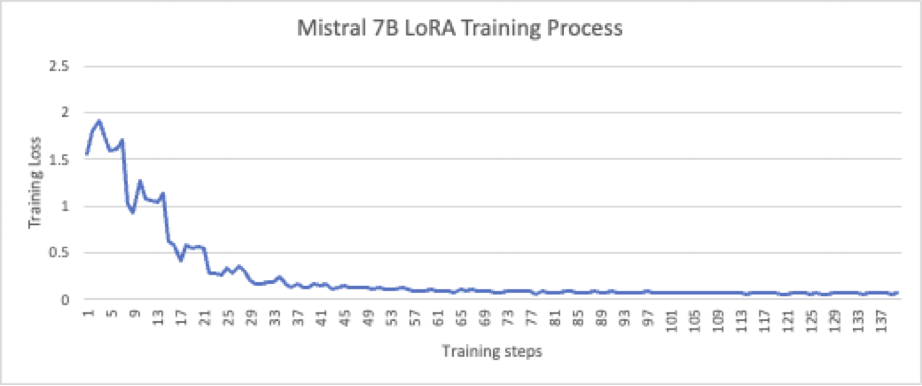

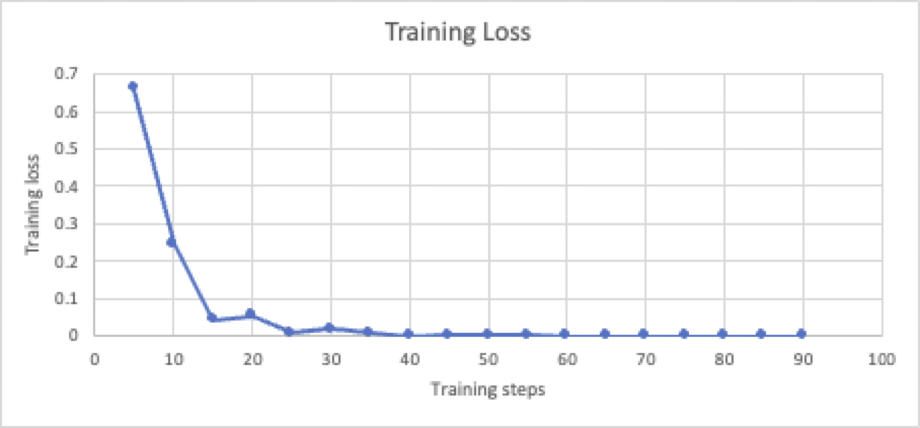

在上一篇文章中,我們示範了經過微調的 Falcon-7B 模型如何超越 RAG 管道並提高 QA 機器人回應的品質和準確性。在這篇文章中,我們對 Mistral-7B 模型進行了監督微調。監督微調使用 PEFT/LoRA 技術(LoRA_r = 512,LoRA_alpha = 1024)對 436,207,616 個參數(總共 5.68 個參數的 7,677,964,288%)進行調整。訓練在 p3.8x 節點上進行,由 LLM 綜合生成並由人類驗證的 137 個樣本;過程在 20 個 epoch 後收斂良好,如下圖所示。

微調後的模型透過274個樣本進行驗證,並透過語意相似度分數將推理結果與參考答案進行比較。得分為0.8100,高於傳統RAG的得分0.6419。

收集人類和人工智慧回饋以進行強化學習

對於 RLHF,足夠數量的主題專家 (SME) 標記的高品質訓練樣本至關重要。然而,品質差的人類標籤可能會導致 RLHF 訓練後的模型表現比原始模型更差。中小企業的時代是 任何組織中的稀缺資源;審核數百或數千份法學碩士回覆並提供回饋需要中小型企業投入大量時間,而這些投資可能沒有明確的回報。

為了應對這項挑戰,我們採用了 根據人工智慧回饋進行強化學習 (RLAIF)法。 RLAIF 聘請人工智慧助理(另一位法學碩士)來提供評估分數,而不是由人類提供。在這種混合學習方法中,學習代理不僅基於與人類的交互,還根據另一個人工智慧模型提供的回饋來完善動作。它更具可擴展性,可以為強化學習提供足夠的訓練數據,而且主觀性也更小,因為訓練不依賴一小群中小企業的特定偏好。中小企業可能仍然會參與其中,但只是為了監督流程並檢查人工智慧回饋的品質。這大大減少了中小企業的工作量,因為人工智慧產生的分數和標籤對於中小企業來說分析、過濾和排序要簡單得多。

在此用例中,我們向 Anthropic Claude 2 模型提供以下提示,以產生評估分數作為強化學習步驟的訓練樣本:

Claude 2 模型會產生評估分數以及給出該分數的原因的評論,如下例所示。

| 問題 | 在這種情況下,「裝修工程」是什麼意思? |

| 參考答案 | 裝修工程是指由開發商或代表亞馬遜透過開發商在首次接收日期之前從名義開發商外殼和核心基礎建造位置根據施工合約進行的工程。這些工程包括亞馬遜所需的裝修、大型安裝和定制 |

| QA 機器人回應 | 裝修工程是指由開發商或代表亞馬遜透過開發商在首次接收日期之前從名義開發商外殼和核心基礎建造位置根據施工合約進行的工程。 |

| 人工智慧評分 | 4.5 |

| 人工智慧評論 | 機器答案提供了標準答案中的關鍵資訊——裝修工程是指由亞馬遜或代表亞馬遜透過開發商在首次接收日期之前從名義開發商外殼和核心基礎建造位置根據施工合約進行的工程。關於包括亞馬遜所需的裝修、大型安裝和定制的其他詳細信息是相關的,有助於提供進一步的背景信息,因此我給機器答案打了4.5 分(滿分5 分)。的本質,並提供了一些有用的額外細節。 |

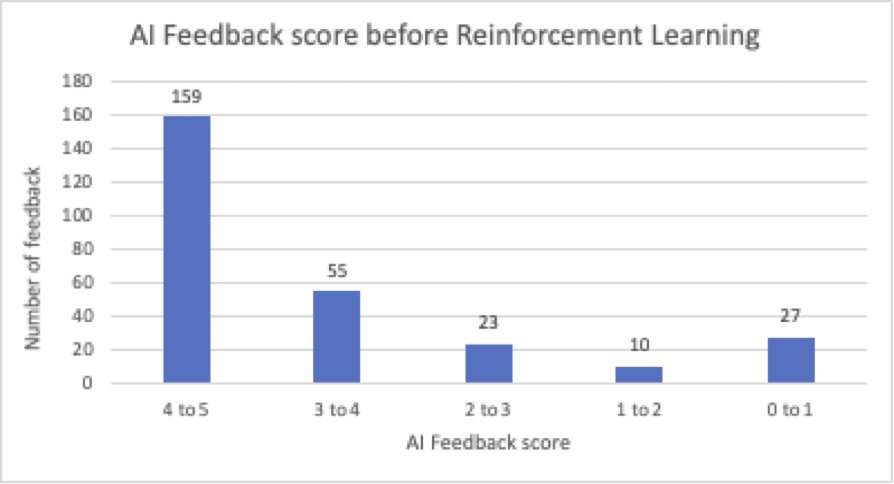

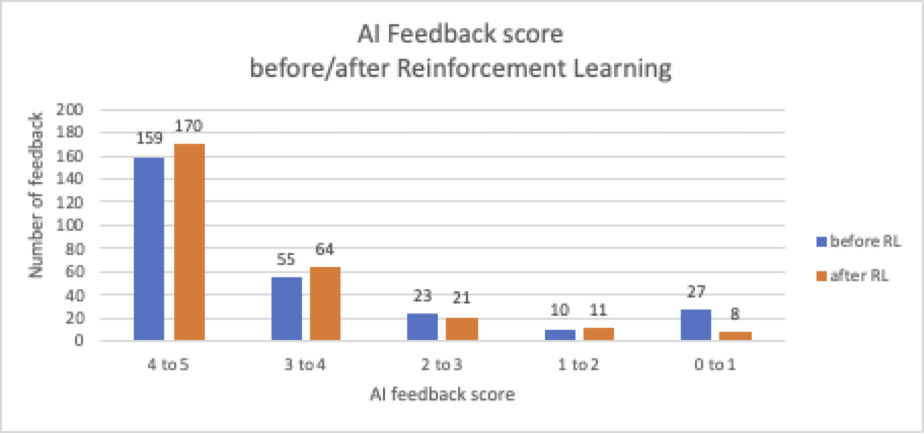

在 274 個驗證問題中,監督微調模型產生了 159 個 AI 分數大於 4 的答案。整體響應品質還有提升空間。

亞馬遜工程中小企業驗證了這項人工智慧回饋,並承認使用人工智慧分數的好處。如果沒有人工智慧回饋,中小企業將需要一些時間來審查和分析每個法學碩士的回答,以識別截止答案和幻覺,並判斷法學碩士是否返回了正確的內容和關鍵概念。 AI 回饋可自動提供 AI 分數,並使中小企業能夠使用篩選、排序和分組來驗證分數並識別回應中的趨勢。這使中小企業的平均審核時間減少了 80%。

根據人類和人工智慧回饋進行強化學習

當訓練樣本準備好後,我們使用 近端策略優化(PPO)演算法 執行強化學習。 PPO採用策略梯度方法,在學習過程中以小步長更新策略,使學習代理可靠地達到最優策略網路。這使得訓練過程更加穩定,減少發散的可能性。

在訓練過程中,我們首先使用人類和人工智慧標記的資料來建立獎勵模型,該模型將用於指導學習過程中的權重更新。對於這個用例,我們選擇一個基於 distilroberta 的獎勵模型,並透過以下格式的樣本進行訓練:

[Instruction, Chosen_response, Rejected_response]

以下是培訓記錄的範例。

| 説明書 | 根據上下文,包容性和無障礙設計的具體內容是什麼? |

| 選擇的回應 | BREEAM 信用度 HEA06 – 包容性和無障礙設計 – 建築的設計適合其用途,適合所有潛在用戶且易於使用。根據 BREEAM 檢查表 A3 制定存取策略 |

| 拒絕回應 | 上下文指出 |

獎勵模型使用學習率 1e-5 進行訓練。如下圖所示,訓練在 10 個 epoch 後收斂良好。

然後使用獎勵模型進行強化學習。對於這個用例,我們使用 PEFT/LoRA 來加速學習。 LoRA_r 為 32,LoRA_alpha 為 64。強化訓練波動性很大,對標籤資料和回饋資料非常敏感。我們使用reward_mean指標(透過專門監控獎勵模型從環境中獲得的平均獎勵)來觀察學習過程。

RLAIF 後,我們可以看到評分為正(3 以上)的機器人回應數量從 78.1% 增加到 85.5%,而評分為負(3 以下)的機器人回應數量從 21.9% 下降到 14.5%。總的來說,平均 AI 回饋分數從 8 提高到 3.9,提高了 4.2%。

您可以在以下範例中看到改進。

| 問題 | 對於鋪瓷磚的地板區域,需要什麼砂漿? |

| 參數支持 | 混凝土找平層地板僅適用於鋪有地磚的區域。請參閱圖系列 A-32,以了解地磚的適用範圍。 |

| RLAIF 之前的機器人回應 | 混凝土找平層地板僅適用於 |

| RLAIF 之前的 AI 分數 | 3 |

| RLAIF 後機器人回應 | 混凝土找平層地板僅適用於鋪有磁磚的區域。請參閱圖系列 A-32,以了解磁磚地板的適用範圍。 |

| RLAIF 後的 AI 分數 | 4.5 |

結論

這篇文章是我們與亞馬遜歐盟設計和施工團隊合作的延續,如 Amazon SageMaker 上基於 AI 的生成解決方案可協助 Amazon EU 設計和施工。在這篇文章中,我們展示瞭如何產生人類和人工智慧回饋數據,以透過強化學習來微調 Mistral-7B 模型。 RLAIF 之後的模型為 Amazon Engineering 的問答機器人提供了更好的性能,將 AI 回饋分數提高了 8%。在 Amazon D&C 團隊的試點計畫中,使用 RLAIF 預計將中小企業的驗證工作量減少了 80%。下一步,我們將透過與 Amazon Engineering 的資料基礎設施連接來擴展此解決方案,並設計一個框架來自動化持續學習過程,並讓人員參與其中。我們也將透過調整提示模板來進一步提高AI反饋品質。

透過這個過程,我們學習如何透過RLHF和RLAIF進一步提高問答任務的品質和表現。

- 人工驗證和增強對於提供準確且負責任的法學碩士輸出至關重要。人體回饋可用於 RLHF,以進一步改善模型響應。

- RLAIF 自動化評估和學習週期。人工智慧產生的回饋不太主觀,因為它不依賴一小部分中小企業的特定偏好。

- RLAIF 更具可擴展性,可透過持續的強化學習來提高機器人質量,同時最大限度地減少中小企業所需的工作量。它對於在大型組織內開發特定領域的生成式人工智慧解決方案特別有用。

- 應定期執行此流程,特別是當解決方案可以覆蓋新的網域資料時。

在此用例中,我們使用 SageMaker JumpStart 測試多個 LLM 並嘗試多種 LLM 訓練方法。它以最大化的效率和品質顯著加速人工智慧回饋和學習週期。對於您自己的項目,您可以引入人機互動方法來收集使用者的回饋,或使用其他法學碩士產生人工智慧回饋。然後,您可以按照本文中定義的三步驟流程,使用 RLHF 和 RLAIF 微調您的模型。我們建議使用 SageMaker JumpStart 來嘗試這些方法來加速流程。

關於作者

白雲飛 是 AWS 的高級解決方案架構師。 憑藉 AI/ML、數據科學和分析方面的背景,Yunfei 幫助客戶採用 AWS 服務來交付業務成果。 他設計 AI/ML 和數據分析解決方案,以克服複雜的技術挑戰並推動戰略目標。 雲飛擁有電子電氣工程博士學位。 工作之餘,雲飛喜歡閱讀和音樂。

白雲飛 是 AWS 的高級解決方案架構師。 憑藉 AI/ML、數據科學和分析方面的背景,Yunfei 幫助客戶採用 AWS 服務來交付業務成果。 他設計 AI/ML 和數據分析解決方案,以克服複雜的技術挑戰並推動戰略目標。 雲飛擁有電子電氣工程博士學位。 工作之餘,雲飛喜歡閱讀和音樂。

埃拉德·德韋克 是亞馬遜的建築技術經理。 Elad 擁有建築和專案管理背景,幫助團隊採用新技術和基於數據的流程來交付建築專案。 他確定需求和解決方案,並促進客製化屬性的開發。 Elad 擁有 MBA 學位和結構工程學士學位。 工作之餘,埃拉德喜歡瑜珈、木工和與家人一起旅行。

埃拉德·德韋克 是亞馬遜的建築技術經理。 Elad 擁有建築和專案管理背景,幫助團隊採用新技術和基於數據的流程來交付建築專案。 他確定需求和解決方案,並促進客製化屬性的開發。 Elad 擁有 MBA 學位和結構工程學士學位。 工作之餘,埃拉德喜歡瑜珈、木工和與家人一起旅行。

盧卡·塞拉邦 是亞馬遜的商業智慧工程師。 Luca 憑藉其在數據科學和分析方面的背景,精心設計了量身定制的技術解決方案,以滿足客戶的獨特需求,推動他們走向更永續和可擴展的流程。 Luca 擁有數據科學碩士學位,喜歡在閒暇時參與 DIY 專案、園藝和嘗試美食。

盧卡·塞拉邦 是亞馬遜的商業智慧工程師。 Luca 憑藉其在數據科學和分析方面的背景,精心設計了量身定制的技術解決方案,以滿足客戶的獨特需求,推動他們走向更永續和可擴展的流程。 Luca 擁有數據科學碩士學位,喜歡在閒暇時參與 DIY 專案、園藝和嘗試美食。

- SEO 支持的內容和 PR 分發。 今天得到放大。

- PlatoData.Network 垂直生成人工智能。 賦予自己力量。 訪問這裡。

- 柏拉圖愛流。 Web3 智能。 知識放大。 訪問這裡。

- 柏拉圖ESG。 碳, 清潔科技, 能源, 環境, 太陽能, 廢物管理。 訪問這裡。

- 柏拉圖健康。 生物技術和臨床試驗情報。 訪問這裡。

- 資源: https://aws.amazon.com/blogs/machine-learning/improve-llm-performance-with-human-and-ai-feedback-on-amazon-sagemaker-for-amazon-engineering/