亚马逊欧盟设计和建造(Amazon D&C)团队是设计和建造亚马逊仓库的工程团队。该团队浏览大量文档并找到正确的信息,以确保仓库设计符合最高标准。在文中 Amazon SageMaker 上基于 AI 的生成解决方案可帮助 Amazon EU 设计和施工,我们提出了一个问答机器人解决方案,使用 检索增强生成 (RAG) 管道经过微调 大语言模型 (LLM) 帮助 Amazon D&C 从大量无组织的文档中高效检索准确信息,并为其建设项目提供及时、高质量的服务。 Amazon D&C 团队在 Amazon 工程师的试点中实施了该解决方案并收集了用户反馈。

在这篇文章中,我们分享了如何分析反馈数据并识别 RAG 提供的准确性和幻觉的局限性,并使用人类评估分数来训练模型: 强化学习。为了增加训练样本以更好地学习,我们还使用了另一个法学硕士来生成反馈分数。该方法解决了 RAG 限制并进一步提高了机器人响应质量。我们展示强化学习过程和基准测试结果来展示法学硕士的性能改进。该解决方案使用 亚马逊SageMaker JumpStart 作为模型部署、微调和强化学习的核心服务。

在试点项目中收集亚马逊工程师的反馈

开发出中描述的解决方案后 Amazon SageMaker 上基于 AI 的生成解决方案可帮助 Amazon EU 设计和施工,Amazon D&C 团队部署了该解决方案,并与 Amazon 工程师一起运行了一个试点项目。工程师们通过开发的网络应用程序访问了试点系统 流光,与RAG管道连接。在管道中,我们使用了 亚马逊开放搜索服务 用于矢量数据库,并在 Amazon SageMaker 上部署了经过微调的 Mistral-7B-Instruct 模型。

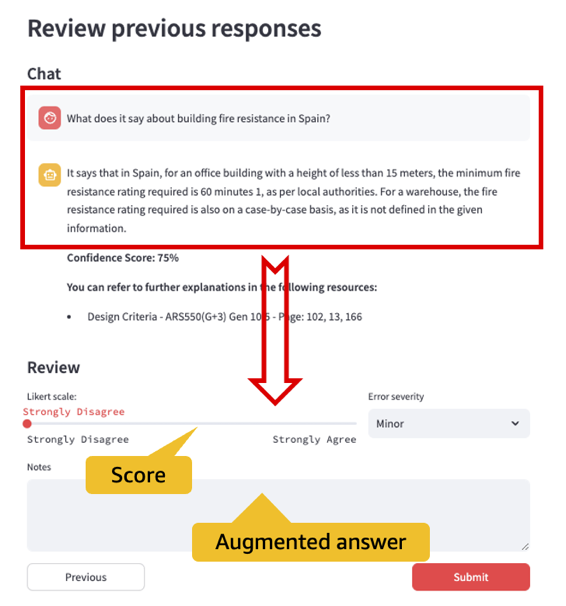

该试点项目的主要目标之一是收集亚马逊工程师的反馈,并利用这些反馈进一步减少 LLM 幻觉。为了实现这一点,我们在UI中开发了反馈收集模块,如下图所示,并将Web会话信息和用户反馈存储在 Amazon DynamoDB。通过反馈收集UI,亚马逊工程师可以从五个满意度级别中进行选择:强烈不同意、不同意、中立、同意和强烈同意,对应于1-5的反馈分数。他们还可以对问题提供更好的答案或评论为什么法学硕士的回答不令人满意。

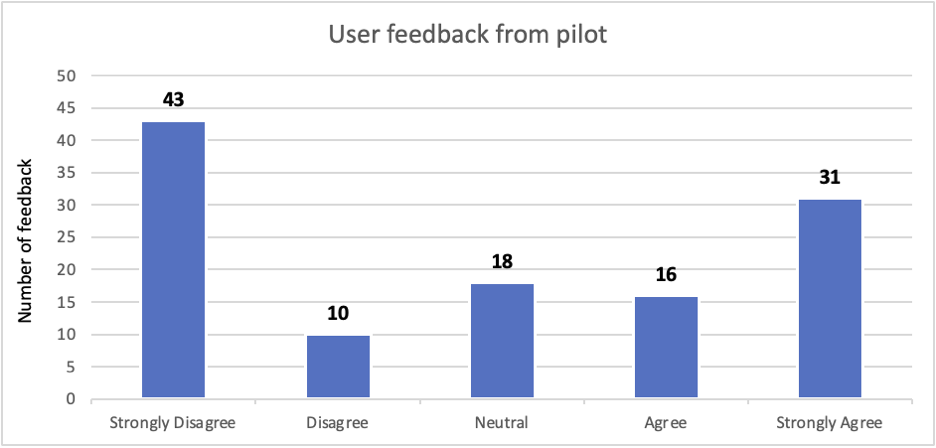

试点期间,用户提供了 118 条反馈。下图显示了从负到正的分布。我们观察到,以负面反馈(不同意和强烈不同意)标记的错误答案占总反馈的 45%(53 条中的 118 条)。一些错误(大约 10% 的负面反馈和 7.5% 的总体响应)可以通过用户教育和提示工程来解决。此外,我们可以通过LLM微调和强化学习的解决方案来解决这个问题,如下一节所述。

有些用户只是留言,例如“太棒了!”对于强烈同意的答案,或“不回答问题”对于强烈不同意的答案。其他用户提供了分数,并解释了他们如何在笔记中证明法学硕士答案的合理性。在下面的例子中,用户专门提供了足够的文档和内容来纠正LLM的幻觉。

| 问题 | 我们有多少个停车位? |

| 机器人回答 |

根据给定的上下文,我们没有足够的信息来确定停车位的数量。上下文讨论了停车位的最小尺寸以及外部照明水平的要求,但没有提供具体的停车位数量。 **您可以参考以下资源中的进一步说明:** * ARS GEN 10.0/05.01.02。设计标准和附录/性能包 AR 可排序设计标准 v20.1.1.pdf – 页:10 * ARS GEN 10.0/05.01.02。设计标准和附录/性能包 AR 可排序设计标准 v20.1.1.pdf – 页:79 |

| 用户评分 | 强烈反对 |

| 用户备注 | 设计标准第 21 页第 01 13 10 节对此进行了规定 |

通过监督微调和强化学习提高机器人响应

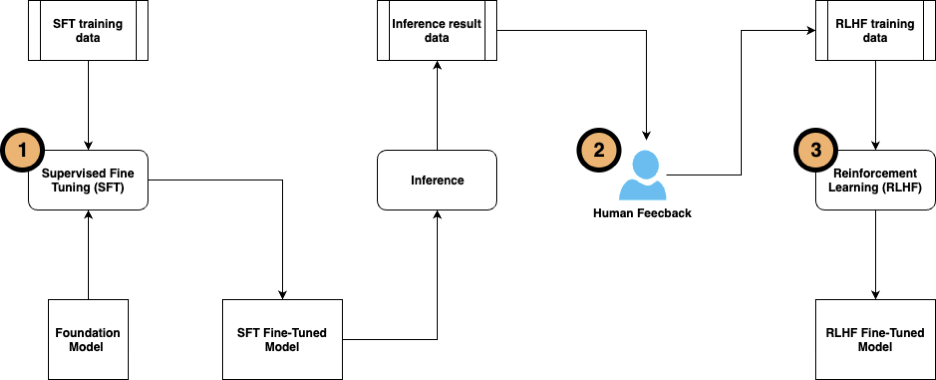

该解决方案包括三个微调步骤:

- 使用标记数据进行监督微调。该方法描述于 Amazon SageMaker 上基于 AI 的生成解决方案可帮助 Amazon EU 设计和施工.

- 收集用户反馈来标记问答对,以进行进一步的 LLM 调整。

- 当训练数据准备好后,使用进一步调整模型 从人类反馈强化学习 (RLHF)。

RLHF 广泛应用于生成人工智能 (AI) 和法学硕士应用程序。它将人类反馈纳入奖励函数,并使用强化学习算法训练模型以最大化奖励,这使得模型执行的任务更符合人类目标。下图显示了步骤的流程。

我们使用 Amazon D&C 文档以及 SageMaker JumpStart 上的 Mistral-7B 模型测试了该方法。

监督微调

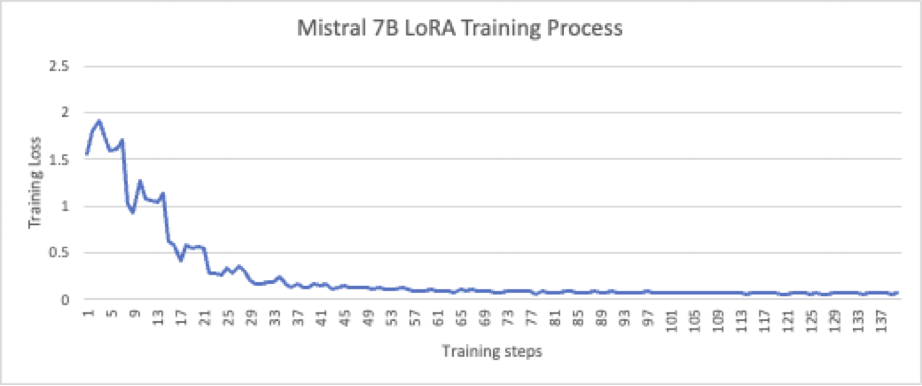

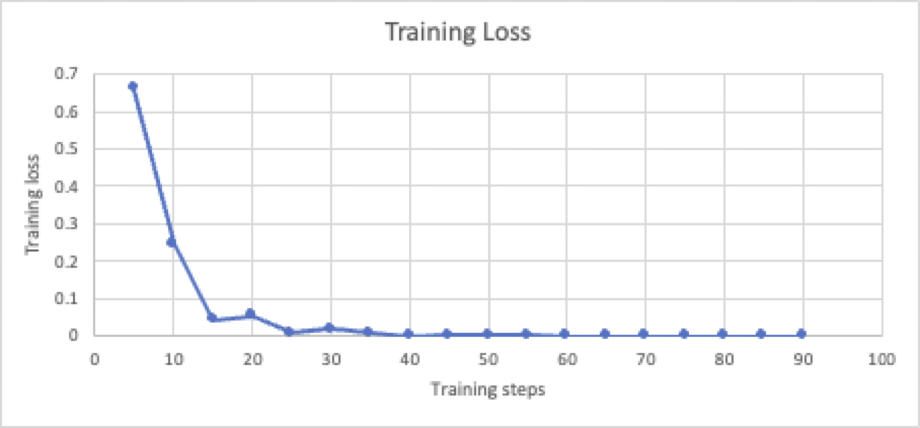

在上一篇文章中,我们演示了经过微调的 Falcon-7B 模型如何超越 RAG 管道并提高 QA 机器人响应的质量和准确性。在这篇文章中,我们对 Mistral-7B 模型进行了监督微调。监督微调使用 PEFT/LoRA 技术(LoRA_r = 512,LoRA_alpha = 1024)对 436,207,616 个参数(总共 5.68 个参数的 7,677,964,288%)进行调整。训练在 p3.8x 节点上进行,由 LLM 综合生成并由人类验证的 137 个样本;该过程在 20 个 epoch 后收敛良好,如下图所示。

微调后的模型通过274个样本进行验证,并通过语义相似度得分将推理结果与参考答案进行比较。得分为0.8100,高于传统RAG的得分0.6419。

收集人类和人工智能反馈以进行强化学习

对于 RLHF,足够数量的由主题专家 (SME) 标记的高质量训练样本至关重要。然而,质量差的人类标签可能会导致 RLHF 训练后的模型性能比原始模型更差。中小企业的时代是 任何组织中的稀缺资源;审核数百或数千份法学硕士回复并提供反馈需要中小型企业投入大量时间,而这些投资可能没有明确的回报。

为了应对这一挑战,我们采用了 根据人工智能反馈进行强化学习 (RLAIF)方法。 RLAIF 聘请人工智能助手(另一位法学硕士)来提供评估分数,而不是由人类提供。在这种混合学习方法中,学习代理不仅基于与人类的交互,还根据另一个人工智能模型提供的反馈来完善动作。它更具可扩展性,可以为强化学习提供足够的训练数据,而且主观性也更小,因为训练不依赖于一小群中小企业的特定偏好。中小企业可能仍会参与,但只是为了监督流程并检查人工智能反馈质量。这极大地减少了中小企业的工作量,因为人工智能生成的分数和标签对于中小企业来说分析、过滤和排序要简单得多。

在此用例中,我们向 Anthropic Claude 2 模型提供以下提示,以生成评估分数作为强化学习步骤的训练样本:

Claude 2 模型会生成一个评估分数以及给出该分数的原因的评论,如以下示例所示。

| 问题 | 在这种情况下,“装修工程”是什么意思? |

| 参考答案 | 装修工程是指由开发商或代表亚马逊通过开发商在首次接收日期之前从名义开发商外壳和核心基础建造位置根据施工合同进行的工程。这些工程包括亚马逊所需的装修、大型安装和定制 |

| QA 机器人响应 | 装修工程是指由开发商或代表亚马逊通过开发商在首次接收日期之前从名义开发商外壳和核心基础建造位置根据施工合同进行的工程。 |

| 人工智能评分 | 4.5 |

| 人工智能评论 | 机器答案提供了标准答案中的关键信息——装修工程是指由亚马逊或代表亚马逊通过开发商在首次接收日期之前从名义开发商外壳和核心基础建造位置根据施工合同进行的工程。关于包括亚马逊所需的装修、大型安装和定制的其他详细信息是相关的,有助于提供进一步的背景信息,因此我给机器答案打了 4.5 分(满分 5 分)。它抓住了标准答案的本质,并提供了一些有用的额外细节。 |

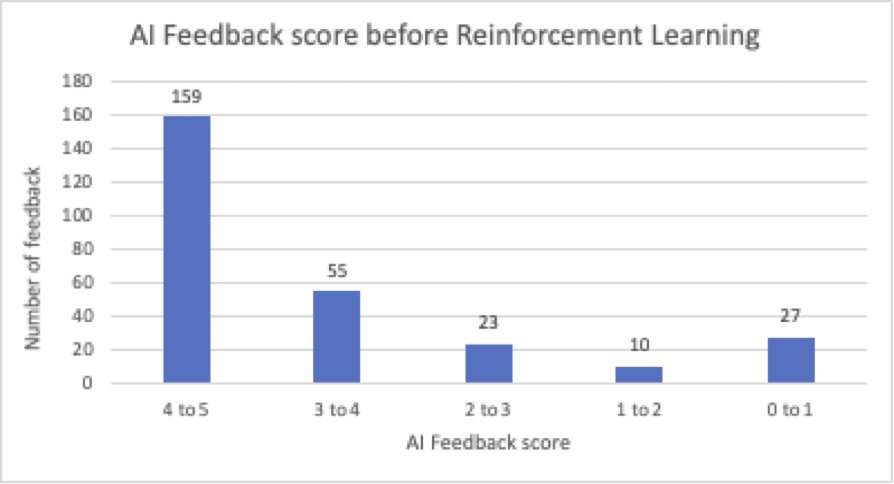

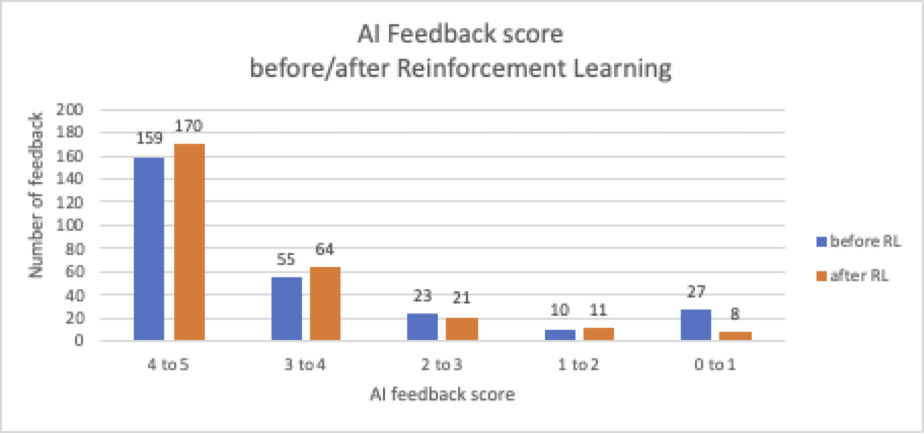

在 274 个验证问题中,监督微调模型生成了 159 个 AI 分数大于 4 的答案。我们观察到 60 个答案的分数低于 3;整体响应质量还有提升空间。

亚马逊工程中小企业验证了这一人工智能反馈,并承认使用人工智能分数的好处。如果没有人工智能反馈,中小企业将需要一些时间来审查和分析每个法学硕士的回答,以识别截止答案和幻觉,并判断法学硕士是否返回了正确的内容和关键概念。 AI 反馈自动提供 AI 分数,并使中小企业能够使用过滤、排序和分组来验证分数并识别响应中的趋势。这使中小企业的平均审核时间减少了 80%。

根据人类和人工智能反馈进行强化学习

当训练样本准备好后,我们使用 近端策略优化(PPO)算法 执行强化学习。 PPO采用策略梯度方法,在学习过程中以小步长更新策略,使学习代理能够可靠地达到最优策略网络。这使得训练过程更加稳定,减少发散的可能性。

在训练过程中,我们首先使用人类和人工智能标记的数据构建奖励模型,该模型将用于指导学习过程中的权重更新。对于这个用例,我们选择一个基于 distilroberta 的奖励模型,并通过以下格式的样本对其进行训练:

[Instruction, Chosen_response, Rejected_response]

以下是培训记录的示例。

| 操作说明 | 根据上下文,包容性和无障碍设计的具体内容是什么? |

| 选择的响应 | BREEAM 信用度 HEA06 – 包容性和无障碍设计 – 该建筑的设计适合其用途,适合所有潜在用户且易于使用。根据 BREEAM 检查表 A3 制定访问策略 |

| 拒绝响应 | 上下文指出 |

奖励模型使用学习率 1e-5 进行训练。如下图所示,训练在 10 个 epoch 后收敛良好。

然后使用奖励模型进行强化学习。对于这个用例,我们使用 PEFT/LoRA 来加速学习。 LoRA_r 为 32,LoRA_alpha 为 64。基于 PPO 的学习在三个 epoch 中的速率为 1.41e-5。强化训练波动性很大,对标签数据和反馈数据非常敏感。我们使用reward_mean指标(通过专门监控奖励模型从环境中获得的平均奖励)来观察学习过程。

RLAIF 后,我们可以看到评分为正(3 以上)的机器人响应数量从 78.1% 增加到 85.5%,而评分为负(3 以下)的机器人响应数量从 21.9% 下降到 14.5%。总体而言,平均 AI 反馈分数从 8 提高到 3.9,提高了 4.2%。

您可以在以下示例中看到改进。

| 问题 | 对于铺瓷砖的地板区域,需要什么砂浆? |

| 参考文献 | 混凝土找平层地板仅适用于铺有地砖的区域。请参阅图系列 A-32,了解地砖的适用范围。 |

| RLAIF 之前的机器人响应 | 混凝土找平层地板仅适用于 |

| RLAIF 之前的 AI 分数 | 3 |

| RLAIF 后机器人响应 | 混凝土找平层地板仅适用于铺有瓷砖的区域。请参阅图系列 A-32,了解瓷砖地板的适用范围。 |

| RLAIF 后的 AI 分数 | 4.5 |

结论

这篇文章是我们与亚马逊欧盟设计和施工团队合作的延续,如 Amazon SageMaker 上基于 AI 的生成解决方案可帮助 Amazon EU 设计和施工。在这篇文章中,我们展示了如何生成人类和人工智能反馈数据,以通过强化学习微调 Mistral-7B 模型。 RLAIF 之后的模型为 Amazon Engineering 的问答机器人提供了更好的性能,将 AI 反馈分数提高了 8%。在 Amazon D&C 团队的试点项目中,使用 RLAIF 预计将中小企业的验证工作量减少了 80%。下一步,我们将通过与 Amazon Engineering 的数据基础设施连接来扩展该解决方案,并设计一个框架来自动化持续学习过程,并让人员参与其中。我们还将通过调整提示模板来进一步提高AI反馈质量。

通过这个过程,我们学习了如何通过RLHF和RLAIF进一步提高问答任务的质量和性能。

- 人工验证和增强对于提供准确且负责任的法学硕士输出至关重要。人类反馈可用于 RLHF,以进一步改善模型响应。

- RLAIF 自动化评估和学习周期。人工智能生成的反馈不太主观,因为它不依赖于一小部分中小企业的特定偏好。

- RLAIF 更具可扩展性,可以通过持续的强化学习来提高机器人质量,同时最大限度地减少中小企业所需的工作量。它对于在大型组织内开发特定领域的生成式人工智能解决方案特别有用。

- 应定期执行此过程,特别是当解决方案可以覆盖新的域数据时。

在此用例中,我们使用 SageMaker JumpStart 测试多个 LLM 并尝试多种 LLM 训练方法。它以最大化的效率和质量显着加速人工智能反馈和学习周期。对于您自己的项目,您可以引入人机交互方法来收集用户的反馈,或使用其他法学硕士生成人工智能反馈。然后,您可以按照本文中定义的三步流程,使用 RLHF 和 RLAIF 微调您的模型。我们建议尝试使用 SageMaker JumpStart 的方法来加速该过程。

关于作者

白云飞 是 AWS 的高级解决方案架构师。 凭借 AI/ML、数据科学和分析方面的背景,Yunfei 帮助客户采用 AWS 服务来交付业务成果。 他设计 AI/ML 和数据分析解决方案,以克服复杂的技术挑战并推动战略目标。 云飞拥有电子电气工程博士学位。 工作之余,云飞喜欢阅读和音乐。

白云飞 是 AWS 的高级解决方案架构师。 凭借 AI/ML、数据科学和分析方面的背景,Yunfei 帮助客户采用 AWS 服务来交付业务成果。 他设计 AI/ML 和数据分析解决方案,以克服复杂的技术挑战并推动战略目标。 云飞拥有电子电气工程博士学位。 工作之余,云飞喜欢阅读和音乐。

埃拉德·德韦克 是亚马逊的建筑技术经理。 Elad 拥有建筑和项目管理背景,帮助团队采用新技术和基于数据的流程来交付建筑项目。 他确定需求和解决方案,并促进定制属性的开发。 Elad 拥有 MBA 学位和结构工程学士学位。 工作之余,埃拉德喜欢瑜伽、木工和与家人一起旅行。

埃拉德·德韦克 是亚马逊的建筑技术经理。 Elad 拥有建筑和项目管理背景,帮助团队采用新技术和基于数据的流程来交付建筑项目。 他确定需求和解决方案,并促进定制属性的开发。 Elad 拥有 MBA 学位和结构工程学士学位。 工作之余,埃拉德喜欢瑜伽、木工和与家人一起旅行。

卢卡·塞拉邦 是亚马逊的商业智能工程师。 Luca 凭借其在数据科学和分析方面的背景,精心设计了量身定制的技术解决方案,以满足客户的独特需求,推动他们走向更加可持续和可扩展的流程。 Luca 拥有数据科学硕士学位,喜欢在闲暇时参与 DIY 项目、园艺和尝试美食。

卢卡·塞拉邦 是亚马逊的商业智能工程师。 Luca 凭借其在数据科学和分析方面的背景,精心设计了量身定制的技术解决方案,以满足客户的独特需求,推动他们走向更加可持续和可扩展的流程。 Luca 拥有数据科学硕士学位,喜欢在闲暇时参与 DIY 项目、园艺和尝试美食。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- PlatoData.Network 垂直生成人工智能。 赋予自己力量。 访问这里。

- 柏拉图爱流。 Web3 智能。 知识放大。 访问这里。

- 柏拉图ESG。 碳, 清洁科技, 能源, 环境, 太阳能, 废物管理。 访问这里。

- 柏拉图健康。 生物技术和临床试验情报。 访问这里。

- Sumber: https://aws.amazon.com/blogs/machine-learning/improve-llm-performance-with-human-and-ai-feedback-on-amazon-sagemaker-for-amazon-engineering/