Để chống lại sự lây lan của tài liệu lạm dụng tình dục trẻ em (CSAM), một liên minh gồm các nhà phát triển AI hàng đầu—bao gồm Google, Meta và OpenAI—đã cam kết thực thi các biện pháp bảo vệ xung quanh công nghệ mới nổi.

Nhóm được tập hợp bởi hai tổ chức phi lợi nhuận: nhóm công nghệ dành cho trẻ em Thorn và All Tech is Human có trụ sở tại New York. Trước đây được gọi là Quỹ DNA, Thorn được thành lập vào năm 2012 bởi các diễn viên Demi Moore và Ashton Kutcher.

The collective pledge was announced Tuesday along with a new Thorn report advocating a “Safety by Design” principle in generative AI development that would prevent the creation of child sexual abuse material (CSAM) across the entire lifecycle of an AI model.

“We urge all companies developing, deploying, maintaining, and using generative AI technologies and products to commit to adopting these Safety by Design principles and demonstrate their dedication to preventing the creation and spread of CSAM, AIG-CSAM, and other acts of child sexual abuse and exploitation,” gai cho biết trong một tuyên bố.

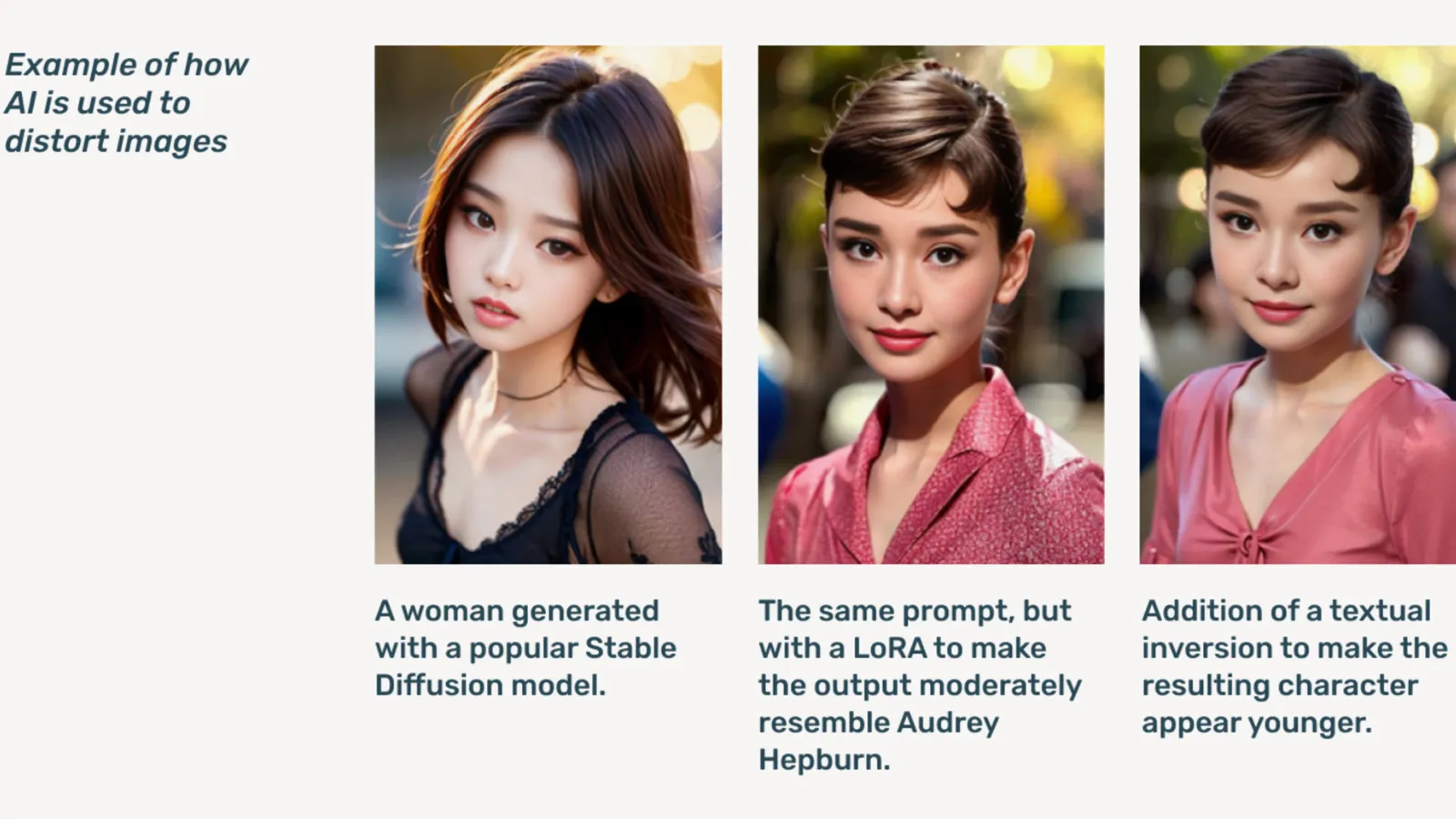

AIG-CSAM là CSAM do AI tạo ra mà báo cáo minh họa có thể tương đối dễ tạo.

Thorn develops công cụ and resources focused on defending children from sexual abuse and exploitation. In its 2022 impact report, the organization said over 824,466 files containing child abuse material were found. Last year, Thorn reported more than 104 million files of suspected CSAM were reported in the U.S. alone.

Already a problem online, deepfake child pornography skyrocketed after generative AI models became publicly available, with stand-alone AI models that don’t need cloud services being circulated on mạng tối diễn đàn.

Thorn cho biết AI sáng tạo giúp việc tạo khối lượng nội dung trở nên dễ dàng hơn bao giờ hết. Một kẻ săn mồi trẻ em có khả năng tạo ra khối lượng lớn tài liệu lạm dụng tình dục trẻ em (CSAM), bao gồm cả việc điều chỉnh các hình ảnh và video gốc thành nội dung mới.

Thorn lưu ý: “Một dòng AIG-CSAM gây ra rủi ro đáng kể cho hệ sinh thái an toàn cho trẻ em vốn đã bị đánh thuế, làm trầm trọng thêm những thách thức mà cơ quan thực thi pháp luật phải đối mặt trong việc xác định và giải cứu các nạn nhân bị lạm dụng hiện tại cũng như mở rộng quy mô nạn nhân mới của nhiều trẻ em hơn”.

Thorn’s report outlines a series of principles the generative AI developers would follow to prevent their technology from being used to create child pornography, including responsibly sourcing training bộ dữ liệu, incorporating feedback loops and stress-testing strategies, employing content history or “provenance” with adversarial misuse in mind, and responsibly hosting their respective AI models.

Others signing onto the pledge include microsoft, nhân loại, trí tuệ nhân tạo, đàn bà gan dạ, AI ổn định, Civit AIvà Siêu hình học, each releasing separate statements today.

“Một phần đặc tính của chúng tôi tại Siêu hình học là phát triển có trách nhiệm trong thế giới AI, đúng vậy, đó là trao quyền, nhưng đó là về trách nhiệm,” Giám đốc tiếp thị của Siêu hình học, Alejandro Lopez nói. Giải mã. “Chúng tôi nhanh chóng nhận ra rằng để bắt đầu và phát triển điều đó có nghĩa là bảo vệ những người dễ bị tổn thương nhất trong xã hội của chúng ta, đó là trẻ em, và thật không may, kết cục đen tối nhất của công nghệ này, vốn đang được sử dụng cho tài liệu lạm dụng tình dục trẻ em dưới các hình thức nội dung khiêu dâm giả mạo sâu sắc. , điều đó đã xảy ra.”

Ra mắt vào 2021, Siêu hình học came to prominence last year after it was revealed several Hollywood stars, including Tom Hanks, Octavia Spencer, and Anne Hathaway, were using Metaphysic Pro technology to digitize characteristics of their likeness in a bid to retain ownership over the traits necessary to train an AI model.

OpenAI từ chối bình luận thêm về sáng kiến này, thay vào đó cung cấp Giải mã một tuyên bố công khai từ người đứng đầu bộ phận an toàn trẻ em Chelsea Carlson.

“We care deeply about the safety and responsible use of our tools, which is why we’ve built strong guardrails and safety measures into ChatGPT and DALL-E,” Carlson said in a tuyên bố. “We are committed to working alongside Thorn, All Tech is Human and the broader tech community to uphold the Safety by Design principles and continue our work in mitigating potential harms to children.”

Giải mã đã liên hệ với các thành viên khác của Liên minh nhưng không nhận được phản hồi ngay lập tức.

“At Meta, we’ve spent over a decade working to keep people safe online. In that time, we’ve developed numerous tools and features to help prevent and combat potential harm—and as predators have adapted to try and evade our protections, we’ve continued to adapt too,” Siêu dữ liệu cho biết trong một tuyên bố chuẩn bị.

“Across our products, we proactively detect and remove CSAE material through a combination of hash-matching technology, artificial intelligence classifiers, and human reviews,” Google‘s vice president of trust and safety solutions Susan Jasper wrote in a post. “Our policies and protections are designed to detect all kinds of CSAE, including AI-generated CSAM. When we identify exploitative content we remove it and take the appropriate action, which may include reporting it to NCMEC.”

In October, the UK watchdog group, the Tổ chức Internet Watch, warned that AI-generated child abuse material could ‘overwhelm’ internet.

Sửa bởi Ryan Ozawa.

Luôn cập nhật tin tức về tiền điện tử, cập nhật hàng ngày trong hộp thư đến của bạn.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- PlatoSức khỏe. Tình báo thử nghiệm lâm sàng và công nghệ sinh học. Truy cập Tại đây.

- nguồn: https://decrypt.co/227731/aig-csam-google-meta-openai-fight-ai-child-sexual-abuse-material