Meta, Şubat ayında ikinci nesil yapay zeka hızlandırıcısının tanıtımını yaptıktan sonra, halihazırda 16 bölgede reklam önerilerini güçlendirdiği söylenen bu yerli silikonun çekirdeklerini dökmeye hazır.

Facebook goliath, reklam imparatorluğunun arkasındaki tavsiye modellerini yönlendirmek amacıyla video akışından makine öğrenimine kadar her türlü iş yükü için özel hızlandırıcılar tasarlıyor.

The son ekleme Meta Training Inference Accelerator (MTIA) ailesi, The Next Platform'daki arkadaşlarımızın sunduğu birinci nesil parçaya göre 3 kat daha yüksek performans ve 1.5 kat güç verimliliği avantajı iddia ediyor analiz geçen yıl.

Meta'ya göre tutarlılık açısından MTIA v2 adını vereceğimiz ikinci nesil çip, hiper ölçekleyicinin dahili sıralaması ve öneri modelleri için mümkün olan en iyi performansı elde etmek amacıyla bilgi işlem, bellek kapasitesi ve bant genişliğini dengelemek üzere tasarlandı. .

Tasarımın derinliklerine inildiğinde, hızlandırıcı, MTIA v8'e kıyasla 8 kat daha yüksek yoğun bilgi işlem performansı veya seyreklik etkinken 3.5 kat daha yüksek performans sunan 7×1 işleme öğeleri (PE'ler) ızgarasına sahiptir.

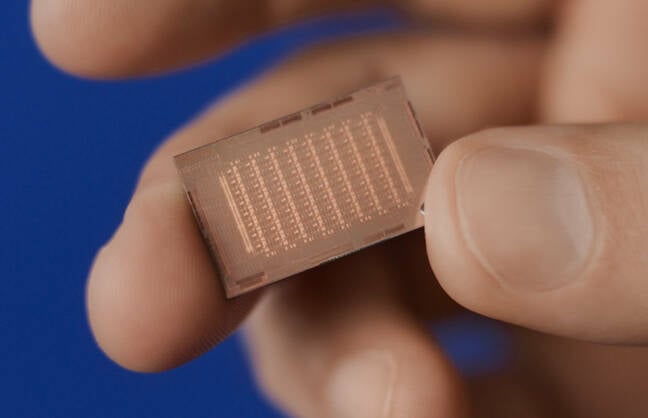

Yukarıdaki Meta'nın en son yapay zeka hızlandırıcısı, hiper ölçekleyicinin sıralama ve öneri modellerine zaten güç veriyor - Büyütmek için tıklayın. Kaynak: Meta

Meta, daha küçük bir 5nm TSMC işlem düğümü kullanmanın ve saat hızını 800MHz'den 1.35GHz'e çıkarmanın ötesinde, en son parçanın performans kazanımlarına katkıda bulunan çeşitli mimari ve tasarım iyileştirmelerine dikkat çekiyor. Bunlar arasında seyrek hesaplama desteği, daha fazla kalıp içi ve kalıp dışı bellek ve eski modelin iki katı bant genişliğine sahip yükseltilmiş çip üzerinde ağ (NoC) yer alıyor. Birinci ve ikinci neslin karşılaştırması şu şekilde:

| MTIA v1 | MTIA v2 | |

|---|---|---|

| Proses teknolojisi | 7 nm TSMC | 5 nm TSMC |

| Kalıp alanı | 373mm2 | 421mm2 |

| PE'ler | 8×8 ızgara | 8×8 ızgara |

| Saat hızı | 800MHz | 1.35GHz |

| INT8 performansı | 102 TOPS | 354/708* ÜSTLER |

| FP16/BF16 performansı | 51.2 TFLOPS | 177/354* TFLOPS |

| PE belleği | PE başına 128 KB | PE başına 384 KB |

| Çip üzerindeki bellek | 128MB | 256MB |

| Çip dışı bellek | 64GB | 128GB |

| Çip dışı bellek BW | 176GB / sn | 204GB / sn |

| Bağlantı | 8x PCIe Gen 4.0 – 16 GB/sn | 8x PCIe Gen 5.0 – 32 GB/sn |

| TDP | 25W | 90W |

* Seyrek performans. Her iki çipin de tam dökümünü bulabilirsiniz okuyun.

MTIA v2'nin web devlerinin GPU ihtiyacını ortadan kaldırmayacağı unutulmamalıdır. Meta supremo Mark Zuckerberg daha önce mega şirketinin dağıtacak 350,000 Nvidia H100 hızlandırıcı ve yıl sonuna kadar 600,000 H100'e eşdeğer hizmete sahip olacak.

Bunun yerine, MTIA, Meta (ve diğerleri) için belirli görevlere göre uyarlanmış özel silikon geliştirme konusunda giderek daha tanıdık bir model izliyor. Buradaki fikir, kitin CPU'lar ve GPU'lar kadar esnek olmasa da, ASIC'in geniş ölçekte dağıtıldığında daha verimli olabileceğidir.

En yeni çip önceki modele göre neredeyse dört kat daha fazla enerji tüketirken, kayan nokta performansının 7 katına kadar üretim kapasitesine sahip. Bir GPU ile karşılaştırıldığında Meta'nın en son hızlandırıcısı watt başına 7.8 TOPS (TOPS/W) yönetiyor; tartışılan Blackwell kapsamımızda, Nvidia'nın H100 SXM'sini 5.65 TOPS/W ile geride bırakıyor ve 100 TOPS/W ile A3.12 SXM'nin iki katından fazla.

Bununla birlikte, Meta'nın çipi dahili iş yüklerine göre boyutlandırmak için büyük çaba harcadığı, yani tavsiye modellerinden çıkarım yaptığı açıktır. Bunlar, tanıyabileceğiniz kişiler veya daha da önemlisi Meta'nın iş modeli için hangi reklamların sizinle en alakalı olduğu gibi kişiselleştirilmiş öneriler sunmak üzere tasarlanmıştır.

Çipler ayrıca gerektiğinde ölçeklendirilecek şekilde tasarlanmıştır ve toplamda 72 hızlandırıcı içeren raf tabanlı bir sisteme yerleştirilebilir: Her sistem, her biri 12 hesaplama kartı içeren üç kasayı kart başına iki MTIA v2 yongasıyla birleştirir.

Her MTIA v2 kasası, her biri bir çift hızlandırıcıya sahip 12 hesaplama kartı içerir… Büyütmek için tıklayın. Kaynak: Meta.

İş yüklerini dağıtma açısından Meta, ağırlıklı olarak PyTorch çerçevesine ve Triton derleyicisine güveniyor. Bu kombinasyonun çeşitli GPU'larda ve hızlandırıcılarda görevleri gerçekleştirmek için kullanıldığını gördük, bunun nedeni kısmen belirli donanımlar için optimize edilmiş kod geliştirme ihtiyacını büyük ölçüde ortadan kaldırmasıdır.

Meta, büyük bir yanlısı Mühendislere Nvidia ve AMD'nin çeşitli GPU donanımlarında çalışabilen yapay zeka uygulamaları geliştirme esnekliği sağladığından, dizginleri Linux Foundation'a devretmeden önce geliştirdiği PyTorch'un bir parçası. Dolayısıyla Meta'nın aynı teknolojileri kendi çipleriyle kullanmak istemesi mantıklı.

Aslında Meta, yazılım ve donanımını birlikte geliştirerek mevcut GPU platformlarına kıyasla daha yüksek verimlilik elde edebildiğini iddia ediyor ve gelecekteki optimizasyonlarla daha da fazla performans elde etmeyi umuyor.

MTIA v2 kesinlikle Meta'da gördüğümüz son silikon olmayacak. Sosyal medya devi, gelecekteki üretken yapay zeka sistemlerini destekleyecek bir program da dahil olmak üzere çeşitli çip tasarım programlarının devam ettiğini söylüyor. ®

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoData.Network Dikey Üretken Yapay Zeka. Kendine güç ver. Buradan Erişin.

- PlatoAiStream. Web3 Zekası. Bilgi Genişletildi. Buradan Erişin.

- PlatoESG. karbon, temiz teknoloji, Enerji, Çevre, Güneş, Atık Yönetimi. Buradan Erişin.

- PlatoSağlık. Biyoteknoloji ve Klinik Araştırmalar Zekası. Buradan Erişin.

- Kaynak: https://go.theregister.com/feed/www.theregister.com/2024/04/10/meta_mtia_chip/