Команда Amazon EU Design and Construction (Amazon D&C) — это команда инженеров, проектирующая и строящая склады Amazon. Команда просматривает большой объем документов и находит нужную информацию, чтобы убедиться, что проект склада соответствует самым высоким стандартам. В посте Генеративное решение на базе искусственного интеллекта на базе Amazon SageMaker, которое поможет Amazon в проектировании и строительстве в ЕС., мы представили решение для бота, отвечающего на вопросы, используя Извлечение дополненной генерации (RAG) конвейер с тонко настроенным большая языковая модель (LLM) для Amazon D&C, чтобы эффективно извлекать точную информацию из большого объема неорганизованных документов и предоставлять своевременные и качественные услуги в своих строительных проектах. Команда Amazon D&C реализовала это решение в пилотном режиме для инженеров Amazon и собрала отзывы пользователей.

В этом посте мы рассказываем, как мы проанализировали данные обратной связи и выявили ограничения точности и галлюцинации, предоставленные RAG, а также использовали оценку человеческой оценки для обучения модели посредством усиление обучения. Чтобы увеличить количество обучающих выборок и улучшить качество обучения, мы также использовали еще один LLM для получения оценок обратной связи. Этот метод устранил ограничение RAG и еще больше улучшил качество ответов бота. Мы представляем процесс обучения с подкреплением и результаты сравнительного анализа, чтобы продемонстрировать улучшение производительности LLM. В решении используется Amazon SageMaker JumpStart в качестве основного сервиса для развертывания моделей, точной настройки и обучения с подкреплением.

Соберите отзывы инженеров Amazon в пилотном проекте.

После разработки решения, описанного в Генеративное решение на базе искусственного интеллекта на базе Amazon SageMaker, которое поможет Amazon в проектировании и строительстве в ЕС., команда Amazon D&C развернула решение и запустила пилотный проект с инженерами Amazon. Инженеры получили доступ к пилотной системе через веб-приложение, разработанное стримлит, связанный с трубопроводом РАГ. В конвейере мы использовали Сервис Amazon OpenSearch для векторной базы данных и развернул точно настроенную модель Mistral-7B-Instruct на Amazon SageMaker.

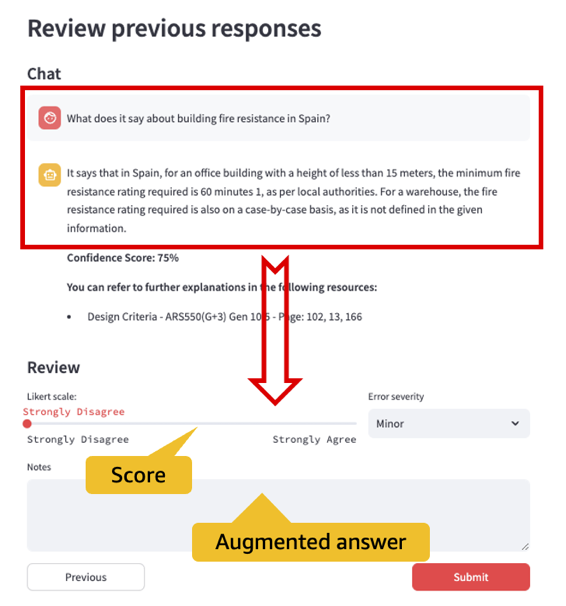

Одна из ключевых задач пилотного проекта — собрать отзывы инженеров Amazon и использовать их для дальнейшего уменьшения галлюцинаций LLM. Для этого мы разработали модуль сбора отзывов в пользовательском интерфейсе, как показано на следующем рисунке, и сохранили информацию о веб-сессии и отзывы пользователей в Amazon DynamoDB. С помощью пользовательского интерфейса сбора отзывов инженеры Amazon могут выбирать один из пяти уровней удовлетворенности: категорически не согласен, не согласен, нейтрально, согласен и полностью согласен, что соответствует оценкам отзывов от 1 до 5. Они также могут дать лучший ответ на вопрос или прокомментировать, почему ответ LLM не является удовлетворительным.

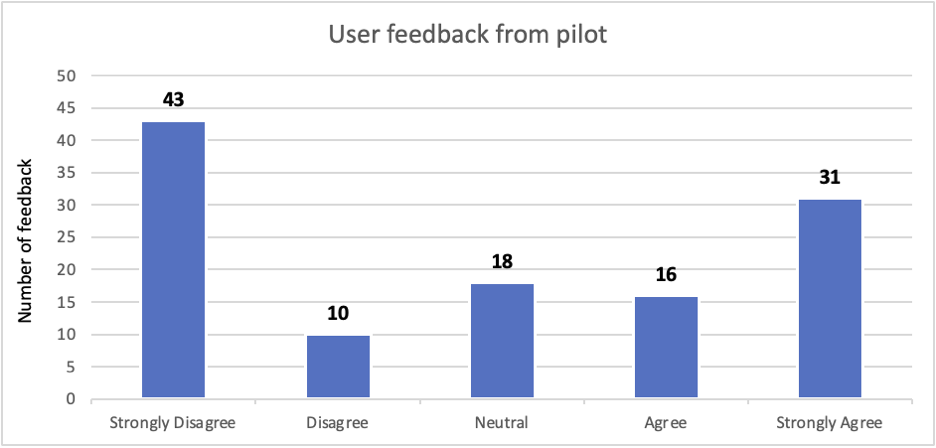

В ходе пилотного проекта пользователи предоставили 118 ответов. На следующей диаграмме показано распределение от отрицательного к положительному. Мы заметили, что неправильные ответы, отмеченные отрицательным отзывом (не согласен и категорически не согласен), составляют 45% от общего числа отзывов (53 из 118). Некоторые ошибки (около 10 % отрицательных отзывов и 7.5 % от общего числа ответов) можно устранить путем обучения пользователей и оперативного проектирования. Кроме того, мы можем решить эту проблему с помощью решения тонкой настройки LLM и обучения с подкреплением, описанного в следующем разделе.

Некоторые пользователи просто оставляли заметки, например «Отлично!» для полностью согласных ответов или «Не отвечает на вопрос» для категорически несогласных ответов. Другие пользователи предоставили оценки и объяснили, как они обосновывают ответы LLM в своих заметках. В следующем примере пользователь специально предоставил соответствующий документ и контент для исправления галлюцинации LLM.

| Question | Сколько у нас парковочных мест? |

| Бот Ответ |

Исходя из данного контекста, у нас недостаточно информации для определения количества парковочных мест. В контексте обсуждаются минимальные размеры парковочных мест и требования к уровню внешнего освещения, но не указывается конкретное количество парковочных мест. **Дополнительные пояснения можно найти в следующих ресурсах:** * АРС ОБЩ 10.0/05.01.02. Критерии проектирования и приложения/Пакет производительности AR Sortable Design Criteria v20.1.1.pdf – страница: 10 * АРС ОБЩ 10.0/05.01.02. Критерии проектирования и приложения/Пакет производительности AR Sortable Design Criteria v20.1.1.pdf – страница: 79 |

| Оценка пользователя | Полностью не согласен |

| Примечания пользователя | Это указано на стр. 21 раздела критериев проектирования 01 13 10. |

Улучшите реакцию ботов с помощью контролируемой тонкой настройки и обучения с подкреплением.

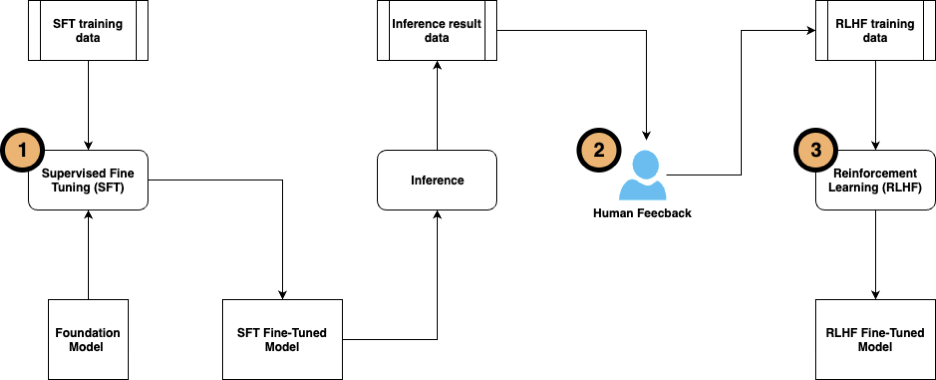

Решение состоит из трех этапов тонкой настройки:

- Проведите контролируемую точную настройку с использованием помеченных данных. Этот метод был описан в Генеративное решение на базе искусственного интеллекта на базе Amazon SageMaker, которое поможет Amazon в проектировании и строительстве в ЕС..

- Соберите отзывы пользователей, чтобы пометить пары «вопрос-ответ» для дальнейшей настройки LLM.

- Когда обучающие данные будут готовы, настройте модель, используя обучение с подкреплением на основе отзывов людей (РЛХФ).

RLHF широко используется в приложениях генеративного искусственного интеллекта (ИИ) и LLM. Он включает обратную связь с человеком в функцию вознаграждения и обучает модель с помощью алгоритма обучения с подкреплением для максимизации вознаграждения, что позволяет модели выполнять задачи, более соответствующие человеческим целям. На следующей диаграмме показан конвейер шагов.

Мы протестировали методологию с использованием документов Amazon D&C на модели Mistral-7B в SageMaker JumpStart.

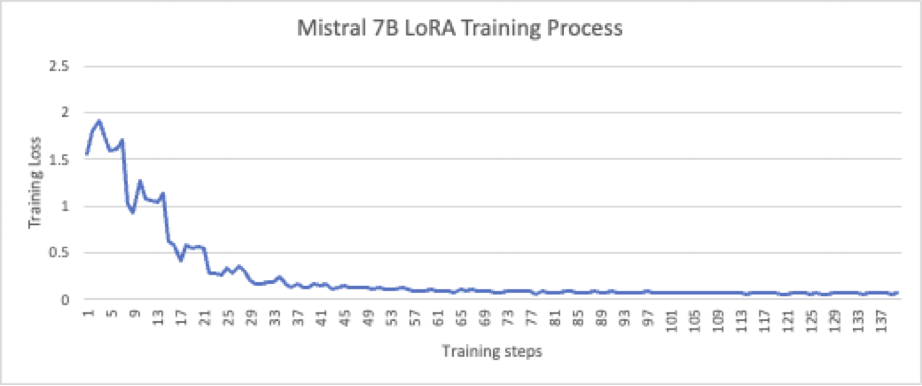

Контролируемая тонкая настройка

В предыдущем посте мы продемонстрировали, как доработанная модель Falcon-7B превосходит конвейер RAG и повышает качество и точность ответов ботов QA. Для этого поста мы провели контролируемую доводку модели Мистраль-7Б. При контролируемой тонкой настройке использовался метод PEFT/LoRA (LoRA_r = 512, LoRA_alpha = 1024) для 436,207,616 5.68 7,677,964,288 параметров (3.8% от общего числа 137 20 XNUMX XNUMX параметров). Обучение проводилось на узле pXNUMXx с использованием XNUMX образцов, синтетически сгенерированных LLM и проверенных людьми; процесс хорошо сходится после XNUMX эпох, как показано на следующем рисунке.

Точная настройка модели была проверена на 274 образцах, а результаты вывода сравнивались с эталонными ответами по показателю семантического сходства. Показатель составляет 0.8100, что выше показателя 0.6419 традиционного RAG.

Собирайте отзывы людей и искусственного интеллекта для обучения с подкреплением

Для RLHF необходимо наличие достаточного количества высококачественных обучающих выборок, отмеченных экспертами в данной области (SME). Однако некачественные человеческие метки, вероятно, приведут к ухудшению производительности модели по сравнению с исходной моделью после обучения RLHF. Время МСП дефицитный ресурс в любой организации; рассмотрение сотен или тысяч ответов LLM и предоставление обратной связи требует значительных затрат времени со стороны МСП, которые могут не иметь четкой окупаемости инвестиций.

Для решения этой проблемы мы приняли обучение с подкреплением на основе отзывов ИИ (РЛАИФ) метод. RLAIF нанимает помощника искусственного интеллекта (еще один LLM) для получения оценок, а не людей. В этом гибридном подходе к обучению обучающийся агент уточняет действия не только на основе взаимодействия с человеком, но и на основе обратной связи, предоставляемой другой моделью ИИ. Это гораздо более масштабируемо, чтобы предоставить достаточные обучающие данные для обучения с подкреплением, и гораздо менее субъективно, поскольку обучение не зависит от конкретных предпочтений небольшой группы МСП. МСП по-прежнему могут участвовать, но только для контроля над процессом и проверки качества обратной связи с ИИ. Это значительно снижает рабочую нагрузку на МСП, поскольку малым и средним предприятиям гораздо проще анализировать, фильтровать и сортировать баллы и метки, генерируемые ИИ.

В этом случае использования мы предоставляем следующую подсказку модели Anthropic Claude 2 для создания оценок оценки в качестве обучающих выборок для этапа обучения с подкреплением:

Модель Claude 2 генерирует оценку оценки и комментарий о том, почему выставляется оценка, как показано в следующем примере.

| Question | Что подразумевается под «отделочными работами» в этом контексте? |

| Справочный ответ | Под отделочными работами понимаются Работы, выполняемые в соответствии с контрактом на строительство компанией Amazon или от ее имени через Застройщика до Даты первого получения с условной позиции разработчика Shell & Core Base-build. Эти работы включают в себя необходимые доработки Amazon, крупногабаритные установки и индивидуальные |

| Ответ QA-бота | Под отделочными работами понимаются Работы, выполняемые в рамках строительного контракта Amazon или от его имени через Застройщика до Даты первого получения с условной позиции Developer Shell & Core Base-build. |

| Оценка ИИ | 4.5 |

| комментарий ИИ | Машинный ответ предоставляет ключевую информацию из стандартного ответа: «Подготовочные работы» относятся к работам, выполняемым в рамках контракта на строительство компанией Amazon или от ее имени через Застройщика до даты первого получения из условной позиции разработчика Shell & Core Base-build. . Дополнительные сведения о включении необходимых доработок Amazon, крупных установках и настройках актуальны и помогают обеспечить дополнительный контекст, поэтому я поставил машинному ответу 4.5 балла из 5. Он отражает суть стандартного ответа и дает некоторые полезные дополнительные детали. |

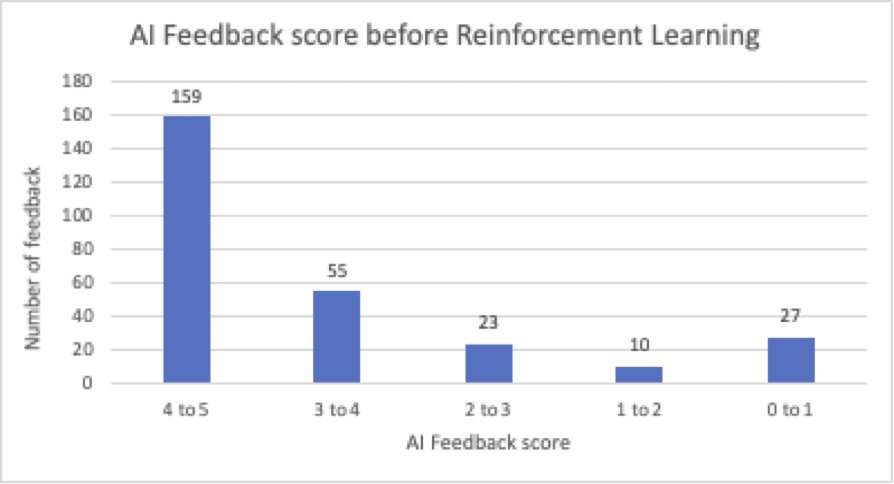

Из 274 проверочных вопросов контролируемая точно настроенная модель сгенерировала 159 ответов с оценкой ИИ выше 4. Мы наблюдали 60 ответов с оценкой ниже 3; есть возможности для улучшения общего качества ответов.

Представители малого и среднего бизнеса Amazon Engineering подтвердили эту информацию об искусственном интеллекте и признали преимущества использования оценок искусственного интеллекта. Без обратной связи с ИИ предприятиям малого и среднего бизнеса потребуется некоторое время для рассмотрения и анализа каждого ответа LLM, чтобы выявить недопустимые ответы и галлюцинации, а также оценить, возвращает ли LLM правильное содержание и ключевые понятия. Обратная связь с ИИ автоматически предоставляет оценки ИИ и позволяет МСП использовать фильтрацию, сортировку и группировку для проверки оценок и выявления тенденций в ответах. Это сокращает среднее время проверки МСП на 80%.

Обучение с подкреплением на основе отзывов людей и искусственного интеллекта

Когда обучающие выборки готовы, мы используем метод алгоритм оптимизации проксимальной политики (PPO) выполнять обучение с подкреплением. PPO использует метод градиента политики, который предпринимает небольшие шаги для обновления политики в процессе обучения, чтобы обучающиеся агенты могли надежно достичь оптимальной сети политики. Это делает процесс обучения более стабильным и снижает вероятность расхождений.

Во время обучения сначала мы используем данные, помеченные людьми и искусственным интеллектом, для построения модели вознаграждения, которая будет использоваться для обновления весов в процессе обучения. Для этого варианта использования мы выбираем модель вознаграждения на основе дистиллятора и обучаем ее с помощью образцов в следующем формате:

[Instruction, Chosen_response, Rejected_response]

Ниже приведен пример записи обучения.

| инструкция | В зависимости от контекста, что подразумевается под инклюзивным и доступным дизайном? |

| Выбранный_ответ | Кредит BREEAM HEA06 – инклюзивный и доступный дизайн – здание спроектировано так, чтобы соответствовать своему назначению, быть подходящим и доступным для всех потенциальных пользователей. Стратегия доступа разрабатывается в соответствии с контрольным списком BREEAM A3. |

| Отклоненный_ответ | В контексте указано, что |

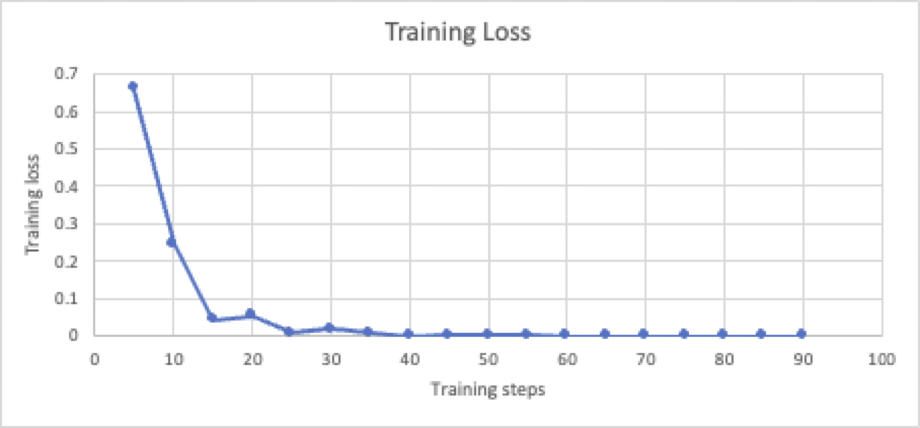

Модель вознаграждения обучается со скоростью обучения 1e-5. Как показано на следующей диаграмме, обучение хорошо сходится после 10 эпох.

Затем модель вознаграждения используется для обучения с подкреплением. В этом случае мы используем PEFT/LoRA для ускорения обучения. LoRA_r равен 32, а LoRA_alpha равен 64. Обучение на основе PPO осуществляется со скоростью 1.41e-5 в течение трех эпох. Обучение с подкреплением очень нестабильно и очень чувствительно к данным меток и данным обратной связи. Для наблюдения за процессом обучения мы используем метрику вознаграждения_среднего — среднее вознаграждение, полученное из окружающей среды путем специального мониторинга модели вознаграждения.

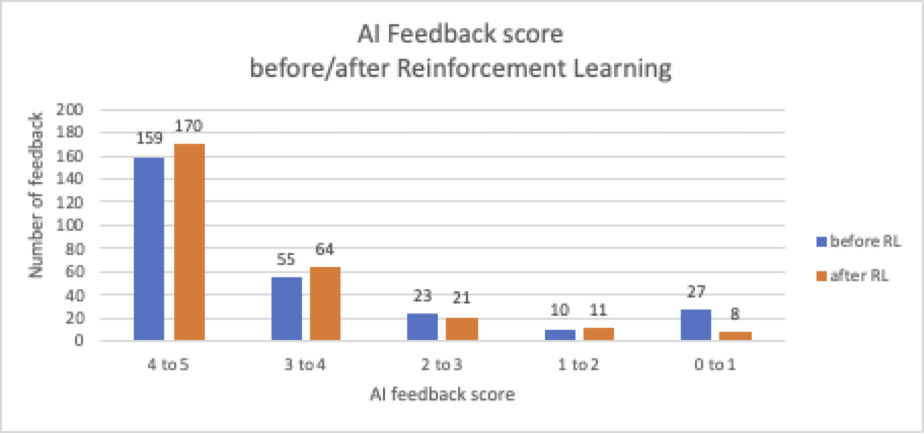

После RLAIF мы видим, что количество ответов ботов с положительными оценками (выше 3) увеличилось с 78.1% до 85.5%, а с отрицательными оценками (ниже 3) уменьшилось с 21.9% до 14.5%. В целом средний балл обратной связи ИИ увеличивается до 8%, с 3.9 до 4.2.

Вы можете увидеть улучшение в следующем примере.

| Question | Какая стяжка нужна для пола, на котором выложена плитка? |

| Справка | Бетонная стяжка применима только в помещениях, где пол покрыт плиткой. Обратитесь к чертежу серии A-32, чтобы узнать, где можно использовать напольную плитку. |

| Ответ бота перед RLAIF | Бетонная стяжка применяется только в |

| Оценка AI перед RLAIF | 3 |

| Ответ бота после RLAIF | Бетонная стяжка пола применима только в помещениях, покрытых плиткой. Обратитесь к чертежу серии A-32, чтобы узнать, где можно использовать плиточный пол. |

| Оценка AI после RLAIF | 4.5 |

Заключение

Этот пост является продолжением нашей работы с командой Amazon EU по проектированию и строительству, как обсуждалось в разделе Генеративное решение на базе искусственного интеллекта на базе Amazon SageMaker, которое поможет Amazon в проектировании и строительстве в ЕС.. В этом посте мы показали, как мы генерируем данные обратной связи от людей и искусственного интеллекта для точной настройки модели Mistral-7B с помощью обучения с подкреплением. Модель после RLAIF обеспечила более высокую производительность бота-ответа на вопросы Amazon Engineering и улучшила оценку обратной связи ИИ на 8%. В пилотном проекте команды Amazon D&C использование RLAIF снизило рабочую нагрузку по проверке для МСП примерно на 80%. В качестве следующего шага мы расширим это решение, подключившись к инфраструктуре данных Amazon Engineering, и разработаем структуру для автоматизации процесса непрерывного обучения с участием человека. Мы также улучшим качество обратной связи с ИИ, настроив шаблон подсказки.

Благодаря этому процессу мы узнали, как еще больше повысить качество и производительность задач по ответам на вопросы с помощью RLHF и RLAIF.

- Человеческая проверка и расширение необходимы для обеспечения точных и ответственных результатов LLM. Обратная связь с человеком может быть использована в RLHF для дальнейшего улучшения реакции модели.

- RLAIF автоматизирует цикл оценки и обучения. Обратная связь, генерируемая ИИ, менее субъективна, поскольку не зависит от конкретных предпочтений небольшого числа МСП.

- RLAIF более масштабируем, что позволяет улучшить качество ботов за счет постоянного обучения с подкреплением и минимизации усилий, требуемых от МСП. Это особенно полезно для разработки генеративных решений искусственного интеллекта для конкретной предметной области в крупных организациях.

- Этот процесс следует выполнять на регулярной основе, особенно когда доступны новые данные предметной области, которые можно охватить решением.

В этом случае мы использовали SageMaker JumpStart для тестирования нескольких LLM и экспериментов с несколькими подходами к обучению LLM. Это значительно ускоряет цикл обратной связи и обучения ИИ, обеспечивая максимальную эффективность и качество. В своем собственном проекте вы можете внедрить подход «человек в цикле» для сбора отзывов пользователей или генерировать отзывы ИИ с помощью другого LLM. Затем вы можете следовать трехэтапному процессу, описанному в этом посте, для точной настройки ваших моделей с использованием RLHF и RLAIF. Рекомендуем поэкспериментировать с методами с помощью SageMaker JumpStart, чтобы ускорить процесс.

Об авторе

Юнфэй Бай является старшим архитектором решений в AWS. Имея опыт работы в области искусственного интеллекта и машинного обучения, обработки данных и аналитики, Юнфэй помогает клиентам внедрять сервисы AWS для достижения бизнес-результатов. Он разрабатывает решения для искусственного интеллекта, машинного обучения и анализа данных, которые решают сложные технические задачи и достигают стратегических целей. Юнфэй имеет докторскую степень в области электроники и электротехники. Вне работы Юнфэй любит читать и слушать музыку.

Юнфэй Бай является старшим архитектором решений в AWS. Имея опыт работы в области искусственного интеллекта и машинного обучения, обработки данных и аналитики, Юнфэй помогает клиентам внедрять сервисы AWS для достижения бизнес-результатов. Он разрабатывает решения для искусственного интеллекта, машинного обучения и анализа данных, которые решают сложные технические задачи и достигают стратегических целей. Юнфэй имеет докторскую степень в области электроники и электротехники. Вне работы Юнфэй любит читать и слушать музыку.

Элад Двек — менеджер по строительным технологиям в Amazon. Имея опыт работы в сфере строительства и управления проектами, Элад помогает командам внедрять новые технологии и процессы, основанные на данных, для реализации строительных проектов. Он определяет потребности и решения, а также способствует разработке индивидуальных атрибутов. Элад имеет степень магистра делового администрирования и степень бакалавра в области строительного проектирования. Помимо работы Элад увлекается йогой, работой по дереву и путешествиями со своей семьей.

Элад Двек — менеджер по строительным технологиям в Amazon. Имея опыт работы в сфере строительства и управления проектами, Элад помогает командам внедрять новые технологии и процессы, основанные на данных, для реализации строительных проектов. Он определяет потребности и решения, а также способствует разработке индивидуальных атрибутов. Элад имеет степень магистра делового администрирования и степень бакалавра в области строительного проектирования. Помимо работы Элад увлекается йогой, работой по дереву и путешествиями со своей семьей.

Лука Серабоне — инженер бизнес-аналитики в Amazon. Опираясь на свой опыт в области науки о данных и аналитики, Лука разрабатывает индивидуальные технические решения для удовлетворения уникальных потребностей своих клиентов, побуждая их к более устойчивым и масштабируемым процессам. Имея степень магистра в области науки о данных, Лука в свободное время любит заниматься DIY-проектами, заниматься садоводством и экспериментировать с кулинарными изысками.

Лука Серабоне — инженер бизнес-аналитики в Amazon. Опираясь на свой опыт в области науки о данных и аналитики, Лука разрабатывает индивидуальные технические решения для удовлетворения уникальных потребностей своих клиентов, побуждая их к более устойчивым и масштабируемым процессам. Имея степень магистра в области науки о данных, Лука в свободное время любит заниматься DIY-проектами, заниматься садоводством и экспериментировать с кулинарными изысками.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/improve-llm-performance-with-human-and-ai-feedback-on-amazon-sagemaker-for-amazon-engineering/