Treści partnerów Huawei Cloud był gospodarzem szeregu wydarzeń podczas MWC24 w Barcelonie, których celem było „Przyspieszenie inteligencji za pomocą wszystkiego jako usługi”, w tym szczytu Huawei Cloud Summit, prezentacji produktów i rozwiązań oraz seminarium Cloud Native Elite Club (CNEC).

Wydarzenia te miały na celu zaprezentowanie infrastruktury Huawei jako podłoża innowacji w zakresie sztucznej inteligencji (AI), a kadra kierownicza i eksperci z różnych branż zastanawiali się nad holistycznym wpływem, a także rewolucyjnymi możliwościami łączenia sztucznej inteligencji z bazami danych, dużymi zbiorami danych i usługami medialnymi i architekturę obliczeniową.

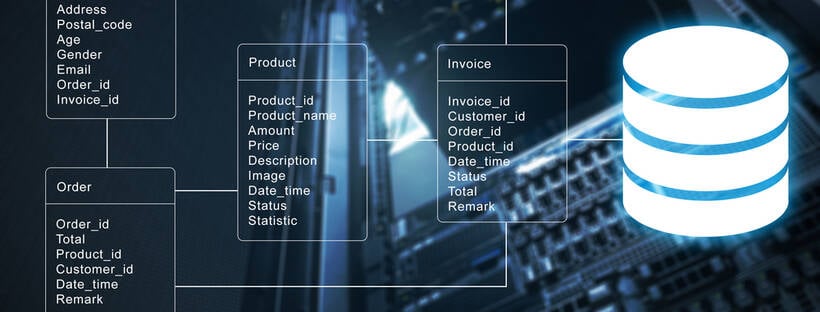

Huawei Cloud prezentował GaussDB na wszystkich trzech wydarzeniach. Podczas Cloud Summit Bruno Zhang, CTO Huawei Cloud, przedstawił rozproszoną relacyjną bazę danych GaussDB, która jest powszechnie stosowana w sektorach finansowym, telekomunikacyjnym i rządowym. „Silna baza danych to solidny fundament danych, który wspiera inteligentne aktualizacje cyfrowe” – podkreślił pan Zhang.

Dzięki zastosowaniu możliwości sztucznej inteligencji do migracji, wdrażania i konserwacji baz danych GaussDB zwiększa efektywność przetwarzania danych w aplikacjach AI, powiedział Huawei.

Najnowsza iteracja bazy danych, wprowadzona w 2023 roku, zapewnia całodobową dostępność usług, stałą wysoką wydajność przy dużych obciążeniach i stabilność w scenariuszach dużej współbieżności. Łączy także certyfikację CC EAL4+ z bezpiecznym kodem źródłowym i kompleksowymi środkami szyfrowania.

Dr Nikos Ntarmos, dyrektor laboratorium baz danych w Huawei Central Software Institute, podkreślił, że GaussDB, stworzony w oparciu o ponad 20-letnie doświadczenie Huawei w zakresie baz danych, ma na celu spełnienie wysokich wymagań klientów w zakresie inteligencji i automatyzacji baz danych.

Dr Ntarmos dodał, że wysiłki te obejmują zwiększenie możliwości „samodzielnego sterowania” na kluczowych etapach potoku danych, które obejmują doradztwo w zakresie baz danych, rozwój oraz obsługę i konserwację (O&M). Na etapie konsultacji GaussDB może automatycznie generować projekty wysokiego poziomu (HLD), łącząc duże i małe modele, na przykład w celu poprawy wydajności projektowania rozwiązań. Ocenił, że korzyść ta może skrócić okres projektowania rozwiązania z około dwóch tygodni do około dwóch dni.

W fazie rozwojowej GaussDB bezpośrednio generuje instrukcje SQL za pomocą funkcji zamiany języka naturalnego na SQL i SQL na SQL, z automatyczną identyfikacją i sugestiami ulepszeń w przypadku słabych instrukcji SQL. W fazie obsługi i konserwacji GaussDB automatyzuje inspekcję, generowanie raportów i wyznaczanie demarkacji błędów, zapewniając jednocześnie sugestie dotyczące postępowania w przypadku wadliwych instrukcji SQL.

Dr Ntarmos wyjaśnił, że zgodność bazy danych ze składnią powszechnie stosowaną w popularnych komercyjnych bazach danych sprawia, że jest to rozwiązanie migracyjne, które minimalizuje ręczne interwencje i koszty migracji. GaussDB został zastosowany w podstawowych systemach największych banków, banków akcyjnych i towarzystw ubezpieczeniowych w Chinach, a także głównych klientów Huawei Cloud w Brazylii i Tajlandii.

Huawei Cloud koncentruje się na sztucznej inteligencji jako kluczowej strategii

Jacqueline Shi, prezes działu globalnego marketingu i sprzedaży Huawei Cloud, pochwaliła przekonujący potencjał sztucznej inteligencji do zmiany niemal wszystkiego. „W Huawei Cloud sztuczna inteligencja jest kluczową strategią” – stwierdziła Shi. „U nas możesz uzyskać kompleksowe rozwiązania AI, takie jak rozwiązanie w zakresie mocy obliczeniowej AI i modele Pangu. Huawei Cloud to jeden z najszybciej rozwijających się dostawców rozwiązań chmurowych. Mamy nadzieję zapewnić naszym klientom najnowocześniejsze technologie, najlepszą obsługę lokalną oraz większy wybór lepszych wyborów.

„Jesteśmy świadkami nowego poziomu inteligencji, napędzanego przez podstawowe modele i generatywną sztuczną inteligencję” – powtórzył pan Zhang. „Przewiduje się, że do 2026 r. ponad 80 procent firm będzie wykorzystywać w produkcji treści generowane przez sztuczną inteligencję (AIGC), zmieniając 70 procent prac projektowych i rozwojowych. Do 2028 r. 75 procent inżynierów oprogramowania będzie miało u boku asystentów AI, w porównaniu z zaledwie 10 procent na początku 2023 r.”.

„Klienci oczekują heterogenicznej architektury obliczeniowej opartej na współpracy, obliczeń natywnych w chmurze o doskonałej wydajności, masowego przechowywania danych, zgodności z bezpieczeństwem, oszczędnego zarządzania i elastycznego wdrażania” – dodał William Fang, dyrektor ds. produktu w Huawei Cloud. „Tylko dzięki integracji sztucznej inteligencji z chmurą postęp w inteligencji jest możliwy”.

Aby pomóc klientom przyspieszyć podróż związaną ze sztuczną inteligencją, pan Fang podkreślił duże modele językowe, duże zbiory danych i moc obliczeniową jako kluczowe czynniki sukcesu w rozwoju infrastruktury Huawei Cloud.

Co więcej, nawet w miarę redefiniowania paradygmatów produkcji, usług i modeli biznesowych tradycyjnych zastosowań, przyspieszanie inteligencji przy jednoczesnym dostosowaniu ogromnego potencjału sztucznej inteligencji i jej wdrażaniu do celów biznesowych wymaga systematycznych innowacji.

W tym celu pan Zhang zaproponował dwutorową strategię. „AI for Cloud wykorzystuje sztuczną inteligencję i modele podstawowe, aby podnieść poziom Twoich doświadczeń” – powiedział. „Przekształcają aplikacje branżowe i nasze własne usługi w chmurze, w tym tworzenie oprogramowania, produkcję treści cyfrowych i nie tylko. Chmura dla sztucznej inteligencji sprawia, że wdrażanie sztucznej inteligencji jest płynne i wydajne. Innowacje architektoniczne, pamięć masowa natywna dla sztucznej inteligencji i konwergencja danych z sztuczną inteligencją umożliwiają trenowanie i korzystanie ze sztucznej inteligencji jak nigdy dotąd.

Systematyczne innowacje i praktyki branżowe Huawei Cloud obejmują między innymi rozwój techniczny architektury systemów, obliczeń, przechowywania, baz danych, dużych zbiorów danych, a także modele Pangu dla motoryzacji, pogody, wirtualnego człowieka, badań i rozwoju i nie tylko.

Systematyczne dostosowanie AI do biznesu

Wyjaśniając istotę chmury na rzecz sztucznej inteligencji, Zhang powiedział: „Modele podstawowe i ich aplikacje to najbardziej złożone jak dotąd systemy oprogramowania i sprzętu. Odkryliśmy na przykład nowe wyzwania w dziedzinie obliczeń. Dlatego przejdziemy od architektury skoncentrowanej na procesorze do heterogenicznej architektury chmurowej typu peer-to-peer, w której różne zasoby obliczeniowe działają na równi”.

Zhang dodał, że usługi w chmurze są kluczem do osiągnięcia hiperskalowej, stabilnej i niezawodnej mocy obliczeniowej AI wymaganej przez podstawowe modele. Takie obliczenia znacznie przewyższają prawo Moore'a. Huawei Cloud pomaga firmom telekomunikacyjnym w budowaniu inteligentnej infrastruktury chmurowej dzięki rozproszonej architekturze QingTian, pamięci masowej opartej na sztucznej inteligencji, kompleksowym zabezpieczeniom i konwergencji danych z sztuczną inteligencją.

Architektura QingTian usuwa wąskie gardła ograniczające postęp wielkoskalowych klastrów obliczeniowych AI, umożliwiając przetwarzanie w pełnej siatce typu peer-to-peer. Szybka magistrala wzajemnych połączeń bezproblemowo integruje komunikację, zarządzanie zasobami i wywoływanie funkcji w optymalną infrastrukturę obliczeniową.

„Wdrożyliśmy trzy główne centra obliczeniowe AI i ponad 30 ośrodków podrzędnych w Chinach kontynentalnych” – powiedział pan Zhang. „Obsługują klastry hiperskalowe, aby wspierać modele o bilionach parametrów. Wkrótce nasza usługa w chmurze AI zostanie uruchomiona w regionie Hongkongu, aby służyć klientom na całym świecie”.

Ponadto pamięć masowa natywna dla sztucznej inteligencji obsługuje modele szkoleniowe wymagające dużej ilości danych. Podejście oparte na trzech aspektach obejmuje usługę pamięci Expanded MemorySpecification (EMS), która przechowuje petabajty parametrów przy bardzo dużej przepustowości 220 TB i bardzo małych opóźnieniach sięgających mikrosekundy. Uzupełnieniem tego jest Scalable File Service Turbo – usługa pamięci podręcznej zapewniająca wysoką przepustowość i współbieżność dziesiątek milionów operacji wejścia/wyjścia na sekundę – oraz jezioro wiedzy usługi Object Storage Service, które w opłacalny sposób przechowuje dane szkoleniowe i wnioskowane.

Kompleksowe zabezpieczenia Huawei Cloud chronią środowiska uruchomieniowe modeli klientów z branży, dane szkoleniowe, same modele, wygenerowaną treść i aplikacje.

Modele podstawowe rozwijają się w oparciu o dane, bazę danych

Rozpowszechnianie się modeli podstawowych spowodowało także konieczność dostarczania wysokiej jakości danych w bardziej efektywny sposób, aby wspierać uczenie i wnioskowanie modeli.

„Korzystamy z LakeFormation, technologii ujednoliconych zasobów danych i metadanych, aby zbudować logiczne jezioro danych z wielu jezior lub hurtowni danych” – powiedział Zhang. „Oznacza to, że jedna kopia danych może być współużytkowana przez wiele silników analizy danych i silników AI bez konieczności migracji danych. Ponadto nasz silnik AI4Data sprawia, że cały proces zarządzania danymi – od integracji danych, rozwoju, po zarządzanie jakością i aktywami – staje się bardziej inteligentny”.

Podczas szczytu Huawei Cloud opisał również, w jaki sposób innowacje zorientowane na sztuczną inteligencję i obszerna wiedza branżowa na temat modeli Pangu – w tym wirtualnego modelu człowieka – przyczyniły się do powstania infrastruktury przygotowanej na sztuczną inteligencję, która zmienia kształt wielu branż.

Modele Pangu łączą wiedzę branżową i możliwości modelu dużego języka (LLM), tworząc profesjonalnego asystenta, który może potencjalnie uczynić pracę wydajniejszą i łatwiejszą dla branż, przedsiębiorstw lub indywidualnych użytkowników.

W odróżnieniu od rozwiązań LLM, takich jak ChatGPT, Pangu Models 3.0 firmy Huawei Cloud charakteryzuje się trójwarstwową, oddzieloną architekturą, twierdzi firma. Warstwa L0 składa się z pięciu modeli podstawowych, które zapewniają ogólne umiejętności w zakresie zastosowań specyficznych dla branży energetycznej. L1 zawiera modele specyficzne dla branży, które są szkolone przy użyciu danych branżowych, podczas gdy L2 udostępnia modele dla konkretnych scenariuszy i zadań branżowych.

Pan Zhang przytoczył przypadki, w których model telekomunikacyjny Pangu pomógł firmom telekomunikacyjnym automatycznie rozwiązać do 90 procent usterek sieci w ciągu kilku minut, podczas gdy model badawczo-rozwojowy Pangu umożliwia programistom generowanie kodu za pomocą jednego monitu i testowanie przypadków za pomocą jednego kliknięcia. Dodał, że w prognozowaniu pogody Pangu wykorzystuje się także do dokładniejszego przewidywania trasy tajfunu w ciągu 10 dni w ciągu 10 sekund na jednym serwerze.

Co zaskakujące, wirtualny model człowieka Pangu może pochwalić się 95-procentową dokładnością synchronizacji ruchu warg podczas obsługi klienta i transmisji na żywo. Wirtualni ludzie są szeroko wykorzystywani w takich dziedzinach, jak handel elektroniczny, nadawanie wiadomości, edukacja i szkolenia.

W branży motoryzacyjnej Pangu automatycznie generuje narożniki dla wszelkiego rodzaju skomplikowanych scen jazdy, skracając czas potrzebny modelom jazdy autonomicznej na naukę nowych scen. W przygotowaniu są kolejne modele. Modele Pangu i powiązane usługi w chmurze można wdrażać z zachowaniem niezawodnego bezpieczeństwa i zgodności w chmurze publicznej, strefie dedykowanej lub chmurze hybrydowej.

Tymi ogłoszeniami na szczycie pani Shi ugruntowała plany Huawei Cloud dotyczące oferowania otwartego ekosystemu usług w chmurze i nowych firm. Firma współpracuje z klientami i partnerami w celu tworzenia opartych na scenariuszach rozwiązań dla branż pionowych, jednocześnie stale rozwijając KooVerse, infrastrukturę Huawei Cloud, na całym świecie w celu zapewnienia łatwego dostępu i wysokiej wydajności.

Ten artykuł został napisany przez Huawei.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://go.theregister.com/feed/www.theregister.com/2024/03/08/meeting_customer_requirements_for_database/