아동 성적 학대 자료(CSAM)의 확산을 막기 위해 Google, Meta, OpenAI를 포함한 최고의 생성 AI 개발자 연합은 신흥 기술에 대한 보호책을 시행하겠다고 약속했습니다.

이 그룹은 두 개의 비영리 단체, 즉 어린이 기술 그룹인 Thorn과 뉴욕에 본사를 둔 All Tech is Human에 의해 통합되었습니다. 이전에 DNA 재단으로 알려진 Thorn은 배우 Demi Moore와 Ashton Kutcher가 2012년에 설립했습니다.

단체 서약은 화요일에 새로운 내용과 함께 발표되었습니다. 가시 보고서 AI 모델의 전체 수명주기에 걸쳐 아동 성적 학대 자료(CSAM)의 생성을 방지하는 생성적 AI 개발에서 "설계를 통한 안전" 원칙을 옹호합니다.

“우리는 생성 AI 기술 및 제품을 개발, 배포, 유지 관리 및 사용하는 모든 기업이 이러한 설계 중심 원칙을 채택하고 CSAM, AIG-CSAM 및 기타 아동 성범죄 행위의 생성 및 확산을 방지하기 위한 헌신을 보여줄 것을 촉구합니다. 학대와 착취” 가시 성명에서 말했다.

AIG-CSAM은 AI로 생성된 CSAM으로, 보고서에 따르면 생성하기가 비교적 쉬울 수 있습니다.

가시가 발달하다 검색을 성적 학대와 착취로부터 아동을 보호하는 데 중점을 둔 자원. 2022년 영향 보고서에서 이 조직은 아동 학대 자료가 포함된 파일이 824,466개 이상 발견되었다고 밝혔습니다. 작년에 Thorn은 미국에서만 104억 XNUMX백만 개 이상의 CSAM 의심 파일이 보고되었다고 보고했습니다.

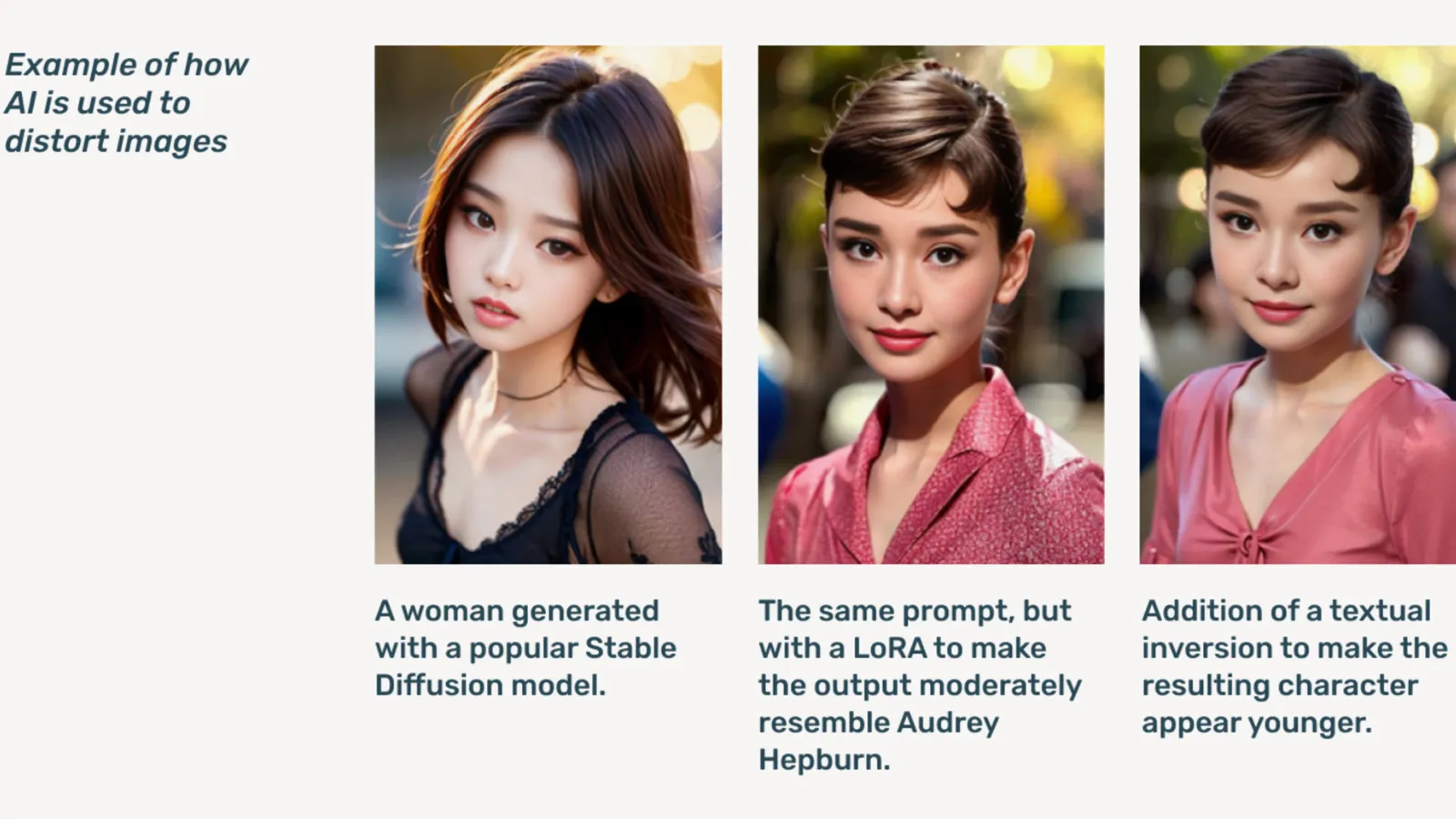

이미 온라인에서 문제가 되고 있는 딥페이크 아동 포르노는 생성 AI 모델이 공개된 후 급증했으며, 클라우드 서비스가 필요 없는 독립형 AI 모델이 온라인에서 유포되고 있습니다. 다크 웹 포럼.

Thorn은 생성적 AI를 사용하면 이전보다 더 쉽게 대량의 콘텐츠를 만들 수 있다고 말했습니다. 한 명의 아동 성범죄자가 원본 이미지와 비디오를 새로운 콘텐츠로 개조하는 것을 포함하여 대량의 아동 성적 학대 자료(CSAM)를 잠재적으로 생성할 수 있습니다.

"AIG-CSAM의 유입은 이미 부담을 안고 있는 아동 안전 생태계에 심각한 위험을 초래하며, 기존 학대 피해자를 식별 및 구조하고 더 많은 아동의 새로운 피해를 확대하는 데 있어 법 집행 기관이 직면한 어려움을 더욱 악화시킵니다."라고 Thorn은 말합니다.

Thorn의 보고서는 책임감 있는 교육 소싱을 포함하여 생성 AI 개발자가 자신의 기술이 아동 포르노 제작에 사용되는 것을 방지하기 위해 따라야 할 일련의 원칙을 간략하게 설명합니다. 데이터 세트, 피드백 루프와 스트레스 테스트 전략을 통합하고, 적대적 오용을 염두에 두고 콘텐츠 기록 또는 "출처"를 사용하고, 해당 AI 모델을 책임감 있게 호스팅합니다.

서약서에 서명하는 다른 사람들은 다음과 같습니다. Microsoft, 인류학, 미스트랄 AI, 아마존, 안정성 AI, 시민 AI및 형이상학, 각각 오늘 별도의 성명을 발표합니다.

Metaphysic의 최고 마케팅 책임자인 Alejandro Lopez는 "Metaphysic의 정신 중 하나는 AI 세계에서 책임 있는 개발입니다. 권한 부여에 관한 것이지만 책임에 관한 것입니다."라고 말했습니다. 해독. “우리는 시작하고 발전하는 것이 말 그대로 우리 사회에서 가장 취약한 계층인 어린이를 보호하는 것을 의미하며, 불행히도 딥 페이크 포르노 형태의 아동 성적 학대 자료에 사용되는 이 기술의 가장 어두운 끝을 의미한다는 것을 빨리 인식합니다. , 그런 일이 일어났습니다.”

2021에 출시, 형이상학 지난해 톰 행크스(Tom Hanks), 옥타비아 스펜서(Octavia Spencer), 앤 해서웨이(Anne Hathaway)를 포함한 여러 할리우드 스타가 AI 모델을 훈련하는 데 필요한 특성에 대한 소유권을 유지하기 위해 Metaphysic Pro 기술을 사용하여 유사성의 특성을 디지털화하고 있다는 사실이 밝혀진 후 작년에 두각을 나타냈습니다. .

OpenAI는 이 계획에 대해 더 이상의 언급을 거부하고 대신 다음을 제공했습니다. 해독 아동 안전 책임자인 첼시 칼슨(Chelsea Carlson)의 공개 성명입니다.

Carlson은 "우리는 도구의 안전과 책임감 있는 사용에 깊은 관심을 갖고 있습니다. 이것이 바로 우리가 ChatGPT와 DALL-E에 강력한 가드레일과 안전 조치를 구축한 이유입니다."라고 말했습니다. 성명서. "우리는 Thorn, All Tech is Human 및 더 넓은 기술 커뮤니티와 협력하여 안전 중심 설계 원칙을 유지하고 어린이에 대한 잠재적인 피해를 완화하기 위한 작업을 계속하기 위해 최선을 다하고 있습니다."

해독 연합의 다른 구성원들에게 연락했지만 즉시 답변을 듣지 못했습니다.

“Meta에서는 사람들을 온라인에서 안전하게 보호하기 위해 10년 넘게 노력해 왔습니다. 그 동안 우리는 잠재적인 피해를 예방하고 대처하는 데 도움이 되는 수많은 도구와 기능을 개발했습니다. 포식자가 우리의 보호를 회피하려고 시도함에 따라 우리도 계속해서 적응해 왔습니다.” 메타 준비된 성명에서 말했다.

"저희 제품 전반에 걸쳐 해시 매칭 기술, 인공 지능 분류자, 사람의 검토를 결합하여 CSAE 자료를 사전에 감지하고 제거합니다." 구글의 신뢰 및 안전 솔루션 담당 부사장 Susan Jasper가 게시물에 썼습니다. “우리의 정책과 보호 기능은 AI로 생성된 CSAM을 포함하여 모든 종류의 CSAE를 탐지하도록 설계되었습니다. 악의적인 콘텐츠를 식별하면 이를 제거하고 NCMEC에 신고하는 등 적절한 조치를 취합니다.”

지난 10월 영국 감시단체인 인터넷 시계 재단, AI가 생성한 아동 학대 자료는 '압도하다' 인터넷.

에 의해 수정 라이언 오자와.

암호화 뉴스를 최신 상태로 유지하고 받은 편지함에서 매일 업데이트를 받으십시오.

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- PlatoData.Network 수직 생성 Ai. 자신에게 권한을 부여하십시오. 여기에서 액세스하십시오.

- PlatoAiStream. 웹3 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 플라톤ESG. 탄소, 클린테크, 에너지, 환경, 태양광, 폐기물 관리. 여기에서 액세스하십시오.

- PlatoHealth. 생명 공학 및 임상 시험 인텔리전스. 여기에서 액세스하십시오.

- 출처: https://decrypt.co/227731/aig-csam-google-meta-openai-fight-ai-child-sexual-abuse-material