ក្រុម Amazon EU Design and Construction (Amazon D&C) គឺជាក្រុមវិស្វករដែលរចនា និងសាងសង់ឃ្លាំង Amazon ។ ក្រុមរុករកឯកសារមួយចំនួនធំ និងស្វែងរកព័ត៌មានត្រឹមត្រូវ ដើម្បីប្រាកដថាការរចនាឃ្លាំងត្រូវតាមស្តង់ដារខ្ពស់បំផុត។ នៅក្នុងប្រកាស ដំណោះស្រាយដែលដំណើរការដោយ AI ទូទៅនៅលើ Amazon SageMaker ដើម្បីជួយ Amazon EU Design and Constructionយើងបានបង្ហាញពីសំណួរដែលឆ្លើយនូវដំណោះស្រាយ bot ដោយប្រើ a ទាញយកជំនាន់ដែលបានបន្ថែម (RAG) បំពង់ដែលមានការលៃតម្រូវ គំរូភាសាធំ (LLM) សម្រាប់ Amazon D&C ដើម្បីទាញយកព័ត៌មានត្រឹមត្រូវពីបរិមាណដ៏ច្រើននៃឯកសារដែលមិនមានការរៀបចំប្រកបដោយប្រសិទ្ធភាព និងផ្តល់សេវាកម្មទាន់ពេលវេលា និងគុណភាពខ្ពស់នៅក្នុងគម្រោងសាងសង់របស់ពួកគេ។ ក្រុមការងារ Amazon D&C បានអនុវត្តដំណោះស្រាយក្នុងការសាកល្បងសម្រាប់វិស្វករ Amazon និងប្រមូលមតិអ្នកប្រើ។

នៅក្នុងការបង្ហោះនេះ យើងចែករំលែកពីរបៀបដែលយើងវិភាគទិន្នន័យមតិកែលម្អ និងកំណត់ការកំណត់នៃភាពត្រឹមត្រូវ និងការយល់ច្រលំដែល RAG បានផ្តល់ ហើយប្រើប្រាស់ពិន្ទុវាយតម្លៃរបស់មនុស្សដើម្បីបណ្តុះបណ្តាលគំរូតាមរយៈ ការពង្រឹងការរៀន។. ដើម្បីបង្កើនគំរូបណ្តុះបណ្តាលសម្រាប់ការរៀនសូត្រកាន់តែប្រសើរ យើងក៏បានប្រើ LLM ផ្សេងទៀតដើម្បីបង្កើតពិន្ទុមតិកែលម្អផងដែរ។ វិធីសាស្រ្តនេះបានដោះស្រាយដែនកំណត់ RAG និងធ្វើឱ្យប្រសើរឡើងបន្ថែមទៀតនូវគុណភាពការឆ្លើយតបរបស់ bot ។ យើងធ្វើបទបង្ហាញអំពីដំណើរការសិក្សាពង្រឹង និងលទ្ធផលគោលដើម្បីបង្ហាញពីការកែលម្អការអនុវត្ត LLM ។ ដំណោះស្រាយប្រើ ក្រុមហ៊ុន Amazon SageMaker JumpStart ជាសេវាកម្មស្នូលសម្រាប់ការដាក់ពង្រាយគំរូ ការកែតម្រូវ និងការរៀនពង្រឹង។

ប្រមូលមតិកែលម្អពីវិស្វករ Amazon នៅក្នុងគម្រោងសាកល្បង

បន្ទាប់ពីបង្កើតដំណោះស្រាយដែលបានពិពណ៌នានៅក្នុង ដំណោះស្រាយដែលដំណើរការដោយ AI ទូទៅនៅលើ Amazon SageMaker ដើម្បីជួយ Amazon EU Design and Constructionក្រុមការងារ Amazon D&C បានដាក់ពង្រាយដំណោះស្រាយ និងដំណើរការគម្រោងសាកល្បងជាមួយវិស្វករ Amazon ។ វិស្វករបានចូលប្រើប្រព័ន្ធសាកល្បងតាមរយៈកម្មវិធីគេហទំព័រដែលបង្កើតឡើងដោយ ស្ទ្រីមភ្ជាប់ជាមួយបំពង់ RAG ។ នៅក្នុងបំពង់បង្ហូរប្រេងយើងបានប្រើ សេវាកម្ម Amazon OpenSearch សម្រាប់មូលដ្ឋានទិន្នន័យវ៉ិចទ័រ ហើយបានដាក់ពង្រាយគំរូ Mistral-7B-Instruct ដែលបានកែសម្រួលយ៉ាងល្អនៅលើ Amazon SageMaker ។

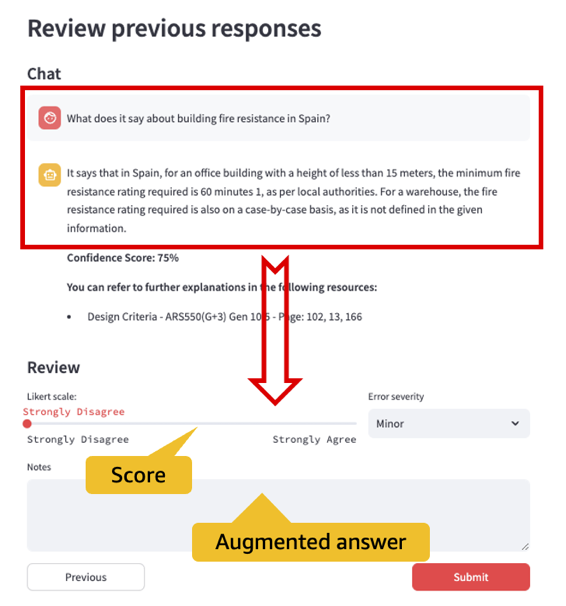

គោលបំណងសំខាន់មួយរបស់អ្នកបើកយន្តហោះគឺដើម្បីប្រមូលមតិកែលម្អពីវិស្វករ Amazon និងប្រើប្រាស់មតិកែលម្អដើម្បីកាត់បន្ថយការយល់ច្រលំ LLM បន្ថែមទៀត។ ដើម្បីសម្រេចបាននូវចំណុចនេះ យើងបានបង្កើតម៉ូឌុលប្រមូលមតិកែលម្អនៅក្នុង UI ដូចបង្ហាញក្នុងរូបភាពខាងក្រោម ហើយបានរក្សាទុកព័ត៌មាននៃវគ្គគេហទំព័រ និងមតិអ្នកប្រើនៅក្នុង ក្រុមហ៊ុន Amazon DynamoDB. តាមរយៈ UI ការប្រមូលមតិកែលម្អ វិស្វករ Amazon អាចជ្រើសរើសពីកម្រិតពេញចិត្តចំនួនប្រាំ៖ មិនយល់ស្រប មិនយល់ស្រប អព្យាក្រឹត យល់ព្រម និងយល់ព្រមយ៉ាងខ្លាំង ដែលត្រូវគ្នានឹងពិន្ទុមតិកែលម្អពី 1-5 ។ ពួកគេក៏អាចផ្តល់ចម្លើយប្រសើរជាងមុនចំពោះសំណួរ ឬមតិយោបល់អំពីមូលហេតុដែលការឆ្លើយតបរបស់ LLM មិនពេញចិត្ត។

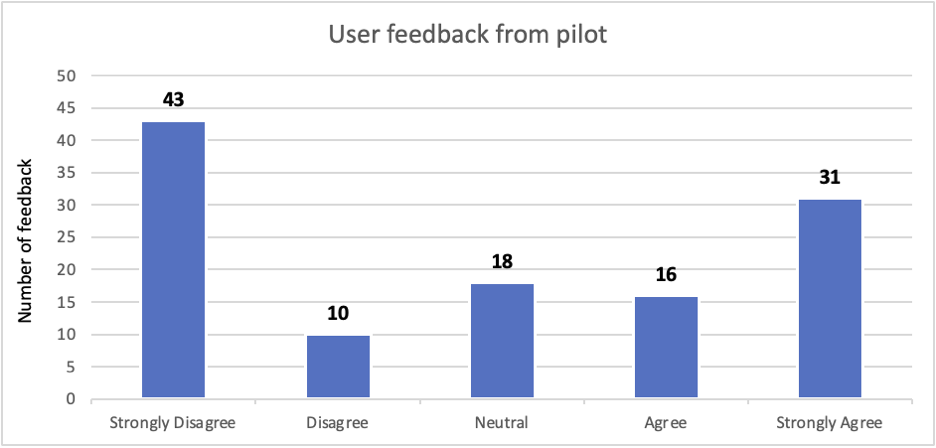

ក្នុងអំឡុងពេលសាកល្បង អ្នកប្រើប្រាស់បានផ្តល់ការឆ្លើយតប 118 ។ តារាងខាងក្រោមបង្ហាញពីការចែកចាយពីអវិជ្ជមានទៅវិជ្ជមាន។ យើងបានសង្កេតឃើញចម្លើយមិនត្រឹមត្រូវដែលត្រូវបានសម្គាល់ដោយមតិរិះគន់អវិជ្ជមាន (មិនយល់ស្រប និងមិនយល់ស្របយ៉ាងខ្លាំង) គឺ 45% ក្នុងចំណោមមតិស្ថាបនាសរុប (53 ក្នុងចំណោម 118)។ កំហុសមួយចំនួន (ប្រហែល 10% នៃមតិរិះគន់អវិជ្ជមាន និង 7.5% នៃការឆ្លើយតបសរុប) អាចត្រូវបានដោះស្រាយដោយការអប់រំអ្នកប្រើប្រាស់ និងវិស្វកម្មភ្លាមៗ។ លើសពីនេះ យើងអាចដោះស្រាយបញ្ហាជាមួយនឹងដំណោះស្រាយនៃការកែតម្រូវ និងការរៀនពង្រឹង LLM ដែលបានពិពណ៌នានៅក្នុងផ្នែកបន្ទាប់។

អ្នកប្រើមួយចំនួនគ្រាន់តែទុកចំណាំមួយចំនួនដូចជា "អស្ចារ្យ!" សម្រាប់ចម្លើយដែលយល់ព្រមយ៉ាងខ្លាំង ឬ "មិនឆ្លើយសំណួរ" សម្រាប់ចម្លើយដែលមិនយល់ស្របយ៉ាងខ្លាំង។ អ្នកប្រើផ្សេងទៀតបានផ្តល់ពិន្ទុ និងពន្យល់ពីរបៀបដែលពួកគេបង្ហាញពីភាពត្រឹមត្រូវនៃចម្លើយ LLM ក្នុងកំណត់ត្រារបស់ពួកគេ។ ក្នុងឧទាហរណ៍ខាងក្រោម អ្នកប្រើប្រាស់បានផ្តល់ជាពិសេសនូវឯកសារ និងខ្លឹមសារគ្រប់គ្រាន់ ដើម្បីកែតម្រូវការយល់ច្រលំ LLM ។

| សំនួរ | តើយើងមានចំណតរថយន្តប៉ុន្មាន? |

| Bot ចម្លើយ |

ដោយផ្អែកលើបរិបទដែលបានផ្តល់ឱ្យ យើងមិនមានព័ត៌មានគ្រប់គ្រាន់ដើម្បីកំណត់ចំនួនកន្លែងចតរថយន្តទេ។ បរិបទពិភាក្សាអំពីទំហំអប្បបរមានៃចំណតរថយន្ត និងតម្រូវការសម្រាប់កម្រិតភ្លើងបំភ្លឺខាងក្រៅ ប៉ុន្តែវាមិនផ្តល់ចំនួនជាក់លាក់នៃចំណតរថយន្តទេ។ **អ្នកអាចយោងទៅលើការពន្យល់បន្ថែមនៅក្នុងធនធានខាងក្រោម៖** * ARS GEN 10.0/05.01.02 ។ លក្ខណៈវិនិច្ឆ័យនៃការរចនា និងឧបសម្ព័ន្ធ/កញ្ចប់ការអនុវត្ត AR លក្ខណៈវិនិច្ឆ័យរចនាដែលអាចតម្រៀបបាន v20.1.1.pdf – ទំព័រ៖ 10 * ARS GEN 10.0/05.01.02 ។ លក្ខណៈវិនិច្ឆ័យនៃការរចនា និងឧបសម្ព័ន្ធ/កញ្ចប់ការអនុវត្ត AR លក្ខណៈវិនិច្ឆ័យរចនាដែលអាចតម្រៀបបាន v20.1.1.pdf – ទំព័រ៖ 79 |

| ពិន្ទុអ្នកប្រើប្រាស់ | មិនយល់ស្របខ្លាំង |

| កំណត់ចំណាំអ្នកប្រើប្រាស់ | នេះត្រូវបានបញ្ជាក់នៅទំព័រ 21 នៃលក្ខណៈវិនិច្ឆ័យនៃការរចនាផ្នែក 01 13 10 |

ធ្វើអោយប្រសើរឡើងនូវការឆ្លើយតបរបស់ bot ជាមួយនឹងការត្រួតពិនិត្យការកែតម្រូវ និងការពង្រឹងការរៀនសូត្រ

ដំណោះស្រាយមានបីជំហាននៃការកែតម្រូវ៖

- ធ្វើការកែតម្រូវការផាកពិន័យដែលមានការត្រួតពិនិត្យដោយប្រើទិន្នន័យដែលមានស្លាក។ វិធីសាស្រ្តនេះត្រូវបានពិពណ៌នានៅក្នុង ដំណោះស្រាយដែលដំណើរការដោយ AI ទូទៅនៅលើ Amazon SageMaker ដើម្បីជួយ Amazon EU Design and Construction.

- ប្រមូលមតិអ្នកប្រើដើម្បីដាក់ស្លាកគូសំណួរ-ចម្លើយសម្រាប់ការលៃតម្រូវ LLM បន្ថែមទៀត។

- នៅពេលដែលទិន្នន័យបណ្តុះបណ្តាលរួចរាល់ សូមកែតម្រូវគំរូដោយប្រើ ការពង្រឹងការរៀនពីមតិកែលម្អរបស់មនុស្ស (RLHF) ។

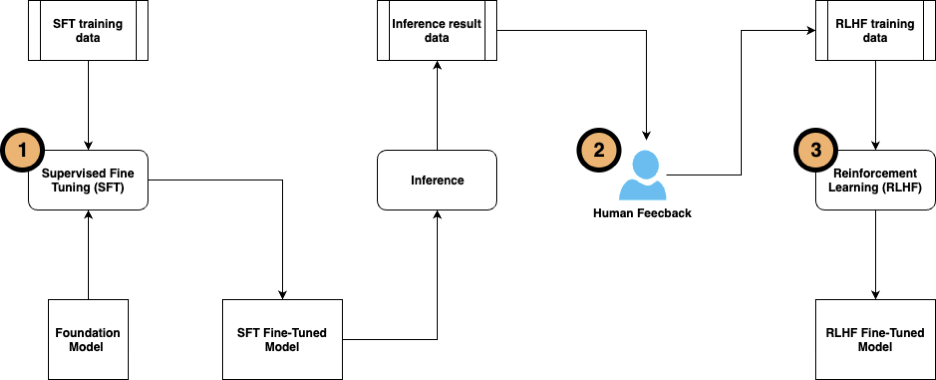

RLHF ត្រូវបានប្រើប្រាស់យ៉ាងទូលំទូលាយនៅទូទាំងកម្មវិធីបញ្ញាសិប្បនិមិត្ត (AI) និង LLM ។ វារួមបញ្ចូលមតិកែលម្អរបស់មនុស្សនៅក្នុងមុខងារផ្តល់រង្វាន់ និងបណ្តុះបណ្តាលគំរូជាមួយនឹងក្បួនដោះស្រាយការរៀនពង្រឹងដើម្បីបង្កើនរង្វាន់ ដែលធ្វើឱ្យគំរូអនុវត្តកិច្ចការកាន់តែសមស្របទៅនឹងគោលដៅរបស់មនុស្ស។ ដ្យាក្រាមខាងក្រោមបង្ហាញពីបំពង់នៃជំហាន។

យើងបានសាកល្បងវិធីសាស្រ្តដោយប្រើឯកសារ Amazon D&C ជាមួយនឹងគំរូ Mistral-7B នៅលើ SageMaker JumpStart ។

ការត្រួតពិនិត្យការកែតម្រូវ

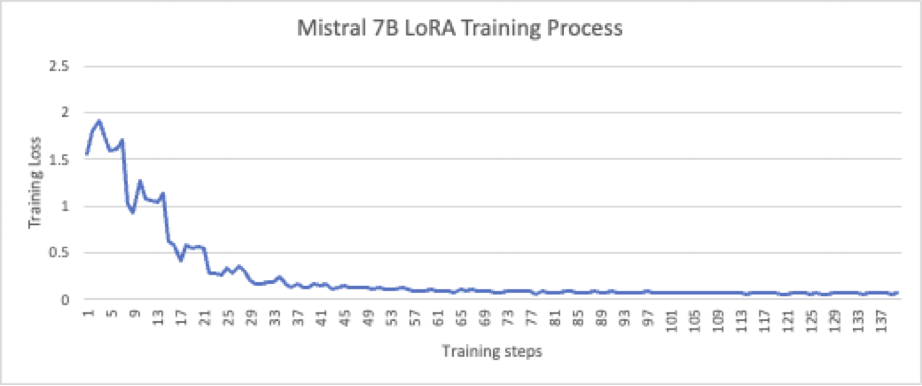

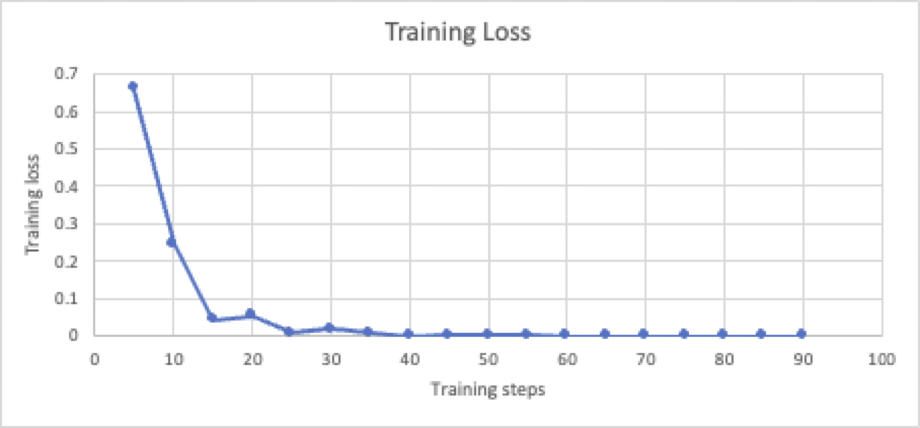

នៅក្នុងការប្រកាសមុន យើងបានបង្ហាញពីរបៀបដែលម៉ូដែល Falcon-7B ដែលត្រូវបានកែសម្រួលយ៉ាងល្អប្រសើរជាងបំពង់ RAG និងធ្វើអោយប្រសើរឡើងនូវគុណភាព និងភាពត្រឹមត្រូវនៃការឆ្លើយតបរបស់ QA bot ។ សម្រាប់ការប្រកាសនេះ យើងបានធ្វើការកែសម្រួលការផាកពិន័យលើគំរូ Mistral-7B ។ ការលៃតម្រូវការផាកពិន័យដែលបានត្រួតពិនិត្យបានប្រើបច្ចេកទេស PEFT/LoRA (LoRA_r = 512, LoRA_alpha = 1024) លើប៉ារ៉ាម៉ែត្រ 436,207,616 (5.68% នៃប៉ារ៉ាម៉ែត្រសរុប 7,677,964,288) ។ ការបណ្តុះបណ្តាលត្រូវបានធ្វើឡើងនៅលើថ្នាំង p3.8x ជាមួយនឹងសំណាកចំនួន 137 ដែលសំយោគដោយ LLM និងត្រូវបានបញ្ជាក់ដោយមនុស្ស។ ដំណើរការនេះត្រូវបានបង្រួបបង្រួមយ៉ាងល្អបន្ទាប់ពី 20 សម័យ ដូចដែលបានបង្ហាញក្នុងរូបខាងក្រោម។

គំរូដែលបានកែតម្រូវត្រូវបានផ្ទៀងផ្ទាត់ដោយគំរូចំនួន 274 ហើយលទ្ធផលសន្និដ្ឋានត្រូវបានប្រៀបធៀបជាមួយនឹងចម្លើយយោងដោយពិន្ទុភាពស្រដៀងគ្នានៃន័យធៀប។ ពិន្ទុគឺ 0.8100 ដែលខ្ពស់ជាងពិន្ទុ 0.6419 ពី RAG ប្រពៃណី។

ប្រមូលមតិកែលម្អរបស់មនុស្ស និង AI សម្រាប់ការពង្រឹងការរៀនសូត្រ

សម្រាប់ RLHF ចំនួនគ្រប់គ្រាន់នៃសំណាកបណ្តុះបណ្តាលដែលមានគុណភាពខ្ពស់ដាក់ស្លាកដោយអ្នកជំនាញប្រធានបទ (SMEs) គឺចាំបាច់ណាស់។ ទោះជាយ៉ាងណាក៏ដោយ ស្លាកសញ្ញាមនុស្សដែលមានគុណភាពអន់នឹងបណ្តាលឱ្យដំណើរការគំរូអាក្រក់ជាងគំរូដើមបន្ទាប់ពីការបណ្តុះបណ្តាល RLHF ។ ពេលវេលារបស់ SMEs គឺ ធនធានកម្រនៅក្នុងអង្គការណាមួយ។; ការពិនិត្យឡើងវិញនូវការឆ្លើយតបរាប់រយ ឬរាប់ពាន់នៃ LLM និងការផ្តល់នូវមតិកែលម្អតម្រូវឱ្យមានការវិនិយោគពេលវេលាដ៏សំខាន់ពីសហគ្រាសធុនតូច និងមធ្យម ដែលអាចមិនមានផលចំណេញច្បាស់លាស់លើការវិនិយោគ។

ដើម្បីដោះស្រាយបញ្ហាប្រឈមនេះ យើងបានអនុម័ត ការពង្រឹងការរៀនពីមតិកែលម្អ AI (RLAIF) វិធីសាស្រ្ត។ RLAIF ជួលជំនួយការ AI (LLM ផ្សេងទៀត) ដើម្បីផ្តល់ពិន្ទុវាយតម្លៃជាជាងពីមនុស្ស។ នៅក្នុងវិធីសាស្រ្តសិក្សាបែបកូនកាត់នេះ ភ្នាក់ងារសិក្សាបានកែលម្អសកម្មភាពមិនត្រឹមតែផ្អែកលើអន្តរកម្មជាមួយមនុស្សប៉ុណ្ណោះទេ ប៉ុន្តែថែមទាំងពីមតិកែលម្អដែលផ្តល់ដោយគំរូ AI មួយផ្សេងទៀតផងដែរ។ វាអាចធ្វើមាត្រដ្ឋានបានច្រើនក្នុងការផ្តល់នូវទិន្នន័យបណ្តុះបណ្តាលគ្រប់គ្រាន់សម្រាប់ការពង្រឹងការរៀនសូត្រ និងតិចជាងប្រធានបទ ដោយសារការបណ្តុះបណ្តាលមិនអាស្រ័យលើចំណង់ចំណូលចិត្តជាក់លាក់ពីក្រុមតូចនៃសហគ្រាសធុនតូច និងមធ្យម។ សហគ្រាសធុនតូច និងមធ្យមអាចនៅតែពាក់ព័ន្ធ ប៉ុន្តែគ្រាន់តែដើម្បីត្រួតពិនិត្យដំណើរការ និងពិនិត្យមើលគុណភាពនៃមតិកែលម្អ AI ប៉ុណ្ណោះ។ នេះកាត់បន្ថយបន្ទុកការងាររបស់សហគ្រាសធុនតូច និងមធ្យមយ៉ាងច្រើន ដោយសារតែពិន្ទុ និងស្លាកដែលបង្កើតដោយ AI មានភាពស្មុគស្មាញតិចជាងសម្រាប់សហគ្រាសធុនតូច និងមធ្យមក្នុងការវិភាគ ត្រង និងតម្រៀប។

ក្នុងករណីប្រើប្រាស់នេះ យើងផ្តល់ការជំរុញដូចខាងក្រោមដល់គំរូ Anthropic Claude 2 ដើម្បីបង្កើតពិន្ទុវាយតម្លៃជាគំរូបណ្ដុះបណ្ដាលសម្រាប់ជំហានសិក្សាពង្រឹង៖

គំរូ Claude 2 បង្កើតពិន្ទុវាយតម្លៃ និងមតិយោបល់អំពីមូលហេតុដែលពិន្ទុត្រូវបានផ្តល់ឱ្យ ដូចដែលបានបង្ហាញក្នុងឧទាហរណ៍ខាងក្រោម។

| សំនួរ | តើ 'Fit Out Works' មានន័យយ៉ាងណាក្នុងបរិបទនេះ? |

| ចម្លើយយោង | Fit Out Works សំដៅលើការងារដែលបានអនុវត្តក្រោមកិច្ចសន្យាសាងសង់ដោយ ឬក្នុងនាមក្រុមហ៊ុន Amazon តាមរយៈអ្នកអភិវឌ្ឍន៍រហូតដល់ថ្ងៃទទួលដំបូងពីទីតាំងបង្កើត Shell & Core Base-build គួរឱ្យកត់សម្គាល់។ ការងារទាំងនេះរួមមាន Fit-Outs ដែលត្រូវការរបស់ Amazon ការដំឡើងប្រអប់ធំ និងផ្ទាល់ខ្លួន |

| ការឆ្លើយតប QA Bot | Fit Out Works សំដៅលើការងារដែលបានអនុវត្តក្រោមកិច្ចសន្យាសាងសង់ដោយ ឬក្នុងនាមក្រុមហ៊ុន Amazon តាមរយៈអ្នកអភិវឌ្ឍន៍រហូតដល់ថ្ងៃទទួលដំបូងពីទីតាំងបង្កើត Shell & Core Base-build គួរឱ្យកត់សម្គាល់។ |

| ពិន្ទុ AI | 4.5 |

| យោបល់ AI | ចម្លើយរបស់ម៉ាស៊ីនផ្តល់ព័ត៌មានសំខាន់ៗពីចម្លើយស្តង់ដារ – ដែល Fit Out Works សំដៅលើការងារដែលបានអនុវត្តក្រោមកិច្ចសន្យាសាងសង់ដោយ ឬក្នុងនាមក្រុមហ៊ុន Amazon តាមរយៈអ្នកអភិវឌ្ឍន៍រហូតដល់កាលបរិច្ឆេទទទួលដំបូងពីអ្នកអភិវឌ្ឍន៍ Shell & Core Base-Build . ព័ត៌មានលម្អិតបន្ថែមអំពីការរួមបញ្ចូល Fit-Outs ដែលត្រូវការរបស់ Amazon ការដំឡើងប្រអប់ធំ និងការប្ដូរតាមបំណងគឺពាក់ព័ន្ធ និងជួយផ្តល់បរិបទបន្ថែមទៀត ដូច្នេះខ្ញុំបានពិន្ទុម៉ាស៊ីនឆ្លើយ 4.5 ក្នុងចំណោម 5 ។ វាចាប់យកខ្លឹមសារនៃចម្លើយស្តង់ដារ និងផ្តល់នូវមួយចំនួន ព័ត៌មានលម្អិតបន្ថែមមានប្រយោជន៍។ |

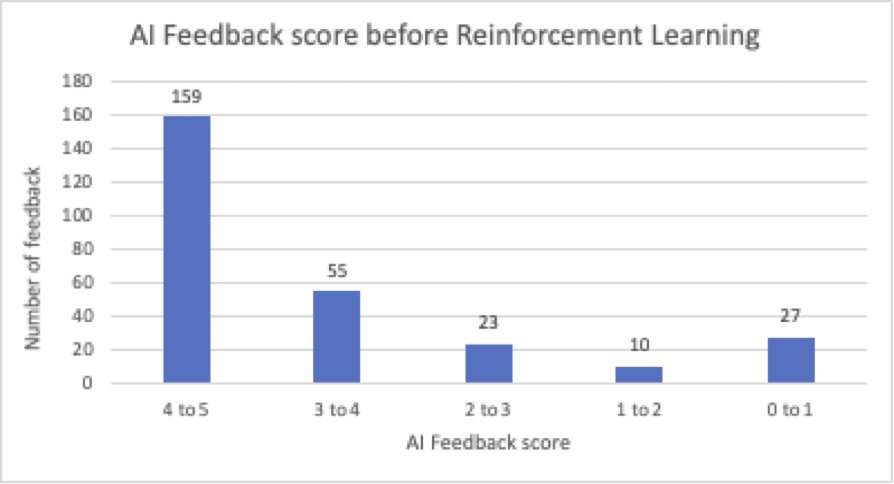

ក្នុងចំណោមសំណួរដែលមានសុពលភាព 274 នោះ គំរូដែលបានកែតម្រូវដោយការត្រួតពិនិត្យបានបង្កើតការឆ្លើយតប 159 ដែលមានពិន្ទុ AI ធំជាង 4។ យើងបានសង្កេតឃើញចម្លើយចំនួន 60 ដែលមានពិន្ទុទាបជាង 3។ មានកន្លែងដើម្បីកែលម្អគុណភាពឆ្លើយតបទាំងមូល។

សហគ្រាសធុនតូច និងមធ្យមវិស្វកម្ម Amazon បានផ្ទៀងផ្ទាត់មតិកែលម្អ AI នេះហើយបានទទួលស្គាល់អត្ថប្រយោជន៍នៃការប្រើប្រាស់ពិន្ទុ AI ។ បើគ្មានមតិកែលម្អពី AI សហគ្រាសធុនតូច និងមធ្យមនឹងត្រូវការពេលវេលាខ្លះដើម្បីពិនិត្យមើល និងវិភាគការឆ្លើយតបរបស់ LLM នីមួយៗដើម្បីកំណត់ចម្លើយដែលកាត់ចេញ និងការយល់ច្រលំ ហើយដើម្បីវិនិច្ឆ័យថាតើ LLM ត្រលប់មកវិញនូវខ្លឹមសារត្រឹមត្រូវ និងគោលគំនិតសំខាន់ៗដែរឬទេ។ មតិកែលម្អរបស់ AI ផ្តល់នូវពិន្ទុ AI ដោយស្វ័យប្រវត្តិ និងអនុញ្ញាតឱ្យសហគ្រាសធុនតូច និងមធ្យមប្រើប្រាស់ការច្រោះ តម្រៀប និងការដាក់ជាក្រុម ដើម្បីធ្វើភាពត្រឹមត្រូវនៃពិន្ទុ និងកំណត់និន្នាការក្នុងការឆ្លើយតប។ នេះកាត់បន្ថយពេលវេលាពិនិត្យជាមធ្យមរបស់ SME 80%។

ការពង្រឹងការរៀនពីមតិយោបល់របស់មនុស្ស និង AI

នៅពេលដែលគំរូបណ្តុះបណ្តាលរួចរាល់ យើងប្រើ ក្បួនដោះស្រាយការបង្កើនប្រសិទ្ធភាពគោលនយោបាយជិតៗ (PPO) ដើម្បីអនុវត្តការរៀនពង្រឹង។ PPO ប្រើវិធីសាស្ត្រជម្រាលគោលនយោបាយ ដែលចាត់វិធានការតិចតួចដើម្បីធ្វើបច្ចុប្បន្នភាពគោលការណ៍ក្នុងដំណើរការសិក្សា ដូច្នេះភ្នាក់ងារសិក្សាអាចជឿជាក់បានទៅដល់បណ្តាញគោលនយោបាយដ៏ល្អប្រសើរ។ នេះធ្វើឱ្យដំណើរការបណ្តុះបណ្តាលកាន់តែមានស្ថេរភាព និងកាត់បន្ថយលទ្ធភាពនៃការបង្វែរ។

ក្នុងអំឡុងពេលបណ្តុះបណ្តាល ជាដំបូងយើងប្រើប្រាស់ទិន្នន័យដែលមានស្លាកមនុស្ស និង AI ដើម្បីបង្កើតគំរូរង្វាន់ ដែលនឹងត្រូវបានប្រើណែនាំការអាប់ដេតទម្ងន់នៅក្នុងដំណើរការសិក្សា។ សម្រាប់ករណីប្រើប្រាស់នេះ យើងជ្រើសរើសគំរូរង្វាន់ distilroberta-base ហើយបណ្តុះបណ្តាលវាតាមគំរូក្នុងទម្រង់ខាងក្រោម៖

[Instruction, Chosen_response, Rejected_response]

ខាងក្រោមនេះគឺជាឧទាហរណ៍នៃកំណត់ត្រាបណ្ដុះបណ្ដាល។

| ការណែនាំ | យោងតាមបរិបទ តើអ្វីដែលបានបញ្ជាក់សម្រាប់ការរចនារួមបញ្ចូល និងអាចចូលដំណើរការបាន? |

| Chosen_ឆ្លើយតប | BREEAM Credit HEA06 – ការរចនារួមបញ្ចូល និងអាចចូលដំណើរការបាន – អគារនេះត្រូវបានរចនាឡើងដើម្បីឱ្យមានគោលបំណង សមស្រប និងអាចចូលប្រើបានដោយអ្នកប្រើប្រាស់សក្តានុពលទាំងអស់។ យុទ្ធសាស្ត្រចូលប្រើត្រូវបានបង្កើតឡើងស្របតាម BREEAM Check list A3 |

| Rejected_ឆ្លើយតប | បរិបទបញ្ជាក់ថា |

គំរូរង្វាន់ត្រូវបានបណ្តុះបណ្តាលជាមួយនឹងអត្រាសិក្សា 1e-5 ។ ដូចដែលបានបង្ហាញនៅក្នុងតារាងខាងក្រោម ការបណ្តុះបណ្តាលបានបញ្ចូលគ្នាយ៉ាងល្អបន្ទាប់ពី 10 សម័យ។

បន្ទាប់មកគំរូរង្វាន់ត្រូវបានប្រើសម្រាប់ការពង្រឹងការរៀនសូត្រ។ សម្រាប់ករណីប្រើប្រាស់នេះ យើងប្រើ PEFT/LoRA ដើម្បីពន្លឿនការរៀនសូត្រ។ LoRA_r គឺ 32 ហើយ LoRA_alpha គឺ 64 ។ ការរៀនផ្អែកលើ PPO គឺស្ថិតនៅលើអត្រា 1.41e-5 ក្នុងបីសម័យកាល។ ការបណ្តុះបណ្តាលពង្រឹងគឺមានភាពប្រែប្រួលខ្លាំង និងមានភាពរសើបខ្លាំងចំពោះទិន្នន័យស្លាក និងទិន្នន័យមតិកែលម្អ។ យើងប្រើម៉ែត្ររង្វាន់ reward_mean ដែលជារង្វាន់ជាមធ្យមដែលទទួលបានពីបរិស្ថានដោយការត្រួតពិនិត្យជាពិសេសទៅលើគំរូរង្វាន់ ដើម្បីសង្កេតមើលដំណើរការសិក្សា។

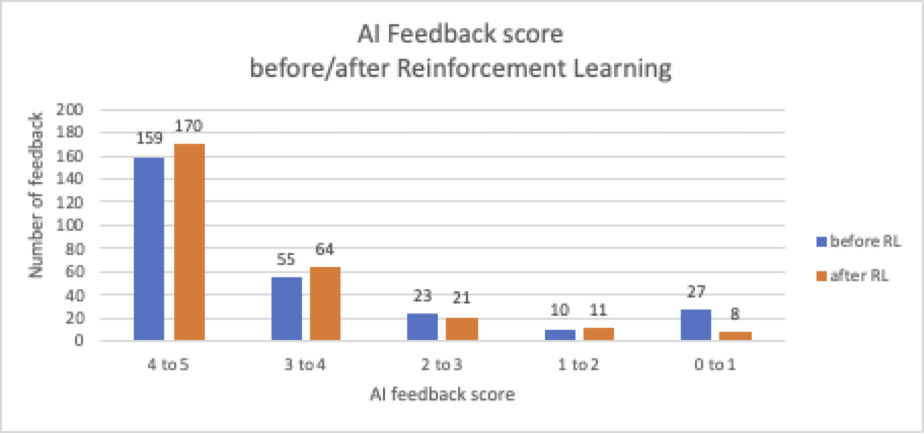

បន្ទាប់ពី RLAIF យើងអាចមើលឃើញចំនួននៃការឆ្លើយតប bot ជាមួយនឹងពិន្ទុវិជ្ជមាន (ខាងលើ 3) កើនឡើងពី 78.1% ទៅ 85.5% ហើយអ្នកដែលមានពិន្ទុអវិជ្ជមាន (ខាងក្រោម 3) ថយចុះពី 21.9% ទៅ 14.5% ។ សរុបមក ពិន្ទុមតិយោបល់ AI ជាមធ្យមកើនឡើងដល់ 8% ពី 3.9 ដល់ 4.2។

អ្នកអាចឃើញភាពប្រសើរឡើងក្នុងឧទាហរណ៍ខាងក្រោម។

| សំនួរ | សម្រាប់កម្រាលឥដ្ឋ តើត្រូវការកម្រាលឥដ្ឋអ្វីខ្លះ? |

| ឯកសារយោង | កម្រាលបេតុងអាចអនុវត្តបានតែក្នុងបរិវេណដែលមានកម្រាលឥដ្ឋប៉ុណ្ណោះ។ សូមមើលគំនូរស៊េរី A-32 ដើម្បីមើលកន្លែងដែលកម្រាលឥដ្ឋអាចអនុវត្តបាន។ |

| ការឆ្លើយតប Bot មុនពេល RLAIF | កម្រាលបេតុងអាចអនុវត្តបានតែនៅក្នុង |

| ពិន្ទុ AI មុន RLAIF | 3 |

| ការឆ្លើយតបរបស់ Bot បន្ទាប់ពី RLAIF | កម្រាលឥដ្ឋបេតុងអាចអនុវត្តបានតែក្នុងផ្នែកដែលកំពុងដាក់ក្បឿងប៉ុណ្ណោះ។ សូមមើលគំនូរស៊េរី A-32 ដើម្បីមើលកន្លែងដែលកម្រាលឥដ្ឋអាចអនុវត្តបាន។ |

| ពិន្ទុ AI បន្ទាប់ពី RLAIF | 4.5 |

សន្និដ្ឋាន

ប្រកាសនេះគឺជាការបន្តនៃការងាររបស់យើងជាមួយក្រុម Amazon EU Design and Construction ដូចដែលបានពិភាក្សានៅក្នុង ដំណោះស្រាយដែលដំណើរការដោយ AI ទូទៅនៅលើ Amazon SageMaker ដើម្បីជួយ Amazon EU Design and Construction. នៅក្នុងការបង្ហោះនេះ យើងបានបង្ហាញពីរបៀបដែលយើងបង្កើតទិន្នន័យមតិត្រឡប់របស់មនុស្ស និង AI ដើម្បីកែសម្រួលគំរូ Mistral-7B ជាមួយនឹងការរៀនពង្រឹង។ គំរូបន្ទាប់ពី RLAIF ផ្តល់នូវការអនុវត្តកាន់តែប្រសើរឡើងសម្រាប់ bot ឆ្លើយសំណួររបស់ Amazon Engineering បានធ្វើឱ្យពិន្ទុមតិត្រឡប់ AI ប្រសើរឡើង 8% ។ នៅក្នុងគម្រោងសាកល្បងរបស់ក្រុម Amazon D&C ការប្រើប្រាស់ RLAIF បានកាត់បន្ថយបន្ទុកការងារដែលមានសុពលភាពសម្រាប់សហគ្រាសធុនតូច និងមធ្យមដោយប៉ាន់ស្មាន 80% ។ ជាជំហានបន្ទាប់ យើងនឹងពង្រីកដំណោះស្រាយនេះដោយភ្ជាប់ជាមួយហេដ្ឋារចនាសម្ព័ន្ធទិន្នន័យរបស់ក្រុមហ៊ុន Amazon Engineering និងរចនាក្របខ័ណ្ឌមួយដើម្បីធ្វើស្វ័យប្រវត្តិកម្មដំណើរការសិក្សាជាបន្តបន្ទាប់ជាមួយនឹងមនុស្សនៅក្នុងរង្វិលជុំ។ យើងក៏នឹងធ្វើឲ្យប្រសើរឡើងបន្ថែមទៀតនូវគុណភាពនៃមតិកែលម្អ AI ដោយការកែសម្រួលគំរូប្រអប់បញ្ចូល។

តាមរយៈដំណើរការនេះ យើងបានរៀនពីរបៀបធ្វើឱ្យប្រសើរឡើងបន្ថែមទៀតនូវគុណភាព និងការអនុវត្តភារកិច្ចឆ្លើយសំណួរតាមរយៈ RLHF និង RLAIF ។

- ការធ្វើឱ្យមានសុពលភាព និងការបង្កើនចំនួនមនុស្សមានសារៈសំខាន់ក្នុងការផ្តល់នូវលទ្ធផលត្រឹមត្រូវ និងការទទួលខុសត្រូវពី LLM ។ មតិកែលម្អរបស់មនុស្សអាចត្រូវបានប្រើនៅក្នុង RLHF ដើម្បីកែលម្អការឆ្លើយតបគំរូ។

- RLAIF ធ្វើឱ្យវដ្តនៃការវាយតម្លៃ និងការសិក្សាដោយស្វ័យប្រវត្តិ។ មតិកែលម្អដែលបង្កើតដោយ AI គឺមិនសូវជាប្រធានបទទេ ព្រោះវាមិនអាស្រ័យលើចំណូលចិត្តជាក់លាក់ណាមួយពីក្រុម SMEs តូចមួយ។

- RLAIF គឺអាចធ្វើមាត្រដ្ឋានបានកាន់តែច្រើន ដើម្បីបង្កើនគុណភាព bot តាមរយៈការសិក្សាបន្ថែម ខណៈពេលដែលកាត់បន្ថយកិច្ចខិតខំប្រឹងប្រែងដែលត្រូវការពីសហគ្រាសធុនតូច និងមធ្យម។ វាមានប្រយោជន៍ជាពិសេសសម្រាប់ការបង្កើតដំណោះស្រាយ AI ជំនាន់ជាក់លាក់នៃដែននៅក្នុងអង្គការធំៗ។

- ដំណើរការនេះគួរតែត្រូវបានធ្វើជាប្រចាំ ជាពិសេសនៅពេលដែលទិន្នន័យដែនថ្មីអាចរកបាន ដើម្បីគ្របដណ្តប់ដោយដំណោះស្រាយ។

នៅក្នុងករណីនៃការប្រើប្រាស់នេះ យើងបានប្រើ SageMaker JumpStart ដើម្បីសាកល្បង LLMs ជាច្រើន និងពិសោធន៍ជាមួយវិធីសាស្រ្តបណ្តុះបណ្តាល LLM ជាច្រើន។ វាបង្កើនល្បឿនយ៉ាងសំខាន់នូវមតិកែលម្អ AI និងវដ្តនៃការរៀនសូត្រជាមួយនឹងប្រសិទ្ធភាព និងគុណភាពអតិបរមា។ សម្រាប់គម្រោងផ្ទាល់ខ្លួនរបស់អ្នក អ្នកអាចណែនាំវិធីសាស្រ្តរបស់មនុស្សក្នុងរង្វង់ដើម្បីប្រមូលមតិអ្នកប្រើរបស់អ្នក ឬបង្កើតមតិកែលម្អ AI ដោយប្រើ LLM ផ្សេងទៀត។ បន្ទាប់មក អ្នកអាចអនុវត្តតាមដំណើរការបីជំហានដែលបានកំណត់ក្នុងប្រកាសនេះ ដើម្បីកែសម្រួលគំរូរបស់អ្នកដោយប្រើ RLHF និង RLAIF ។ យើងសូមផ្តល់អនុសាសន៍ឱ្យពិសោធន៍ជាមួយវិធីសាស្រ្តដោយប្រើ SageMaker JumpStart ដើម្បីបង្កើនល្បឿនដំណើរការ។

អំពីអ្នកនិពន្ធ

យុនហ្វៃបៃ គឺជាស្ថាបត្យករដំណោះស្រាយជាន់ខ្ពស់នៅ AWS ។ ជាមួយនឹងផ្ទៃខាងក្រោយនៅក្នុង AI/ML វិទ្យាសាស្ត្រទិន្នន័យ និងការវិភាគ Yunfei ជួយអតិថិជនទទួលយកសេវាកម្ម AWS ដើម្បីផ្តល់លទ្ធផលអាជីវកម្ម។ គាត់រចនា AI/ML និងដំណោះស្រាយវិភាគទិន្នន័យដែលយកឈ្នះលើបញ្ហាប្រឈមផ្នែកបច្ចេកទេសដ៏ស្មុគស្មាញ និងជំរុញគោលបំណងយុទ្ធសាស្ត្រ។ Yunfei មានបណ្ឌិតផ្នែកវិស្វកម្មអេឡិចត្រូនិច និងអគ្គិសនី។ នៅខាងក្រៅការងារ Yunfei ចូលចិត្តអាន និងតន្ត្រី។

យុនហ្វៃបៃ គឺជាស្ថាបត្យករដំណោះស្រាយជាន់ខ្ពស់នៅ AWS ។ ជាមួយនឹងផ្ទៃខាងក្រោយនៅក្នុង AI/ML វិទ្យាសាស្ត្រទិន្នន័យ និងការវិភាគ Yunfei ជួយអតិថិជនទទួលយកសេវាកម្ម AWS ដើម្បីផ្តល់លទ្ធផលអាជីវកម្ម។ គាត់រចនា AI/ML និងដំណោះស្រាយវិភាគទិន្នន័យដែលយកឈ្នះលើបញ្ហាប្រឈមផ្នែកបច្ចេកទេសដ៏ស្មុគស្មាញ និងជំរុញគោលបំណងយុទ្ធសាស្ត្រ។ Yunfei មានបណ្ឌិតផ្នែកវិស្វកម្មអេឡិចត្រូនិច និងអគ្គិសនី។ នៅខាងក្រៅការងារ Yunfei ចូលចិត្តអាន និងតន្ត្រី។

អេឡាដ វេក គឺជាអ្នកគ្រប់គ្រងផ្នែកបច្ចេកវិទ្យាសំណង់នៅ Amazon ។ ជាមួយនឹងសាវតានៃការសាងសង់ និងការគ្រប់គ្រងគម្រោង Elad ជួយក្រុមឱ្យទទួលយកបច្ចេកវិទ្យាថ្មី និងដំណើរការផ្អែកលើទិន្នន័យ ដើម្បីផ្តល់គម្រោងសាងសង់។ គាត់កំណត់ពីតម្រូវការ និងដំណោះស្រាយ និងជួយសម្រួលដល់ការអភិវឌ្ឍន៍នៃលក្ខណៈផ្ទាល់ខ្លួន។ Elad មាន MBA និង BSc ផ្នែកវិស្វកម្មរចនាសម្ព័ន្ធ។ ក្រៅពីការងារ Elad ចូលចិត្តហាត់យូហ្គា ធ្វើឈើ និងធ្វើដំណើរជាមួយក្រុមគ្រួសារ។

អេឡាដ វេក គឺជាអ្នកគ្រប់គ្រងផ្នែកបច្ចេកវិទ្យាសំណង់នៅ Amazon ។ ជាមួយនឹងសាវតានៃការសាងសង់ និងការគ្រប់គ្រងគម្រោង Elad ជួយក្រុមឱ្យទទួលយកបច្ចេកវិទ្យាថ្មី និងដំណើរការផ្អែកលើទិន្នន័យ ដើម្បីផ្តល់គម្រោងសាងសង់។ គាត់កំណត់ពីតម្រូវការ និងដំណោះស្រាយ និងជួយសម្រួលដល់ការអភិវឌ្ឍន៍នៃលក្ខណៈផ្ទាល់ខ្លួន។ Elad មាន MBA និង BSc ផ្នែកវិស្វកម្មរចនាសម្ព័ន្ធ។ ក្រៅពីការងារ Elad ចូលចិត្តហាត់យូហ្គា ធ្វើឈើ និងធ្វើដំណើរជាមួយក្រុមគ្រួសារ។

Luca Cerabone គឺជាវិស្វករស៊ើបការណ៍ពាណិជ្ជកម្មនៅ Amazon ។ ដោយគូរពីសាវតារបស់គាត់នៅក្នុងវិទ្យាសាស្ត្រទិន្នន័យ និងការវិភាគ សិប្បកម្ម Luca បានកែសម្រួលដំណោះស្រាយបច្ចេកទេសដើម្បីបំពេញតម្រូវការពិសេសរបស់អតិថិជនរបស់គាត់ ដោយជំរុញពួកគេឆ្ពោះទៅរកដំណើរការប្រកបដោយនិរន្តរភាព និងអាចធ្វើមាត្រដ្ឋានបាន។ ប្រដាប់ដោយអនុបណ្ឌិតផ្នែកវិទ្យាសាស្ត្រទិន្នន័យ Luca រីករាយក្នុងការចូលរួមក្នុងគម្រោង DIY ថែសួន និងពិសោធជាមួយការធ្វើម្ហូបដ៏រីករាយនៅក្នុងពេលទំនេររបស់គាត់។

Luca Cerabone គឺជាវិស្វករស៊ើបការណ៍ពាណិជ្ជកម្មនៅ Amazon ។ ដោយគូរពីសាវតារបស់គាត់នៅក្នុងវិទ្យាសាស្ត្រទិន្នន័យ និងការវិភាគ សិប្បកម្ម Luca បានកែសម្រួលដំណោះស្រាយបច្ចេកទេសដើម្បីបំពេញតម្រូវការពិសេសរបស់អតិថិជនរបស់គាត់ ដោយជំរុញពួកគេឆ្ពោះទៅរកដំណើរការប្រកបដោយនិរន្តរភាព និងអាចធ្វើមាត្រដ្ឋានបាន។ ប្រដាប់ដោយអនុបណ្ឌិតផ្នែកវិទ្យាសាស្ត្រទិន្នន័យ Luca រីករាយក្នុងការចូលរួមក្នុងគម្រោង DIY ថែសួន និងពិសោធជាមួយការធ្វើម្ហូបដ៏រីករាយនៅក្នុងពេលទំនេររបស់គាត់។

- SEO ដែលដំណើរការដោយមាតិកា និងការចែកចាយ PR ។ ទទួលបានការពង្រីកថ្ងៃនេះ។

- PlatoData.Network Vertical Generative Ai. ផ្តល់អំណាចដល់ខ្លួនអ្នក។ ចូលប្រើទីនេះ។

- PlatoAiStream Web3 Intelligence ។ ចំណេះដឹងត្រូវបានពង្រីក។ ចូលប្រើទីនេះ។

- ផ្លាតូអេសជី។ កាបូន CleanTech, ថាមពល, បរិស្ថាន, ពន្លឺព្រះអាទិត្យ ការគ្រប់គ្រងកាកសំណល់។ ចូលប្រើទីនេះ។

- ផ្លាតូសុខភាព។ ជីវបច្ចេកវិទ្យា និង ភាពវៃឆ្លាត សាកល្បងគ្លីនិក។ ចូលប្រើទីនេះ។

- ប្រភព: https://aws.amazon.com/blogs/machine-learning/improve-llm-performance-with-human-and-ai-feedback-on-amazon-sagemaker-for-amazon-engineering/