児童性的虐待資料 (CSAM) の蔓延に対抗するため、Google、Meta、OpenAI を含むトップの生成 AI 開発者の連合は、この新興テクノロジーの周囲にガードレールを強化することを誓約しました。

このグループは、子供向けテクノロジー グループの Thorn とニューヨークに拠点を置く All Tech is Human という 2012 つの非営利組織によってまとめられました。以前は DNA 財団として知られていたソーンは、俳優のデミ ムーアとアシュトン カッチャーによって XNUMX 年に設立されました。

集団誓約は火曜日に新たな内容とともに発表された ソーンレポート AI モデルのライフサイクル全体にわたって児童性的虐待資料 (CSAM) の作成を防止する、生成 AI 開発における「設計による安全性」原則を提唱しています。

「私たちは、生成型 AI テクノロジーと製品を開発、展開、保守、使用しているすべての企業に対し、これらの Safety by Design 原則の採用を約束し、CSAM、AIG-CSAM、およびその他の児童性的行為の作成と蔓延の防止に熱心に取り組んでいることを示すよう強く求めます。虐待と搾取」 ソーン 声明の中で述べている。

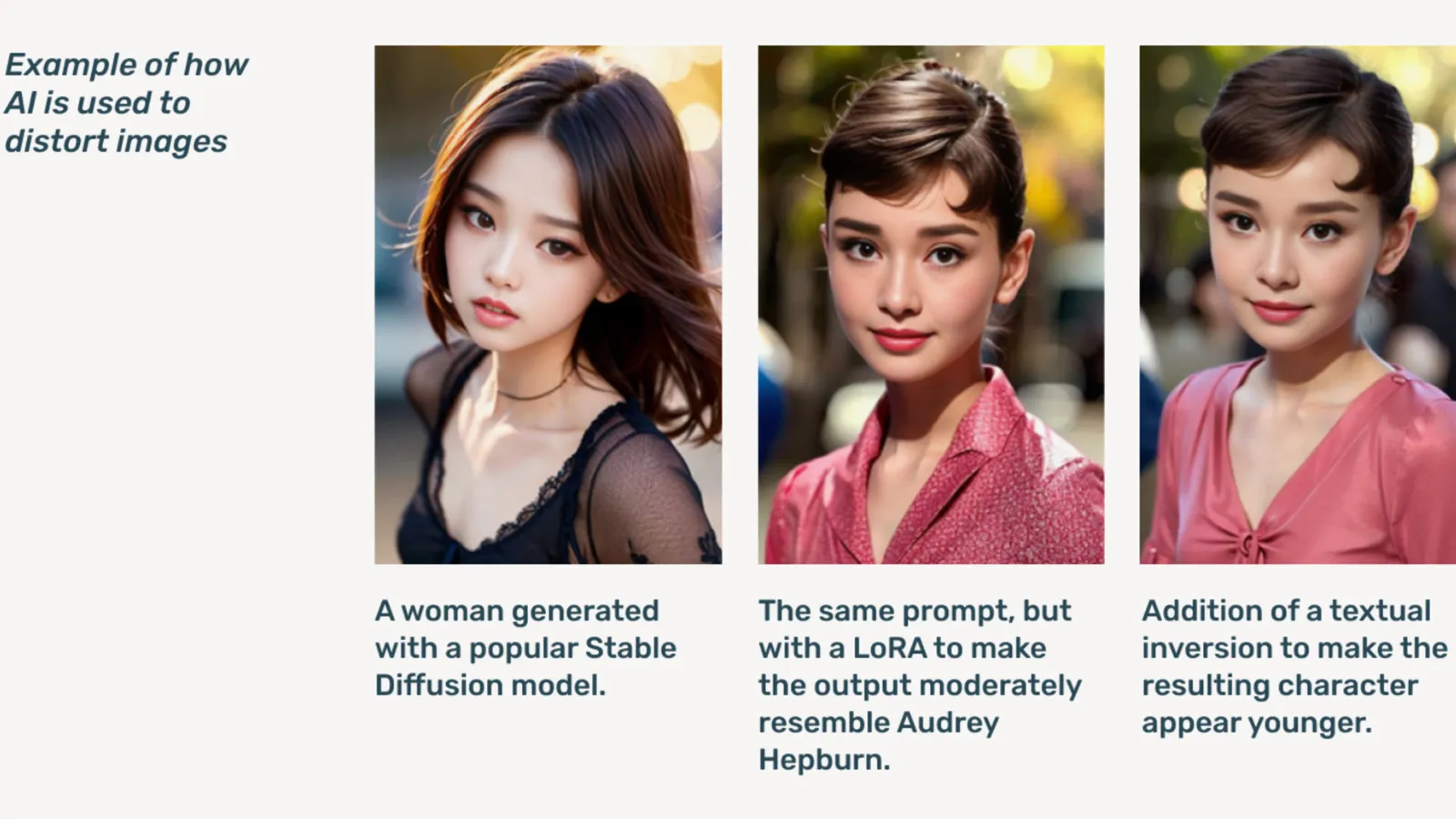

AIG-CSAM は AI によって生成された CSAM であり、レポートでは比較的簡単に作成できることが示されています。

とげが発達する 豊富なツール群 性的虐待や性的搾取から子供たちを守ることに焦点を当てたリソース。同団体は2022年の影響報告書で、児童虐待の内容を含むファイルが824,466万104件以上見つかったと発表した。昨年、ソーン氏は、CSAMの疑いのあるファイルが米国だけでXNUMX億XNUMX万件以上報告されたと報告した。

すでにネット上では問題になっているが、クラウドサービスを必要としないスタンドアロンのAIモデルが出回り、生成AIモデルが公開されてからディープフェイク児童ポルノが急増した。 ダークウェブ フォーラム。

ソーン氏によると、生成 AI により、大量のコンテンツの作成がかつてないほど簡単になりました。 1 人の児童犯罪者が、元の画像やビデオを新しいコンテンツに改変するなど、大量の児童性的虐待素材 (CSAM) を作成する可能性があります。

「AIG-CSAMの流入は、すでに課税されている子どもの安全エコシステムに重大なリスクをもたらし、既存の虐待被害者の特定と救出、そしてより多くの子どもたちの新たな被害拡大を図る上で法執行機関が直面する課題を悪化させている」とソーン氏は指摘する。

ソーン氏の報告書は、責任あるトレーニングの調達など、生成型 AI 開発者が自社のテクノロジーが児童ポルノの作成に使用されるのを防ぐために従うべき一連の原則を概説しています。 データセット、フィードバック ループとストレス テスト戦略を組み込み、敵対的な悪用を念頭に置いてコンテンツ履歴または「来歴」を採用し、それぞれの AI モデルを責任を持ってホストします。

誓約書に署名している他の人たちは次のとおりです。 Microsoft人類学, ミストラルAI, Amazon, スタビリティAI, シビットAI, 形而上学、今日それぞれが別々の声明を発表しています。

「Metaphysics の理念の一部は、AI の世界における責任ある開発です。そうです、それは権限を与えることですが、同時に責任も伴うのです」と Metaphysics の最高マーケティング責任者、アレハンドロ ロペス氏は語ります。 解読する。 「私たちは、これを開始し開発するということは、文字通り私たちの社会で最も弱い立場にある子供たちを守ることを意味し、残念なことに、ディープフェイクポルノの形で児童の性的虐待素材に使用されているこのテクノロジーの最も暗い結末であることをすぐに認識しています」 、それは起こりました。

2021に発売、 形而上学 昨年、トム・ハンクス、オクタヴィア・スペンサー、アン・ハサウェイを含む数人のハリウッドスターが、AIモデルのトレーニングに必要な特性の所有権を保持するために、Metaphysic Proテクノロジーを使用して自分の肖像の特徴をデジタル化していることが明らかになり、注目を集めました。 。

OpenAI はこの取り組みについてこれ以上コメントすることを拒否し、代わりに次のように述べた。 解読する 児童安全責任者のチェルシー・カールソン氏が公式声明を発表した。

「私たちはツールの安全性と責任ある使用を非常に重視しています。そのため、ChatGPT と DALL-E に強力なガードレールと安全対策を組み込んだのです」とカールソン氏は述べています。 ステートメント。 「私たちは、安全性バイデザインの原則を守り、子供たちへの潜在的な危害を軽減する取り組みを続けるために、Thorn、All Tech is Human、およびより広範なテクノロジーコミュニティと協力することに全力で取り組んでいます。」

解読する 連合の他のメンバーに連絡を取ったが、すぐには返答はなかった。

「メタでは、オンラインで人々の安全を守るために 10 年以上取り組んできました。その間、私たちは潜在的な危害を防止し、それに対抗するための数多くのツールや機能を開発してきました。そして、捕食者が私たちの保護を回避しようとするのに合わせて、私たちも適応し続けてきました。」 Meta と準備された声明で述べた。

「当社の製品全体で、ハッシュマッチング技術、人工知能分類器、人間によるレビューを組み合わせて、CSAE マテリアルを積極的に検出して削除しています。」 でログインの信頼および安全ソリューション担当副社長のスーザン・ジャスパー氏は、次のように投稿した。 「当社のポリシーと保護は、AI によって生成された CSAM を含む、あらゆる種類の CSAE を検出するように設計されています。搾取的なコンテンツを特定した場合は、それを削除し、NCMEC への報告を含む適切な措置を講じます。」

10月には英国の監視団体、 インターネット監視財団、AIが生成した児童虐待コンテンツは「圧倒する' インターネット。

による編集 ライアン・オザワ.

暗号ニュースを常に把握し、受信トレイで毎日更新を入手してください。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://decrypt.co/227731/aig-csam-google-meta-openai-fight-ai-child-sexual-abuse-material