Mendapatkan Sertifikasi AWS dapat membantu Anda mendorong karier Anda, apakah Anda mencari peran baru, menunjukkan keahlian Anda untuk mengambil proyek baru, atau menjadi ahli tim Anda. Dan karena ujian Sertifikasi AWS dibuat oleh para ahli dalam peran atau bidang teknis yang relevan, mempersiapkan salah satu ujian ini membantu Anda membangun keterampilan yang diperlukan yang diidentifikasi oleh praktisi ahli di bidang tersebut.

Membaca halaman FAQ layanan AWS yang relevan untuk ujian sertifikasi Anda penting untuk mendapatkan pemahaman yang lebih dalam tentang layanan tersebut. Namun, ini bisa memakan waktu cukup lama. Membaca FAQ bahkan dari satu layanan dapat memakan waktu setengah hari untuk membaca dan memahami. Misalnya, Amazon SageMaker FAQ berisi sekitar 33 halaman (cetak) konten hanya di SageMaker.

Bukankah akan menjadi pengalaman belajar yang lebih mudah dan menyenangkan jika Anda dapat menggunakan sistem untuk menguji diri sendiri di halaman FAQ layanan AWS? Sebenarnya, Anda dapat mengembangkan sistem seperti itu menggunakan model bahasa canggih dan beberapa baris Python.

Dalam postingan ini, kami menyajikan panduan komprehensif penerapan solusi kuis pilihan ganda untuk halaman FAQ layanan AWS apa pun, berdasarkan model dasar AI21 Jurassic-2 Jumbo Instruct pada Jumpstart Amazon SageMaker.

Model bahasa besar

Dalam beberapa tahun terakhir, model bahasa telah melihat lonjakan besar dalam ukuran dan popularitas. Pada tahun 2018, BERT-besar memulai debutnya dengan 340 juta parameter dan arsitektur transformator yang inovatif, menetapkan tolok ukur kinerja pada tugas-tugas NLP. Dalam beberapa tahun yang singkat, kecanggihan dalam hal ukuran model telah menggelembung lebih dari 500 kali lipat; GPT-3 OpenAI dan Bloom 176 B, keduanya dengan 175 miliar parameter, dan AI21 Jurassic-2 Jumbo Instruct dengan 178 miliar parameter hanyalah tiga contoh model bahasa besar (LLM) yang meningkatkan standar akurasi pemrosesan bahasa alami (NLP).

Model fondasi SageMaker

SageMaker menyediakan berbagai model dari hub model populer termasuk Hugging Face, PyTorch Hub, dan TensorFlow Hub, dan model propriety dari AI21, Cohere, dan LightOn, yang dapat Anda akses dalam alur kerja pengembangan pembelajaran mesin (ML) di SageMaker. Kemajuan terbaru dalam ML telah memunculkan kelas model baru yang dikenal sebagai model pondasi, yang memiliki miliaran parameter dan dilatih pada data dalam jumlah besar. Model dasar tersebut dapat disesuaikan dengan berbagai kasus penggunaan, seperti peringkasan teks, menghasilkan seni digital, dan terjemahan bahasa. Karena model ini mahal untuk dilatih, pelanggan ingin menggunakan model dasar pra-pelatihan yang sudah ada dan menyempurnakannya sesuai kebutuhan, daripada melatih model ini sendiri. SageMaker menyediakan daftar model pilihan yang dapat Anda pilih di konsol SageMaker.

Dengan JumpStart, Anda dapat menemukan model pondasi dari berbagai penyedia, memungkinkan Anda memulai dengan model pondasi dengan cepat. Anda dapat meninjau karakteristik model dan ketentuan penggunaan, dan mencoba model ini menggunakan widget UI pengujian. Saat Anda siap menggunakan model dasar dalam skala besar, Anda dapat melakukannya dengan mudah tanpa meninggalkan SageMaker dengan menggunakan notebook siap pakai dari penyedia model. Data Anda, baik yang digunakan untuk mengevaluasi atau menggunakan model dalam skala besar, tidak pernah dibagikan dengan pihak ketiga karena model dihosting dan diterapkan di AWS.

Instruksi Jumbo AI21 Jurassic-2

Jurassic-2 Jumbo Instruct adalah LLM oleh AI21 Labs yang dapat diterapkan pada pemahaman bahasa atau tugas pembuatan apa pun. Ini dioptimalkan untuk mengikuti instruksi dan konteks bahasa alami, jadi tidak perlu memberikan contoh apa pun. Titik akhir sudah dimuat sebelumnya dengan model dan siap untuk melayani kueri melalui API yang mudah digunakan dan Python SDK, sehingga Anda dapat mulai bekerja. Jurassic-2 Jumbo Instruct adalah penampil terbaik di HELM, khususnya dalam tugas yang berkaitan dengan membaca dan menulis.

Ikhtisar solusi

Di bagian berikut, kita melalui langkah-langkah untuk menguji model instruksi Jurassic-2 Jumbo di SageMaker:

- Pilih model instruksi Jurassic-2 Jumbo di konsol SageMaker.

- Evaluasi model menggunakan taman bermain.

- Gunakan buku catatan yang terkait dengan model dasar untuk menerapkannya di lingkungan Anda.

Akses Jurassic-2 Jumbo Instruct melalui konsol SageMaker

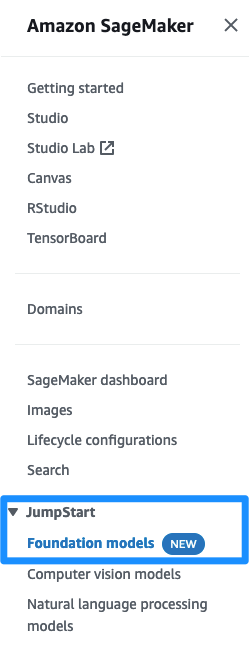

Langkah pertama adalah masuk ke konsol SageMaker. Di bawah Tingkatkan di panel navigasi, pilih Model pondasi untuk meminta akses ke daftar model.

Setelah akun Anda diizinkan terdaftar, Anda dapat melihat daftar model di halaman ini dan mencari model Jurassic-2 Jumbo Instruct.

Mengevaluasi model Jurassic-2 Jumbo Instruct di taman bermain model

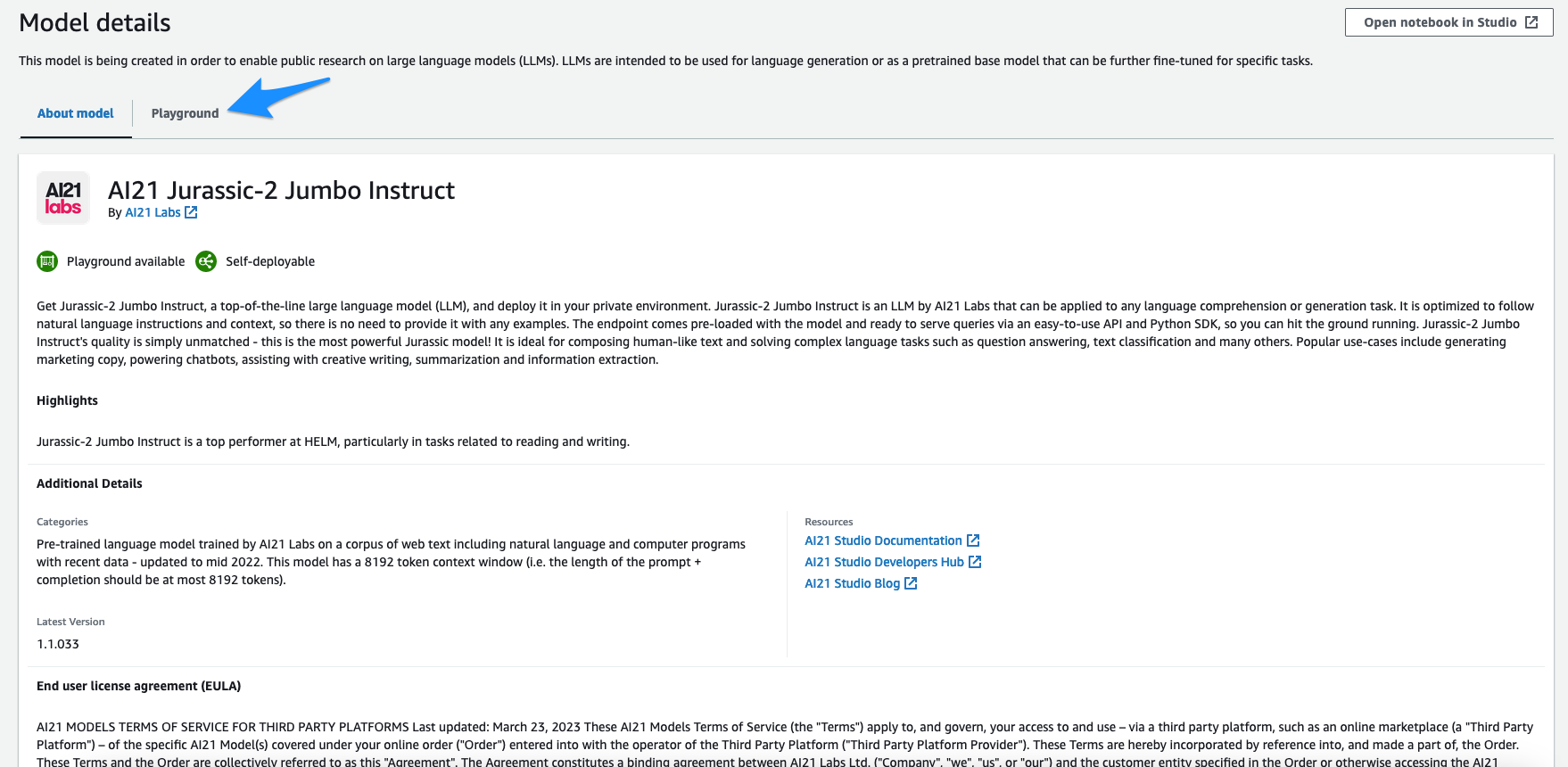

Pada daftar AI21 Jurassic-2 Jumbo Instruct pilih Lihat Model. Anda akan melihat deskripsi model dan tugas yang dapat Anda lakukan. Baca EULA untuk model sebelum melanjutkan.

Pertama mari kita coba model untuk membuat pengujian berdasarkan halaman FAQ SageMaker. Arahkan ke tempat bermain Tab.

pada tempat bermain tab, Anda dapat memberikan petunjuk sampel ke model Jurassic-2 Jumbo Instruct dan melihat hasilnya.

Perhatikan bahwa Anda dapat menggunakan maksimal 500 token. Kami menetapkan panjang Maks ke 500, yang merupakan jumlah maksimum token yang akan dihasilkan. Model ini memiliki jendela konteks 8,192 token (panjang prompt plus penyelesaian harus maksimal 8,192 token).

Untuk memudahkan melihat prompt, Anda dapat memperbesar Cepat kotak.

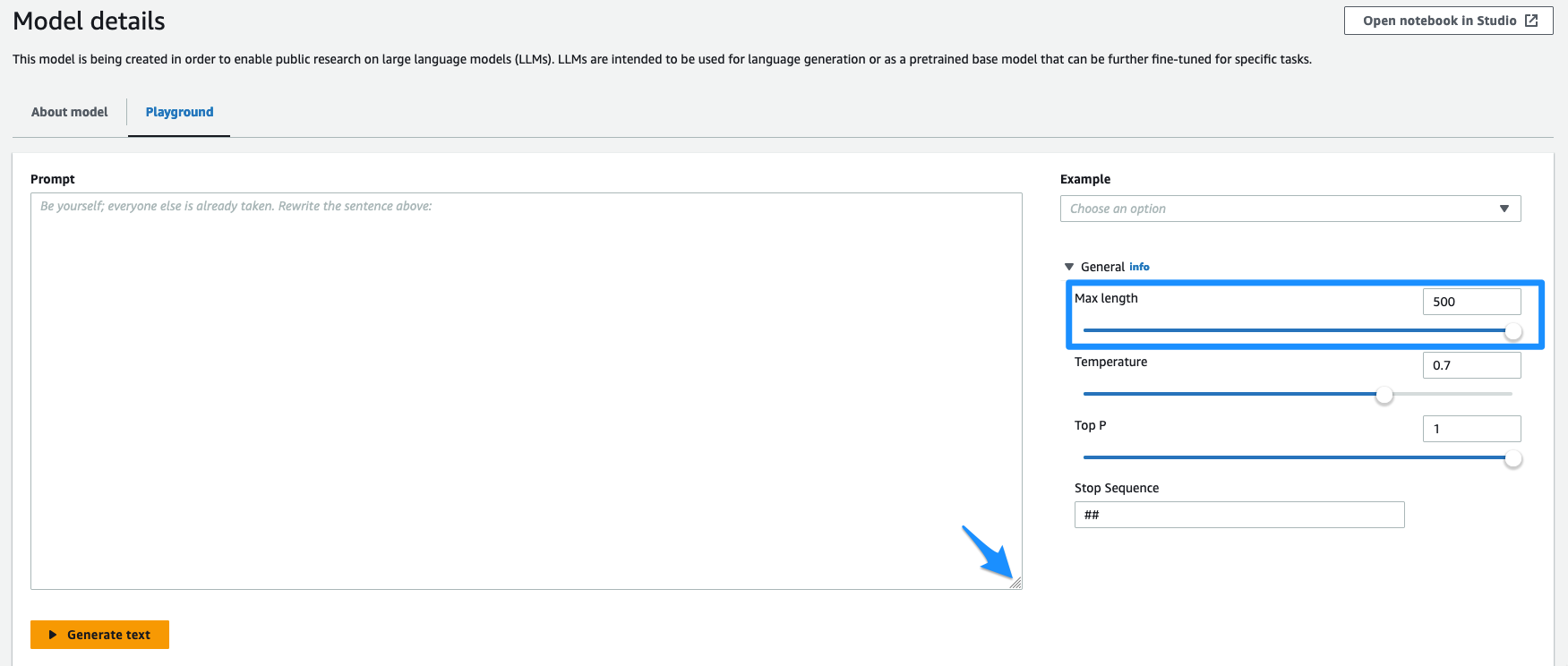

Karena kami dapat menggunakan maksimal 500 token, kami mengambil sebagian kecil darinya Halaman FAQ Amazon SageMaker, yang ML kode rendah bagian, untuk prompt pengujian kami.

Kami menggunakan perintah berikut:

Rekayasa cepat adalah proses berulang. Anda harus jelas dan spesifik, dan berikan waktu kepada model untuk berpikir.

Di sini kami menentukan konteks dengan ## sebagai urutan berhenti, yang menandakan model untuk berhenti menghasilkan setelah karakter atau string ini dibuat. Ini berguna saat menggunakan prompt beberapa tembakan.

Selanjutnya, kami jelas dan sangat spesifik dalam permintaan kami, meminta kuis pilihan ganda, terdiri dari empat pertanyaan dengan empat opsi. Kami meminta model untuk menyertakan jawaban yang benar untuk setiap pertanyaan menggunakan string awal 'Correct Answer:' jadi kita bisa menguraikannya nanti menggunakan Python:

Prompt yang dirancang dengan baik dapat membuat model lebih kreatif dan tergeneralisasi sehingga dapat dengan mudah beradaptasi dengan tugas baru. Anjuran juga dapat membantu menggabungkan pengetahuan domain pada tugas tertentu dan meningkatkan kemampuan interpretasi. Rekayasa cepat dapat sangat meningkatkan kinerja model pembelajaran zero-shot dan few-shot. Membuat prompt berkualitas tinggi membutuhkan pertimbangan yang cermat terhadap tugas yang ada, serta pemahaman yang mendalam tentang kekuatan dan keterbatasan model.

Dalam cakupan posting ini, kami tidak membahas area yang luas ini lebih jauh.

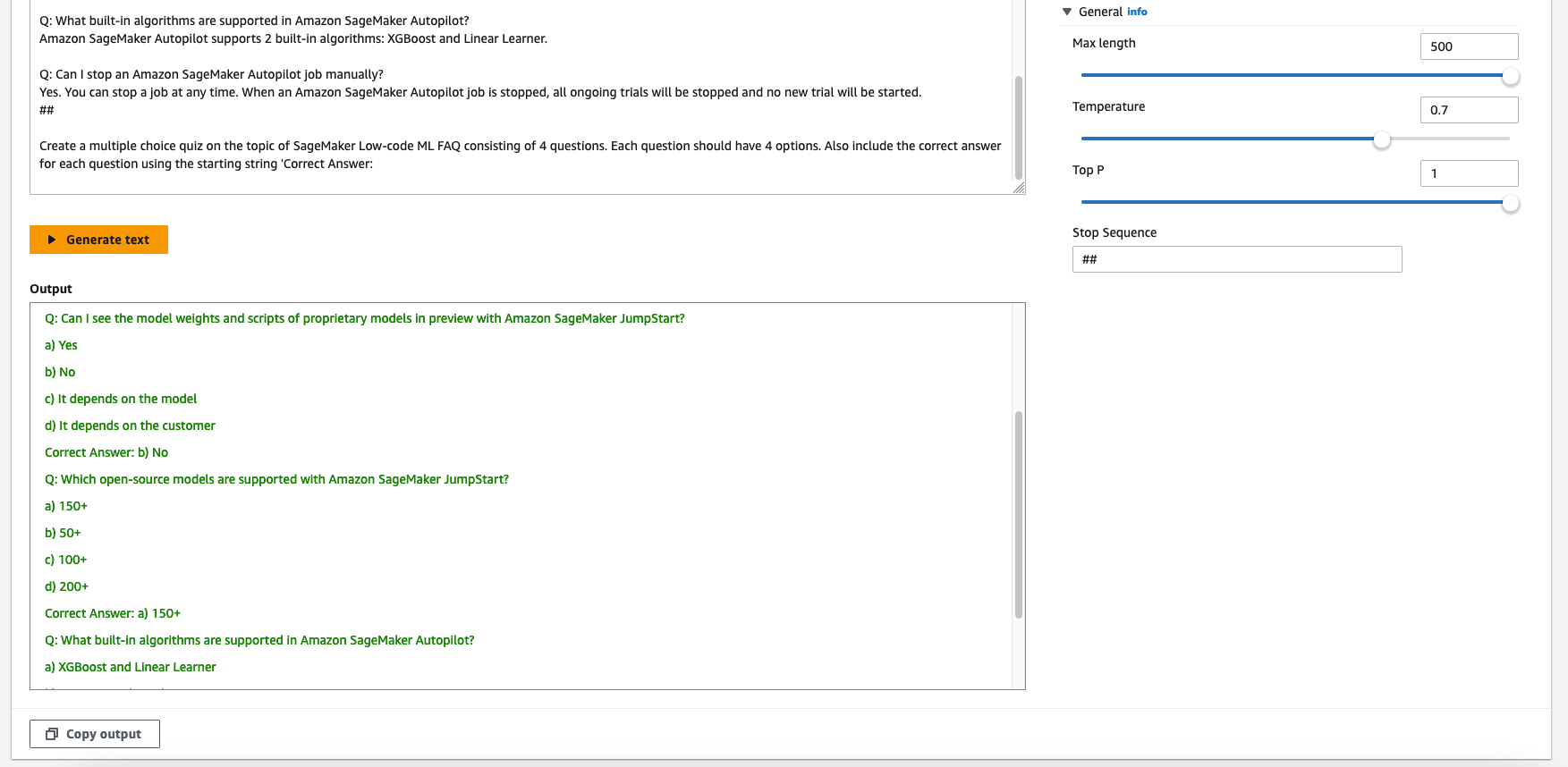

Salin prompt dan masukkan di Cepat kotak, lalu pilih Hasilkan teks.

Ini mengirimkan prompt ke model Jurassic-2 Jumbo Instruct untuk inferensi. Perhatikan bahwa bereksperimen di taman bermain itu gratis.

Juga perlu diingat bahwa meskipun LLM bersifat mutakhir, mereka masih rentan terhadap bias, kesalahan, dan halusinasi.

Setelah membaca output model secara menyeluruh dan hati-hati, kita dapat melihat bahwa model tersebut menghasilkan kuis yang cukup bagus!

Setelah Anda bermain-main dengan model, saatnya menggunakan notebook dan menerapkannya sebagai titik akhir di lingkungan Anda. Kami menggunakan fungsi Python kecil untuk mem-parsing output dan mensimulasikan pengujian interaktif.

Terapkan model fondasi Jurassic-2 Jumbo Instruct dari notebook

Anda dapat menggunakan yang berikut ini: buku catatan sampel untuk menerapkan Jurassic-2 Jumbo Instruct menggunakan SageMaker. Perhatikan bahwa contoh ini menggunakan instance ml.p4d.24xlarge. Jika batas default untuk akun AWS Anda adalah 0, Anda harus melakukannya meminta kenaikan limit untuk contoh GPU ini.

Mari buat titik akhir menggunakan inferensi SageMaker. Pertama, kami menetapkan variabel yang diperlukan, lalu menerapkan model dari paket model:

Setelah titik akhir disebarkan, Anda dapat menjalankan kueri inferensi terhadap model.

Setelah model di-deploy, Anda dapat berinteraksi dengan endpoint yang di-deploy menggunakan cuplikan kode berikut:

Dengan model dasar Jumbo Instruct Jurassic-2 yang diterapkan pada titik akhir SageMaker instans ml.p4d.24xlarge, Anda dapat menggunakan prompt dengan 4,096 token. Anda dapat mengambil prompt yang sama yang kami gunakan di taman bermain dan menambahkan lebih banyak pertanyaan. Dalam contoh ini, kami menambahkan seluruh FAQ ML kode rendah bagian sebagai konteks ke prompt.

Kita dapat melihat output dari model tersebut, yang menghasilkan kuis pilihan ganda dengan empat pertanyaan dan empat pilihan untuk setiap pertanyaan.

Sekarang Anda dapat mengembangkan fungsi Python untuk mengurai output dan membuat kuis pilihan ganda interaktif.

Cukup mudah untuk mengembangkan fungsi seperti itu dengan beberapa baris kode. Anda dapat menguraikan jawabannya dengan mudah karena model membuat baris dengan “Jawaban yang Benar: ” untuk setiap pertanyaan, persis seperti yang kami minta di prompt. Kami tidak menyediakan kode Python untuk pembuatan kuis dalam lingkup postingan ini.

Jalankan kuis di buku catatan

Menggunakan fungsi Python yang kita buat sebelumnya dan output dari model dasar Jurassic-2 Jumbo Instruct, kita menjalankan kuis interaktif di notebook.

Anda dapat melihat saya menjawab tiga dari empat pertanyaan dengan benar dan mendapat nilai 75%. Mungkin saya perlu membaca FAQ SageMaker beberapa kali lagi!

Membersihkan

Setelah Anda mencoba titik akhir, pastikan untuk menghapus titik akhir inferensi SageMaker dan model untuk mencegah biaya apa pun:

Kesimpulan

Dalam postingan ini, kami menunjukkan cara menguji dan menggunakan model Jurassic-21 Jumbo Instruct AI2 menggunakan SageMaker untuk membuat sistem pembuatan kuis otomatis. Ini dicapai dengan menggunakan prompt yang agak sederhana dengan teks halaman FAQ SageMaker yang tersedia untuk umum yang disematkan dan beberapa baris kode Python.

Mirip dengan contoh yang disebutkan di postingan ini, Anda dapat menyesuaikan model fondasi untuk bisnis Anda hanya dengan beberapa contoh berlabel. Karena semua data dienkripsi dan tidak meninggalkan akun AWS Anda, Anda dapat percaya bahwa data Anda akan tetap pribadi dan rahasia.

Minta akses ke mencoba model pondasi di SageMaker hari ini, dan beri tahu kami tanggapan Anda!

tentang Penulis

Eitan Sela adalah Arsitek Solusi Spesialis Pembelajaran Mesin dengan Amazon Web Services. Dia bekerja dengan pelanggan AWS untuk memberikan panduan dan bantuan teknis, membantu mereka membangun dan mengoperasikan solusi pembelajaran mesin di AWS. Di waktu luangnya, Eitan menikmati jogging dan membaca artikel pembelajaran mesin terbaru.

Eitan Sela adalah Arsitek Solusi Spesialis Pembelajaran Mesin dengan Amazon Web Services. Dia bekerja dengan pelanggan AWS untuk memberikan panduan dan bantuan teknis, membantu mereka membangun dan mengoperasikan solusi pembelajaran mesin di AWS. Di waktu luangnya, Eitan menikmati jogging dan membaca artikel pembelajaran mesin terbaru.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoAiStream. Kecerdasan Data Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Mencetak Masa Depan bersama Adryenn Ashley. Akses Di Sini.

- Beli dan Jual Saham di Perusahaan PRE-IPO dengan PREIPO®. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/accelerate-your-learning-towards-aws-certification-exams-with-automated-quiz-generation-using-amazon-sagemaker-foundations-models/