Setelah meluncurkan akselerator AI generasi kedua pada bulan Februari, Meta siap untuk memperkenalkan silikon buatan sendiri ini, yang dikatakan telah mendukung rekomendasi iklan di 16 wilayah.

Raksasa Facebook telah merancang akselerator khusus untuk segala jenis beban kerja mulai dari streaming video hingga pembelajaran mesin untuk mendorong model pemberi rekomendasi di balik kerajaan periklanannya.

Grafik tambahan terbaru ke keluarga Meta Training Inference Accelerator (MTIA) mengklaim kinerja 3x lebih tinggi dan keunggulan efisiensi daya 1.5x dibandingkan bagian generasi pertama, yang merupakan teman kita di The Next Platform dianalisis tahun lalu.

Menurut Meta, chip generasi kedua, yang akan kami sebut MTIA v2 demi konsistensi, dirancang untuk menyeimbangkan komputasi, kapasitas memori, dan bandwidth untuk mendapatkan kinerja terbaik untuk peringkat internal hyperscaler dan model pemberi rekomendasi. .

Melihat lebih dalam pada desainnya, akselerator ini dilengkapi dengan grid elemen pemrosesan (PE) berukuran 8×8 yang bersama-sama menawarkan kinerja komputasi padat 3.5x lebih tinggi atau kinerja 7x lebih tinggi dengan ketersebaran yang diaktifkan dibandingkan dengan MTIA v1.

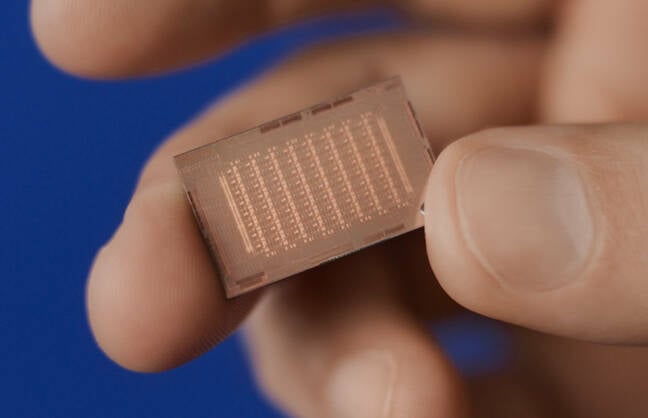

Akselerator AI terbaru Meta, di atas, telah mendukung model pemeringkatan dan pemberi rekomendasi hyperscaler – Klik untuk memperbesar. Sumber: Meta

Selain menggunakan node proses TSMC 5nm yang lebih kecil dan meningkatkan kecepatan clock dari 800MHz menjadi 1.35GHz, Meta mencatat beberapa peningkatan arsitektur dan desain yang berkontribusi pada peningkatan kinerja komponen terbaru. Hal ini termasuk dukungan untuk komputasi yang lebih jarang, memori on-die dan off-die yang lebih banyak, dan network-on-chip (NoC) yang ditingkatkan dengan bandwidth dua kali lipat dari model lama. Berikut perbandingan generasi pertama dan kedua:

| MTIA v1 | MTIA v2 | |

|---|---|---|

| Teknologi proses | TSMC 7nm | TSMC 5nm |

| daerah mati | 373mm2 | 421mm2 |

| PP | 8 × 8 kotak | 8 × 8 kotak |

| Kecepatan jam | 800MHz | 1.35GHz |

| kinerja INT8 | 102 TOPS | 354/708* ATAS |

| Performa FP16/BF16 | 51.2 TFLOPS | 177/354* TFLOPS |

| anggota olahraga | 128KB per PE | 384KB per PE |

| Mem dalam chip | 128MB | 256MB |

| Mem off-chip | 64GB | 128GB |

| mem BW di luar chip | 176GB / dtk | 204GB / dtk |

| Konektivitas | 8x PCIe Gen 4.0 – 16 GB/dtk | 8x PCIe Gen 5.0 – 32 GB/dtk |

| TDP | 25W | 90W |

* Kinerja yang jarang. Anda dapat menemukan rincian lengkap kedua chip tersebut di sini.

Perlu dicatat bahwa MTIA v2 tidak akan menghilangkan kebutuhan web goliath akan GPU. Meta supremo Mark Zuckerberg sebelumnya mengatakan perusahaan besarnya akan disebarkan 350,000 akselerator Nvidia H100 dan akan beroperasi setara dengan 600,000 H100 pada akhir tahun.

Sebaliknya, MTIA mengikuti pola yang semakin akrab bagi Meta (dan lainnya) dalam mengembangkan silikon khusus yang disesuaikan dengan tugas tertentu. Idenya adalah meskipun kit ini mungkin tidak sefleksibel CPU dan GPU, ASIC jika digunakan dalam skala besar bisa lebih efisien.

Meskipun chip terbaru ini mengonsumsi daya hampir empat kali lipat dibandingkan pendahulunya, chip ini mampu menghasilkan kinerja floating point hingga 7x lebih baik. Diadu dengan GPU, akselerator terbaru Meta mengelola 7.8 TOPS per watt (TOPS/W), yang menurut kami dibahas dalam cakupan Blackwell kami, mengalahkan H100 SXM Nvidia pada 5.65 TOPS/W dan lebih dari dua kali lipat A100 SXM pada 3.12 TOPS/W.

Karena itu, jelas bahwa Meta telah berusaha keras untuk menyesuaikan ukuran chip dengan beban kerja internalnya — yaitu menyimpulkan model yang direkomendasikan. Ini dirancang untuk memberikan saran yang dipersonalisasi seperti orang yang mungkin Anda kenal atau, yang lebih penting untuk model bisnis Meta, iklan mana yang kemungkinan besar relevan bagi Anda.

Chip ini juga dirancang untuk diperluas sesuai kebutuhan dan dapat diterapkan dalam sistem berbasis rak yang berisi total 72 akselerator: Setiap sistem menggabungkan tiga sasis yang masing-masing berisi 12 papan komputasi dengan dua chip MTIA v2 per papan.

Setiap sasis MTIA v2 berisi 12 papan komputasi yang masing-masing dilengkapi sepasang akselerator… Klik untuk memperbesar. Sumber: Meta.

Dalam hal penerapan beban kerja, Meta sangat bergantung pada kerangka PyTorch dan kompiler Triton. Kami telah melihat kombinasi ini digunakan untuk melakukan tugas pada berbagai GPU dan akselerator, sebagian karena kombinasi ini menghilangkan kebutuhan untuk mengembangkan kode yang dioptimalkan untuk perangkat keras tertentu.

Meta, sudah menjadi jurusan pendukung dari PyTorch, yang dikembangkan sebelum menyerahkan kendali ke Linux Foundation, karena memberikan fleksibilitas kepada para insinyur untuk mengembangkan aplikasi AI yang dapat berjalan di berbagai perangkat keras GPU dari Nvidia dan AMD. Jadi masuk akal jika Meta ingin menggunakan teknologi yang sama dengan chipnya sendiri.

Faktanya, Meta mengklaim bahwa dengan mengembangkan perangkat lunak dan perangkat keras secara bersama-sama, Meta dapat mencapai efisiensi yang lebih besar dibandingkan dengan platform GPU yang ada dan berharap untuk meningkatkan kinerja lebih banyak lagi melalui pengoptimalan di masa mendatang.

MTIA v2 tentu saja bukan silikon terakhir yang kita lihat dari Meta. Raksasa media sosial ini mengatakan pihaknya memiliki beberapa program desain chip yang sedang berjalan, termasuk program yang akan mendukung sistem AI generatif di masa depan. ®

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://go.theregister.com/feed/www.theregister.com/2024/04/10/meta_mtia_chip/