A gyermekek szexuális zaklatását használó anyagok (CSAM) terjedése elleni küzdelem érdekében a legjobb generatív mesterségesintelligencia-fejlesztők – köztük a Google, a Meta és az OpenAI – koalíciója megfogadta, hogy védőkorlátokat fog érvényre juttatni a feltörekvő technológia körül.

A csoportot két non-profit szervezet vonta össze: a Thorn gyermektechnológiai csoport és a New York-i székhelyű All Tech is Human. A korábban DNA Foundation néven ismert Thornt 2012-ben Demi Moore és Ashton Kutcher színészek indították el.

The collective pledge was announced Tuesday along with a new Thorn report advocating a “Safety by Design” principle in generative AI development that would prevent the creation of child sexual abuse material (CSAM) across the entire lifecycle of an AI model.

“We urge all companies developing, deploying, maintaining, and using generative AI technologies and products to commit to adopting these Safety by Design principles and demonstrate their dedication to preventing the creation and spread of CSAM, AIG-CSAM, and other acts of child sexual abuse and exploitation,” Tüske nyilatkozta.

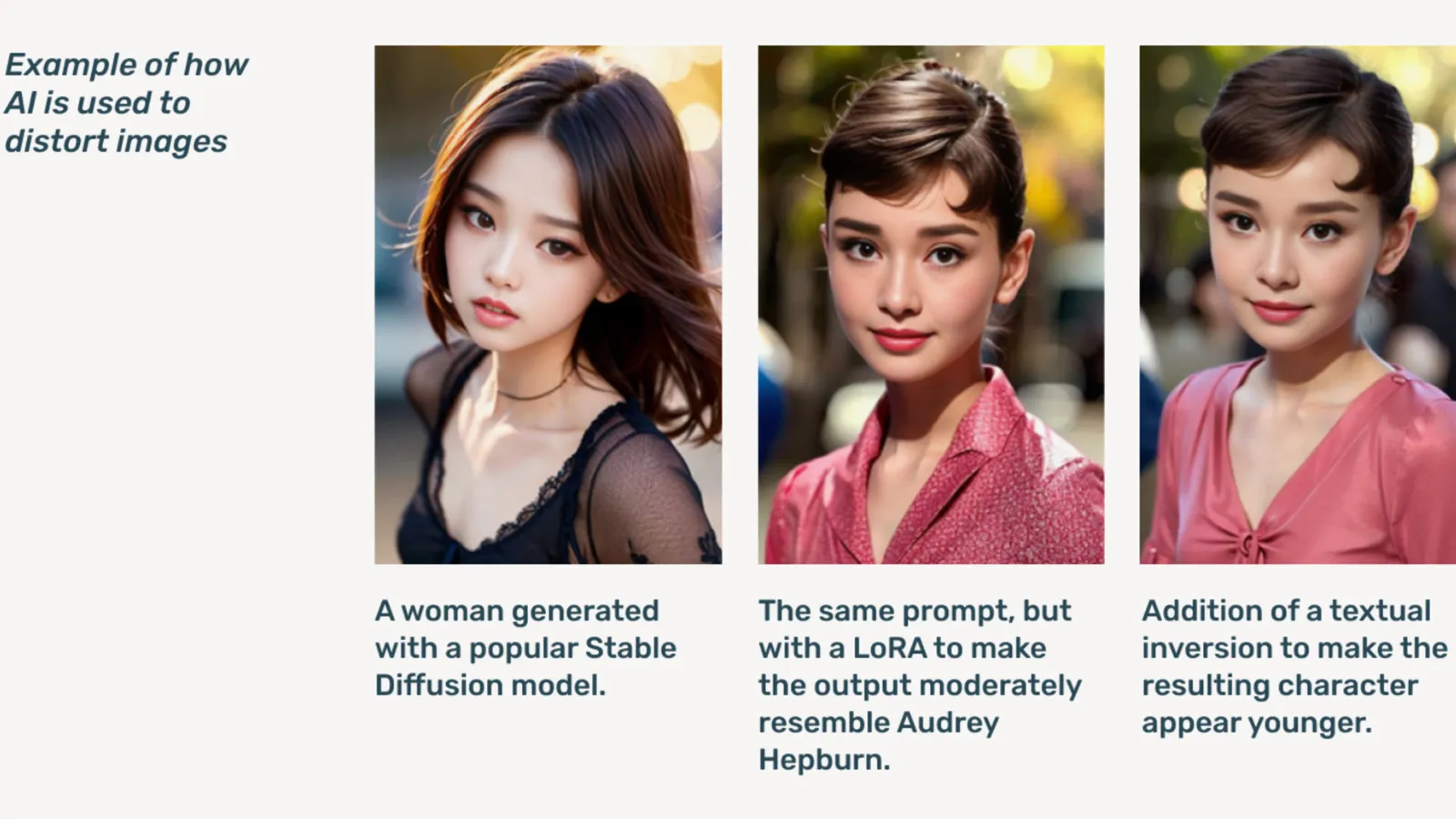

Az AIG-CSAM egy mesterséges intelligencia által generált CSAM, amely a jelentés szerint viszonylag könnyen létrehozható.

Thorn develops szerszámok and resources focused on defending children from sexual abuse and exploitation. In its 2022 impact report, the organization said over 824,466 files containing child abuse material were found. Last year, Thorn reported more than 104 million files of suspected CSAM were reported in the U.S. alone.

Already a problem online, deepfake child pornography skyrocketed after generative AI models became publicly available, with stand-alone AI models that don’t need cloud services being circulated on sötét háló fórumokon.

A generatív mesterséges intelligencia – mondta Thorn –, most minden eddiginél könnyebbé teszi a nagy mennyiségű tartalom létrehozását. Egyetlen gyermekragadozó hatalmas mennyiségű, gyermekek szexuális zaklatását célzó anyagot (CSAM) hozhat létre, beleértve az eredeti képeket és videókat új tartalommá alakítva.

"Az AIG-CSAM beáramlása jelentős kockázatokat jelent a már amúgy is megadóztatott gyermekbiztonsági ökoszisztémára nézve, súlyosbítva a bűnüldöző szervek előtt álló kihívásokat a bántalmazások meglévő áldozatainak azonosítása és megmentése során, valamint egyre több gyermek áldozatává válnak" - jegyzi meg Thorn.

Thorn’s report outlines a series of principles the generative AI developers would follow to prevent their technology from being used to create child pornography, including responsibly sourcing training adatkészletek, incorporating feedback loops and stress-testing strategies, employing content history or “provenance” with adversarial misuse in mind, and responsibly hosting their respective AI models.

Others signing onto the pledge include microsoft, antropikus, Mistral AI, amazon, Stabilitás AI, Civit AIés Metafizikai, each releasing separate statements today.

„A Metaphysic szellemiségéhez hozzátartozik a felelősségteljes fejlesztés egy mesterséges intelligencia világában, igaz, ez a hatalom növeléséről szól, de a felelősségről” – mondta Alejandro Lopez, a Metaphysic marketing igazgatója. visszafejtése. „Gyorsan felismerjük, hogy ennek elindítása és fejlesztése szó szerint azt jelenti, hogy megvédjük társadalmunk legsebezhetőbbjeit, akik a gyerekek, és sajnos ennek a technológiának a legsötétebb végét, amelyet a gyermekek szexuális zaklatását tartalmazó anyagokhoz használnak mély hamis pornográfia formájában. , ez megtörtént."

Indított 2021, Metafizikai came to prominence last year after it was revealed several Hollywood stars, including Tom Hanks, Octavia Spencer, and Anne Hathaway, were using Metaphysic Pro technology to digitize characteristics of their likeness in a bid to retain ownership over the traits necessary to train an AI model.

Az OpenAI nem kívánta kommentálni a kezdeményezést, ehelyett nyújtotta visszafejtése a gyermekbiztonsági vezető Chelsea Carlson nyilvános nyilatkozata.

“We care deeply about the safety and responsible use of our tools, which is why we’ve built strong guardrails and safety measures into ChatGPT and DALL-E,” Carlson said in a nyilatkozat. “We are committed to working alongside Thorn, All Tech is Human and the broader tech community to uphold the Safety by Design principles and continue our work in mitigating potential harms to children.”

visszafejtése megkereste a Koalíció többi tagját, de nem kaptak azonnal visszajelzést.

“At Meta, we’ve spent over a decade working to keep people safe online. In that time, we’ve developed numerous tools and features to help prevent and combat potential harm—and as predators have adapted to try and evade our protections, we’ve continued to adapt too,” meta – áll az előkészített közleményben.

“Across our products, we proactively detect and remove CSAE material through a combination of hash-matching technology, artificial intelligence classifiers, and human reviews,” Google‘s vice president of trust and safety solutions Susan Jasper wrote in a post. “Our policies and protections are designed to detect all kinds of CSAE, including AI-generated CSAM. When we identify exploitative content we remove it and take the appropriate action, which may include reporting it to NCMEC.”

In October, the UK watchdog group, the Internet Watch Alapítvány, warned that AI-generated child abuse material could ‘overwhelm’ az internet.

Szerkesztette Ryan Ozawa.

Maradjon naprakész a kriptográfiai hírekkel, és napi frissítéseket kaphat a postaládájában.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://decrypt.co/227731/aig-csam-google-meta-openai-fight-ai-child-sexual-abuse-material