बाल यौन शोषण सामग्री (सीएसएएम) के प्रसार से लड़ने के लिए, Google, मेटा और ओपनएआई सहित शीर्ष जेनरेटर एआई डेवलपर्स के गठबंधन ने उभरती हुई प्रौद्योगिकी के चारों ओर रेलिंग लागू करने की कसम खाई है।

समूह को दो गैर-लाभकारी संगठनों द्वारा एक साथ खींचा गया था: बच्चों का तकनीकी समूह थॉर्न और न्यूयॉर्क स्थित ऑल टेक इज ह्यूमन। पहले डीएनए फाउंडेशन के नाम से जाने जाने वाले थॉर्न को 2012 में अभिनेता डेमी मूर और एश्टन कुचर द्वारा लॉन्च किया गया था।

The collective pledge was announced Tuesday along with a new Thorn report advocating a “Safety by Design” principle in generative AI development that would prevent the creation of child sexual abuse material (CSAM) across the entire lifecycle of an AI model.

“We urge all companies developing, deploying, maintaining, and using generative AI technologies and products to commit to adopting these Safety by Design principles and demonstrate their dedication to preventing the creation and spread of CSAM, AIG-CSAM, and other acts of child sexual abuse and exploitation,” कांटा एक बयान में कहा.

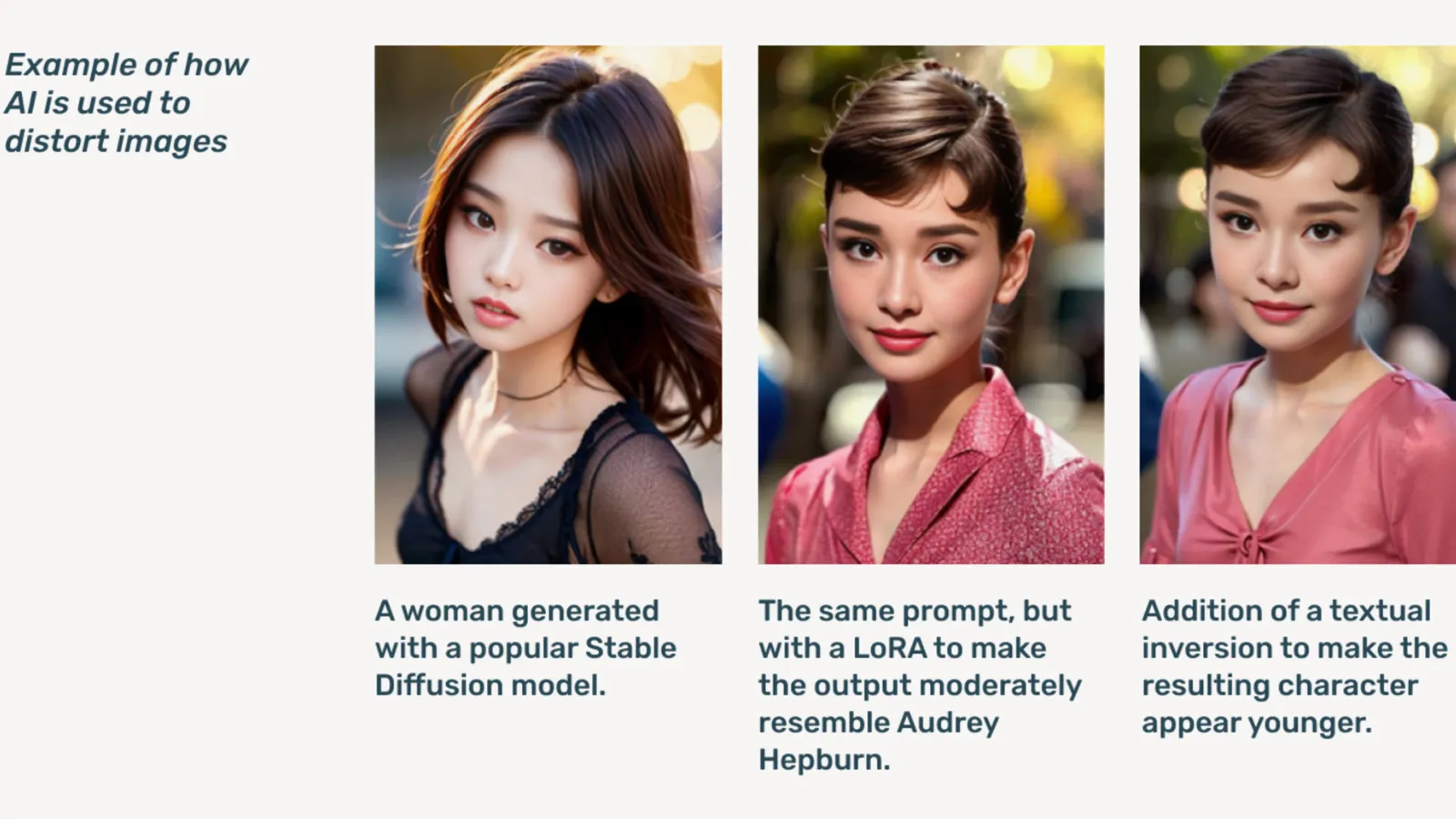

एआईजी-सीएसएएम एआई-जनरेटेड सीएसएएम है, जिसे रिपोर्ट बनाना अपेक्षाकृत आसान हो सकता है।

Thorn develops उपकरण and resources focused on defending children from sexual abuse and exploitation. In its 2022 impact report, the organization said over 824,466 files containing child abuse material were found. Last year, Thorn reported more than 104 million files of suspected CSAM were reported in the U.S. alone.

Already a problem online, deepfake child pornography skyrocketed after generative AI models became publicly available, with stand-alone AI models that don’t need cloud services being circulated on अंधेरे वेब मंचों.

थॉर्न ने कहा, जेनेरेटिव एआई अब बड़ी मात्रा में सामग्री तैयार करना पहले से कहीं अधिक आसान बना देता है। एक अकेला बच्चा शिकारी संभावित रूप से बड़ी मात्रा में बाल यौन शोषण सामग्री (सीएसएएम) बना सकता है, जिसमें मूल छवियों और वीडियो को नई सामग्री में बदलना शामिल है।

थॉर्न कहते हैं, "एआईजी-सीएसएएम की आमद पहले से ही कर लगाए गए बाल सुरक्षा पारिस्थितिकी तंत्र के लिए महत्वपूर्ण जोखिम पैदा करती है, जो दुर्व्यवहार के मौजूदा पीड़ितों की पहचान करने और उन्हें बचाने में कानून प्रवर्तन के सामने आने वाली चुनौतियों को बढ़ाती है, और अधिक बच्चों के नए उत्पीड़न को बढ़ाती है।"

Thorn’s report outlines a series of principles the generative AI developers would follow to prevent their technology from being used to create child pornography, including responsibly sourcing training डेटासेट, incorporating feedback loops and stress-testing strategies, employing content history or “provenance” with adversarial misuse in mind, and responsibly hosting their respective AI models.

Others signing onto the pledge include माइक्रोसॉफ्ट, मानवशास्त्रीय, मिस्ट्रल एआई, वीरांगना, स्थिरता एआई, Civit AI, तथा तत्वमीमांसा, each releasing separate statements today.

मेटाफिजिक के मुख्य विपणन अधिकारी एलेजांद्रो लोपेज़ ने बताया, "मेटाफिजिक में हमारे लोकाचार का हिस्सा एआई दुनिया में जिम्मेदार विकास है, ठीक है, यह सशक्तीकरण के बारे में है, लेकिन यह जिम्मेदारी के बारे में भी है।" डिक्रिप्ट. "हम जल्दी से पहचान लेते हैं कि इसे शुरू करने और विकसित करने का मतलब सचमुच हमारे समाज में सबसे कमजोर लोगों की रक्षा करना है, जो कि बच्चे हैं, और दुर्भाग्य से, इस तकनीक का सबसे काला अंत है, जिसका उपयोग गहरी नकली अश्लील साहित्य के रूप में बाल यौन शोषण सामग्री के लिए किया जा रहा है। , ऐसा हुआ है।”

2021 में शुरू की, तत्वमीमांसा came to prominence last year after it was revealed several Hollywood stars, including Tom Hanks, Octavia Spencer, and Anne Hathaway, were using Metaphysic Pro technology to digitize characteristics of their likeness in a bid to retain ownership over the traits necessary to train an AI model.

OpenAI ने इस पहल पर आगे टिप्पणी करने से इनकार कर दिया, बजाय प्रदान करने के डिक्रिप्ट इसके बाल सुरक्षा प्रमुख चेल्सी कार्लसन का एक सार्वजनिक बयान।

“We care deeply about the safety and responsible use of our tools, which is why we’ve built strong guardrails and safety measures into ChatGPT and DALL-E,” Carlson said in a कथन. “We are committed to working alongside Thorn, All Tech is Human and the broader tech community to uphold the Safety by Design principles and continue our work in mitigating potential harms to children.”

डिक्रिप्ट गठबंधन के अन्य सदस्यों से संपर्क किया लेकिन तुरंत कोई जवाब नहीं मिला।

“At Meta, we’ve spent over a decade working to keep people safe online. In that time, we’ve developed numerous tools and features to help prevent and combat potential harm—and as predators have adapted to try and evade our protections, we’ve continued to adapt too,” मेटा तैयार बयान में कहा।

“Across our products, we proactively detect and remove CSAE material through a combination of hash-matching technology, artificial intelligence classifiers, and human reviews,” गूगल‘s vice president of trust and safety solutions Susan Jasper wrote in a post. “Our policies and protections are designed to detect all kinds of CSAE, including AI-generated CSAM. When we identify exploitative content we remove it and take the appropriate action, which may include reporting it to NCMEC.”

In October, the UK watchdog group, the इंटरनेट वॉच फाउंडेशन, warned that AI-generated child abuse material could ‘overwhelm’ इंटरनेट।

द्वारा संपादित रयान ओज़ावा.

क्रिप्टो समाचारों के शीर्ष पर रहें, अपने इनबॉक्स में दैनिक अपडेट प्राप्त करें।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोडेटा.नेटवर्क वर्टिकल जेनरेटिव एआई। स्वयं को शक्तिवान बनाएं। यहां पहुंचें।

- प्लेटोआईस्ट्रीम। Web3 इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- प्लेटोईएसजी. कार्बन, क्लीनटेक, ऊर्जा, पर्यावरण, सौर, कचरा प्रबंधन। यहां पहुंचें।

- प्लेटोहेल्थ। बायोटेक और क्लिनिकल परीक्षण इंटेलिजेंस। यहां पहुंचें।

- स्रोत: https://decrypt.co/227731/aig-csam-google-meta-openai-fight-ai-child-sexual-abuse-material