Para luchar contra la difusión de material de abuso sexual infantil (CSAM), una coalición de los principales desarrolladores de IA generativa, incluidos Google, Meta y OpenAI, se comprometió a imponer barreras en torno a la tecnología emergente.

El grupo fue formado por dos organizaciones sin fines de lucro: el grupo tecnológico infantil Thorn y All Tech is Human, con sede en Nueva York. Thorn, anteriormente conocida como DNA Foundation, fue lanzada en 2012 por los actores Demi Moore y Ashton Kutcher.

El compromiso colectivo fue anunciado el martes junto con un nuevo Informe de espina defender un principio de “Seguridad por diseño” en el desarrollo de IA generativa que evitaría la creación de material de abuso sexual infantil (CSAM) durante todo el ciclo de vida de un modelo de IA.

“Instamos a todas las empresas que desarrollan, implementan, mantienen y utilizan tecnologías y productos de IA generativa a que se comprometan a adoptar estos principios de Seguridad desde el diseño y demuestren su dedicación para prevenir la creación y propagación de CSAM, AIG-CSAM y otros actos de sexualidad infantil. abuso y explotación”, espina dijo en un comunicado.

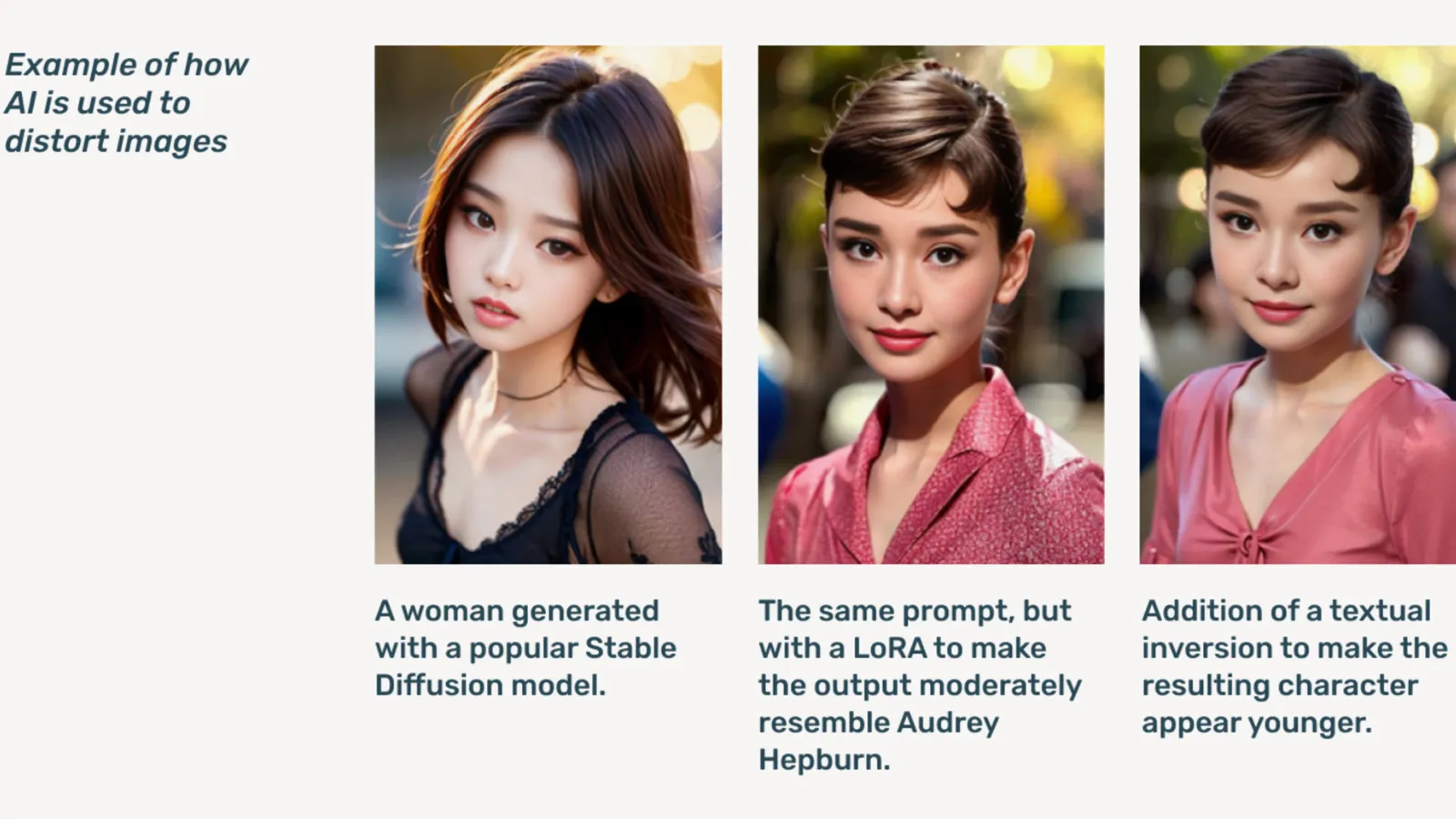

AIG-CSAM es CSAM generado por IA, que según el informe puede ser relativamente fácil de crear.

La espina se desarrolla y recursos centrados en defender a los niños del abuso y la explotación sexual. En su informe de impacto de 2022, la organización dijo que se encontraron más de 824,466 archivos que contenían material de abuso infantil. El año pasado, Thorn informó que solo en Estados Unidos se reportaron más de 104 millones de archivos de sospecha de CSAM.

La pornografía infantil deepfake, que ya es un problema en línea, se disparó después de que los modelos de IA generativa se pusieron a disposición del público, y circularon modelos de IA independientes que no necesitan servicios en la nube. Red oscura foros.

La IA generativa, dijo Thorn, hace que la creación de volúmenes de contenido sea ahora más fácil que nunca. Un solo depredador infantil podría crear volúmenes masivos de material de abuso sexual infantil (CSAM), incluida la adaptación de imágenes y videos originales a contenido nuevo.

“Una afluencia de AIG-CSAM plantea riesgos significativos para un ecosistema de seguridad infantil que ya está sobrecargado, exacerbando los desafíos que enfrentan las fuerzas del orden para identificar y rescatar a las víctimas de abuso existentes y aumentando la victimización de más niños”, señala Thorn.

El informe de Thorn describe una serie de principios que los desarrolladores de IA generativa seguirían para evitar que su tecnología se utilice para crear pornografía infantil, incluida la capacitación sobre abastecimiento responsable. conjuntos de datos, incorporando ciclos de retroalimentación y estrategias de pruebas de estrés, empleando el historial del contenido o la "procedencia" teniendo en cuenta el uso indebido del adversario y alojando responsablemente sus respectivos modelos de IA.

Otros que firmaron el compromiso incluyen Microsoft, antrópico, Mistral IA, Amazon, Estabilidad IA, IA civilizaday Metafisica, cada uno de los cuales publica declaraciones separadas hoy.

"Parte de nuestro espíritu en Metaphysic es el desarrollo responsable en un mundo de IA; cierto, se trata de empoderamiento, pero también de responsabilidad", dijo el director de marketing de Metaphysic, Alejandro López. Descifrar. “Reconocemos rápidamente que comenzar y desarrollar esto significa literalmente salvaguardar a los más vulnerables de nuestra sociedad, que son los niños y, desafortunadamente, el extremo más oscuro de esta tecnología, que se utiliza para material de abuso sexual infantil en forma de pornografía profundamente falsa. , eso ha sucedido”.

Lanzado en 2021, Metafisica saltó a la fama el año pasado después de que se reveló que varias estrellas de Hollywood, incluidas Tom Hanks, Octavia Spencer y Anne Hathaway, estaban usando la tecnología Metaphysic Pro para digitalizar características de su imagen en un intento por conservar la propiedad de los rasgos necesarios para entrenar un modelo de IA. .

OpenAI se negó a hacer más comentarios sobre la iniciativa y en lugar de eso proporcionó Descifrar una declaración pública de su líder de seguridad infantil, Chelsea Carlson.

"Nos preocupamos profundamente por la seguridad y el uso responsable de nuestras herramientas, razón por la cual hemos construido fuertes barandillas y medidas de seguridad en ChatGPT y DALL-E", dijo Carlson en un ambiental. "Estamos comprometidos a trabajar junto a Thorn, All Tech is Human y la comunidad tecnológica en general para defender los principios de Safety by Design y continuar nuestro trabajo para mitigar posibles daños a los niños".

Descifrar Se comunicó con otros miembros de la Coalición pero no recibió respuesta de inmediato.

“En Meta, llevamos más de una década trabajando para mantener a las personas seguras en línea. En ese tiempo, hemos desarrollado numerosas herramientas y funciones para ayudar a prevenir y combatir daños potenciales y, a medida que los depredadores se han adaptado para intentar evadir nuestras protecciones, nosotros también hemos seguido adaptándonos”. Meta dijo en una declaración preparada.

"En todos nuestros productos, detectamos y eliminamos proactivamente material CSAE mediante una combinación de tecnología de coincidencia de hash, clasificadores de inteligencia artificial y revisiones humanas". Google", escribió la vicepresidenta de soluciones de confianza y seguridad de Susan Jasper en una publicación. “Nuestras políticas y protecciones están diseñadas para detectar todo tipo de CSAE, incluido el CSAM generado por IA. Cuando identificamos contenido de explotación, lo eliminamos y tomamos las medidas adecuadas, que pueden incluir informarlo al NCMEC”.

En octubre, el grupo de vigilancia del Reino Unido, el Fundación Internet Watch, advirtio que el material de abuso infantil generado por IA podria 'abrumar' La Internet.

Editado por ryan ozawa.

Manténgase al tanto de las noticias criptográficas, obtenga actualizaciones diarias en su bandeja de entrada.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://decrypt.co/227731/aig-csam-google-meta-openai-fight-ai-child-sexual-abuse-material