Για την καταπολέμηση της εξάπλωσης υλικού σεξουαλικής κακοποίησης παιδιών (CSAM), ένας συνασπισμός κορυφαίων προγραμματιστών τεχνητής νοημοσύνης, συμπεριλαμβανομένων των Google, Meta και OpenAI, υποσχέθηκε να επιβάλει προστατευτικά κιγκλιδώματα γύρω από την αναδυόμενη τεχνολογία.

Η ομάδα συγκεντρώθηκε από δύο μη κερδοσκοπικούς οργανισμούς: τον όμιλο τεχνολογίας για παιδιά Thorn και το All Tech is Human με έδρα τη Νέα Υόρκη. Παλαιότερα γνωστό ως Ίδρυμα DNA, το Thorn κυκλοφόρησε το 2012 από τους ηθοποιούς Demi Moore και Ashton Kutcher.

The collective pledge was announced Tuesday along with a new Thorn report advocating a “Safety by Design” principle in generative AI development that would prevent the creation of child sexual abuse material (CSAM) across the entire lifecycle of an AI model.

“We urge all companies developing, deploying, maintaining, and using generative AI technologies and products to commit to adopting these Safety by Design principles and demonstrate their dedication to preventing the creation and spread of CSAM, AIG-CSAM, and other acts of child sexual abuse and exploitation,” αγκάθι είπε σε μια δήλωση.

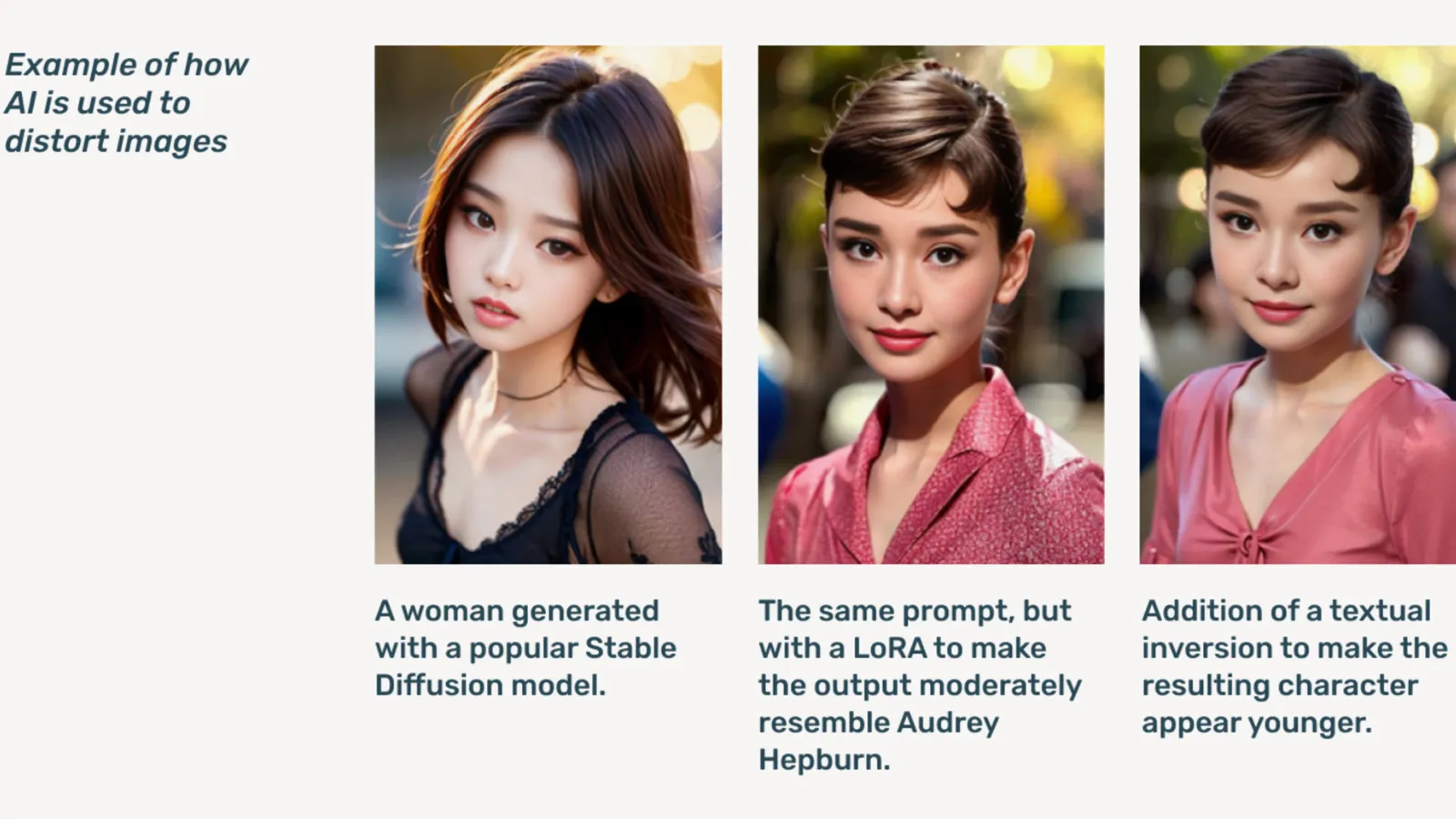

Το AIG-CSAM είναι CSAM που δημιουργείται από AI, το οποίο η αναφορά δείχνει ότι μπορεί να είναι σχετικά εύκολο να δημιουργηθεί.

Thorn develops εργαλεία and resources focused on defending children from sexual abuse and exploitation. In its 2022 impact report, the organization said over 824,466 files containing child abuse material were found. Last year, Thorn reported more than 104 million files of suspected CSAM were reported in the U.S. alone.

Already a problem online, deepfake child pornography skyrocketed after generative AI models became publicly available, with stand-alone AI models that don’t need cloud services being circulated on σκούρο web φόρουμ.

Το Generative AI, είπε ο Thorn, κάνει τη δημιουργία όγκων περιεχομένου πιο εύκολη τώρα από ποτέ. Ένα μόνο παιδί αρπακτικό θα μπορούσε ενδεχομένως να δημιουργήσει τεράστιους όγκους υλικού σεξουαλικής κακοποίησης παιδιών (CSAM), συμπεριλαμβανομένης της προσαρμογής πρωτότυπων εικόνων και βίντεο σε νέο περιεχόμενο.

«Μια εισροή AIG-CSAM εγκυμονεί σημαντικούς κινδύνους για ένα ήδη φορολογημένο οικοσύστημα ασφάλειας των παιδιών, επιδεινώνοντας τις προκλήσεις που αντιμετωπίζουν οι αρχές επιβολής του νόμου για τον εντοπισμό και τη διάσωση υπαρχόντων θυμάτων κακοποίησης και την κλιμάκωση της νέας θυματοποίησης περισσότερων παιδιών», σημειώνει ο Thorn.

Thorn’s report outlines a series of principles the generative AI developers would follow to prevent their technology from being used to create child pornography, including responsibly sourcing training σύνολα δεδομένων, incorporating feedback loops and stress-testing strategies, employing content history or “provenance” with adversarial misuse in mind, and responsibly hosting their respective AI models.

Others signing onto the pledge include Microsoft, Anthropic, Mistral AI, Amazon, Σταθερότητα AI, Civit AI, να Μεταφυσική, each releasing separate statements today.

«Μέρος του ήθους μας στη Metaphysic είναι η υπεύθυνη ανάπτυξη σε έναν κόσμο τεχνητής νοημοσύνης, σωστά, έχει να κάνει με την ενδυνάμωση, αλλά έχει να κάνει με την ευθύνη», είπε ο Alejandro Lopez, επικεφαλής μάρκετινγκ της Metaphysic. Αποκρυπτογράφηση. «Αναγνωρίζουμε γρήγορα ότι για να ξεκινήσουμε και να αναπτύξουμε αυτό σημαίνει κυριολεκτικά να προστατεύουμε τους πιο ευάλωτους στην κοινωνία μας, που είναι τα παιδιά, και δυστυχώς, το πιο σκοτεινό τέλος αυτής της τεχνολογίας, που χρησιμοποιείται για υλικό σεξουαλικής κακοποίησης παιδιών με τη μορφή βαθιάς ψεύτικης πορνογραφίας , αυτό συνέβη».

Ξεκίνησε το 2021, Μεταφυσική came to prominence last year after it was revealed several Hollywood stars, including Tom Hanks, Octavia Spencer, and Anne Hathaway, were using Metaphysic Pro technology to digitize characteristics of their likeness in a bid to retain ownership over the traits necessary to train an AI model.

Το OpenAI αρνήθηκε να σχολιάσει περαιτέρω την πρωτοβουλία, αντ' αυτού παρείχε Αποκρυπτογράφηση μια δημόσια δήλωση από την επικεφαλής της για την ασφάλεια των παιδιών Chelsea Carlson.

“We care deeply about the safety and responsible use of our tools, which is why we’ve built strong guardrails and safety measures into ChatGPT and DALL-E,” Carlson said in a δήλωση. “We are committed to working alongside Thorn, All Tech is Human and the broader tech community to uphold the Safety by Design principles and continue our work in mitigating potential harms to children.”

Αποκρυπτογράφηση επικοινώνησε με άλλα μέλη του Συνασπισμού, αλλά δεν έλαβε αμέσως απάντηση.

“At Meta, we’ve spent over a decade working to keep people safe online. In that time, we’ve developed numerous tools and features to help prevent and combat potential harm—and as predators have adapted to try and evade our protections, we’ve continued to adapt too,” Meta αναφέρεται σε έτοιμη δήλωση.

“Across our products, we proactively detect and remove CSAE material through a combination of hash-matching technology, artificial intelligence classifiers, and human reviews,” Google‘s vice president of trust and safety solutions Susan Jasper wrote in a post. “Our policies and protections are designed to detect all kinds of CSAE, including AI-generated CSAM. When we identify exploitative content we remove it and take the appropriate action, which may include reporting it to NCMEC.”

In October, the UK watchdog group, the Internet Watch Foundation, warned that AI-generated child abuse material could ‘overwhelm’ το διαδίκτυο.

Επιμέλεια: Ράιαν Οζάουα.

Μείνετε ενημερωμένοι για τα νέα κρυπτογράφησης, λάβετε καθημερινές ενημερώσεις στα εισερχόμενά σας.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- πηγή: https://decrypt.co/227731/aig-csam-google-meta-openai-fight-ai-child-sexual-abuse-material