Um die Verbreitung von Material über sexuellen Missbrauch von Kindern (CSAM) zu bekämpfen, gelobte eine Koalition führender generativer KI-Entwickler – darunter Google, Meta und OpenAI –, Schutzmaßnahmen für die neue Technologie durchzusetzen.

Die Gruppe wurde von zwei gemeinnützigen Organisationen gegründet: der Kinder-Tech-Gruppe Thorn und der in New York ansässigen All Tech is Human. Thorn, früher bekannt als DNA Foundation, wurde 2012 von den Schauspielern Demi Moore und Ashton Kutcher gegründet.

Das kollektive Versprechen wurde am Dienstag zusammen mit einem neuen bekannt gegeben Thorn-Bericht Befürwortung eines „Safety by Design“-Prinzips in der generativen KI-Entwicklung, das die Erstellung von Material über sexuellen Missbrauch von Kindern (CSAM) über den gesamten Lebenszyklus eines KI-Modells verhindern würde.

„Wir fordern alle Unternehmen, die generative KI-Technologien und -Produkte entwickeln, einsetzen, warten und nutzen, auf, sich zur Übernahme dieser „Safety by Design“-Grundsätze zu verpflichten und ihr Engagement für die Verhinderung der Entstehung und Verbreitung von CSAM, AIG-CSAM und anderen sexuellen Handlungen von Kindern zu demonstrieren Missbrauch und Ausbeutung“, Dorn sagte in einer Erklärung.

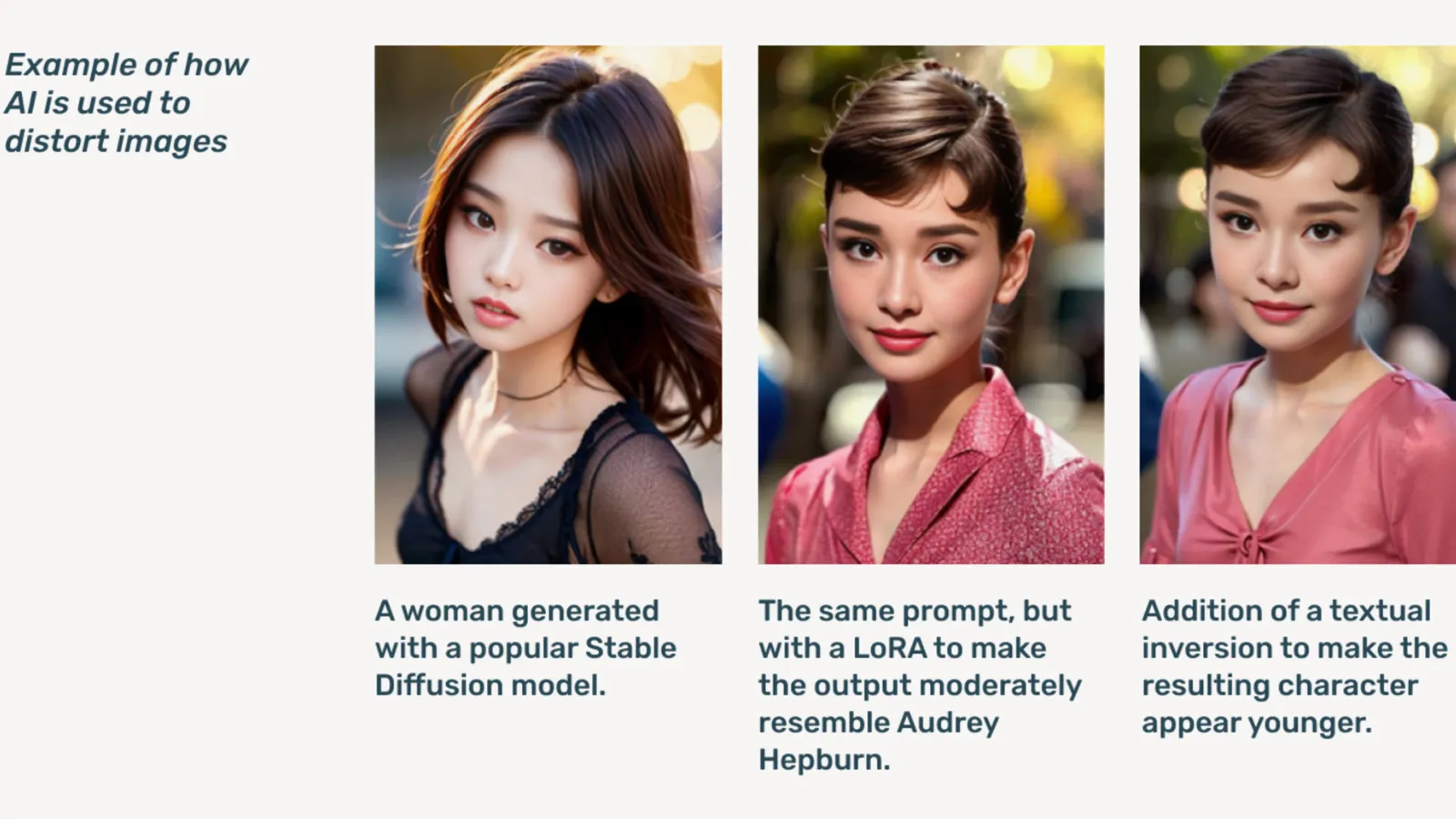

AIG-CSAM ist KI-generiertes CSAM, das, wie der Bericht zeigt, relativ einfach zu erstellen sein kann.

Dorn entwickelt sich Werkzeuge und Ressourcen, die sich auf den Schutz von Kindern vor sexuellem Missbrauch und Ausbeutung konzentrieren. In ihrem Wirkungsbericht 2022 gab die Organisation an, dass über 824,466 Dateien mit Material über Kindesmissbrauch gefunden wurden. Im vergangenen Jahr berichtete Thorn, dass allein in den USA mehr als 104 Millionen Dateien mit Verdacht auf CSAM gemeldet wurden.

Deepfake-Kinderpornografie, die bereits online ein Problem darstellte, nahm sprunghaft zu, nachdem generative KI-Modelle öffentlich verfügbar wurden und eigenständige KI-Modelle verbreitet wurden, die keine Cloud-Dienste benötigen Dunkles web Foren.

Generative KI, so Thorn, mache die Erstellung umfangreicher Inhalte jetzt einfacher als je zuvor. Ein einzelner Kindesmissbraucher könnte möglicherweise riesige Mengen an Material über sexuellen Missbrauch von Kindern (CSAM) erstellen, einschließlich der Umwandlung von Originalbildern und -videos in neue Inhalte.

„Ein Zustrom von AIG-CSAM birgt erhebliche Risiken für ein ohnehin schon stark belastetes Ökosystem der Kindersicherheit und verschärft die Herausforderungen, mit denen die Strafverfolgungsbehörden bei der Identifizierung und Rettung bestehender Missbrauchsopfer konfrontiert sind, und führt zu einer neuen Viktimisierung von noch mehr Kindern“, stellt Thorn fest.

Thorns Bericht beschreibt eine Reihe von Grundsätzen, die die Entwickler generativer KI befolgen würden, um zu verhindern, dass ihre Technologie zur Herstellung von Kinderpornografie verwendet wird, einschließlich einer verantwortungsvollen Beschaffung von Schulungen Datensätze, die Einbindung von Feedbackschleifen und Stressteststrategien, die Verwendung des Inhaltsverlaufs oder der „Herkunft“ unter Berücksichtigung des Missbrauchs durch Gegner und das verantwortungsvolle Hosten ihrer jeweiligen KI-Modelle.

Zu den weiteren Unterzeichnern des Versprechens gehören: Microsoft, Anthropisch, Mistral-KI, Amazon, Stabilität KI, Civit KI und Metaphysik, die heute jeweils eigene Erklärungen veröffentlichen.

„Ein Teil unseres Ethos bei Metaphysic ist die verantwortungsvolle Entwicklung in einer KI-Welt, richtig, es geht um Stärkung, aber es geht auch um Verantwortung“, sagte Alejandro Lopez, Chief Marketing Officer von Metaphysic Entschlüsseln. „Wir erkennen schnell, dass der Beginn und die Entwicklung damit im wahrsten Sinne des Wortes die Schwächsten in unserer Gesellschaft, nämlich Kinder, schützen müssen, und leider auch das dunkelste Ende dieser Technologie, die für Material über sexuellen Kindesmissbrauch in Form von Deep-Fake-Pornografie verwendet wird.“ , das ist passiert.“

Gestartet in 2021, Metaphysik erlangte letztes Jahr Bekanntheit, nachdem bekannt wurde, dass mehrere Hollywoodstars, darunter Tom Hanks, Octavia Spencer und Anne Hathaway, die Metaphysic Pro-Technologie nutzten, um Merkmale ihres Abbilds zu digitalisieren, um die Eigentümerschaft über die Merkmale zu behalten, die zum Trainieren eines KI-Modells erforderlich sind .

OpenAI lehnte es ab, sich weiter zu der Initiative zu äußern, sondern lieferte stattdessen eine Stellungnahme Entschlüsseln eine öffentliche Erklärung der Kindersicherheitsbeauftragten Chelsea Carlson.

„Wir legen großen Wert auf die Sicherheit und den verantwortungsvollen Umgang mit unseren Tools, weshalb wir starke Leitplanken und Sicherheitsmaßnahmen in ChatGPT und DALL-E eingebaut haben“, sagte Carlson in einem Aussage. „Wir sind bestrebt, mit Thorn, All Tech is Human und der breiteren Tech-Community zusammenzuarbeiten, um die Safety by Design-Prinzipien aufrechtzuerhalten und unsere Arbeit zur Minderung potenzieller Schäden für Kinder fortzusetzen.“

Entschlüsseln wandte sich an andere Mitglieder der Koalition, erhielt aber nicht sofort eine Antwort.

„Bei Meta arbeiten wir seit über einem Jahrzehnt daran, die Sicherheit der Menschen im Internet zu gewährleisten. In dieser Zeit haben wir zahlreiche Tools und Funktionen entwickelt, um potenziellen Schaden zu verhindern und zu bekämpfen – und da sich Raubtiere angepasst haben, um zu versuchen, unseren Schutz zu umgehen, haben wir uns auch weiter angepasst.“ Meta sagte in einer vorbereiteten Erklärung.

„In unseren Produkten erkennen und entfernen wir proaktiv CSAE-Material durch eine Kombination aus Hash-Matching-Technologie, Klassifizierern künstlicher Intelligenz und menschlichen Überprüfungen.“ GoogleSusan Jasper, Vizepräsidentin für Vertrauens- und Sicherheitslösungen, schrieb in einem Beitrag. „Unsere Richtlinien und Schutzmaßnahmen sind darauf ausgelegt, alle Arten von CSAE zu erkennen, einschließlich KI-generiertem CSAM. Wenn wir ausbeuterische Inhalte identifizieren, entfernen wir diese und ergreifen die entsprechenden Maßnahmen, einschließlich der Meldung an NCMEC.“

Im Oktober hat die britische Überwachungsgruppe The Internet Watch Stiftung, warnte davor, dass KI-generiertes Material über Kindesmissbrauch „überwältigen' das Internet.

Herausgegeben von Ryan Ozawa.

Bleiben Sie über Krypto-News auf dem Laufenden und erhalten Sie tägliche Updates in Ihrem Posteingang.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://decrypt.co/227731/aig-csam-google-meta-openai-fight-ai-child-sexual-abuse-material